(ChinaIT.com讯)Falcon(猎鹰)可以说是目前业界最受关注的明星,已飙升至Hugging Face最新开放大型语言模型(OpenLLM)排行榜榜首。Falcon-40B是一个大型语言模型(LLM),400亿参数量,1000B token训练量,训练采用RefinedWeb(一个大规模英语网络数据集)。它是由阿联酋-阿布扎比技术创新研究所(TII)开发的,该研究所致力于推动科技发展,造福人类。TII正在开发和引进更多的LLM,如Falcon-180B,因此我们可以期待自然语言理解和生成方面的更多突破和发现。

Falcon 入局开源基座模型头部行列

Dr.Wang关注Falcon的几大理由

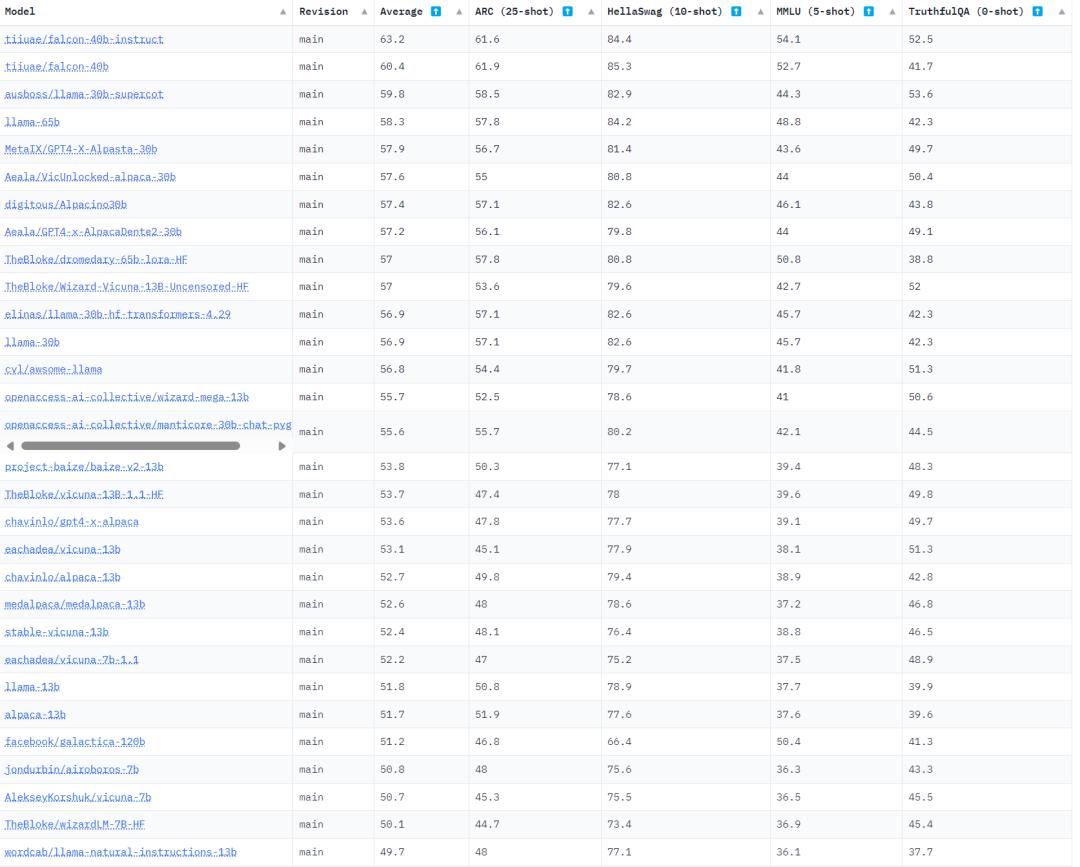

1. 首先,参考OpenLLM 排行榜单,Falcon表现优于LLaMA、StableLM、RedPajama、MPT等,可以说是市面上能免费获取的最好的大模型。

2023年6月5日Open LLM Leaderboard

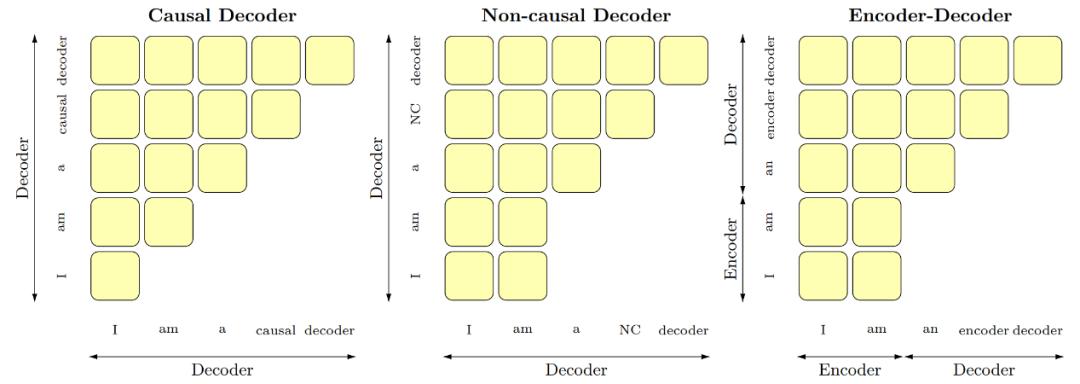

2. 作为Causal Decoder模型,训练预算仅为GPT-3的75%,推理计算开销仅为GPT3的1/5,论文将在后续发布,不知TII还藏了多少黑科技。

三种注意力机制架构

3. 石油国历时两个月,用AWS SageMaker 上384块GPU“炼制”而成的大模型直接开放免费获取,还可以用于商业化!(不过要注意,超过100万美元的任何商业应用都将征收10%授权费,许可证部分基于Apache License 2.0协议)至少对广大研究学者来说是一份强力福音。

已有1.2k个喜欢

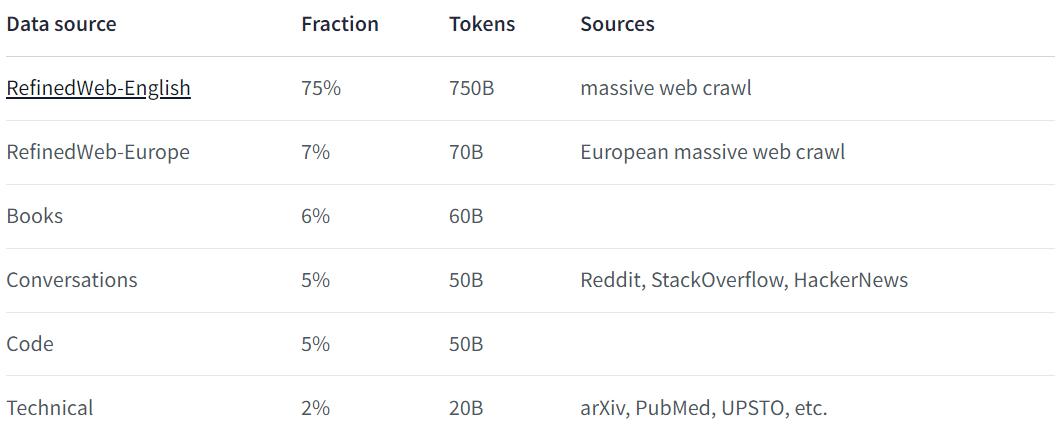

4. 训练Falcon的数据集是他们经过大量过滤清洗,并消除重复内容获取的5万亿token的高质量庞大训练集,这个数据集也是开源的。

训练语料来源

总结

Falcon - 40B对通用人工智能研究可谓一针强心剂,相关研究突破也将遍地开花。猎鹰不仅是一个先进的模型,也是一种开源和免费获取的资源,让研究者和开发者可以探索它的各种用法,并与社区分享他们的发现。让我们期待更多开源的LLM,无论是通用的还是垂类的,让羊驼们和猎鹰的战斗再猛烈些吧!

LLama和Alpaca

来源:上海市人工智能行业协会