在千百年前,地域的阻隔对于人类来说是一道难以逾越的鸿沟,也因此有了“千里送鹅毛,礼轻情意重”这样情深意厚的友谊。不过,随着科技发展的日新月异,火车、飞机等交通工具应运而生,人们仅需花费数小时便可见到千里之外的家人、朋友,地域的阻隔在慢慢被打破。

2016年3月28日,微软公司在美国加州旧金山市莫斯康中心所举办的Build2016开发者大会上宣布,他们正在开发一种名为“Holoportation(全息瞬移)”的3D视频捕捉系统,可以将人和物体的三维图像实时传输到世界上的任何角落,而使用者只需要配戴一款名为“HoloLens(全息眼镜)”的增强现实设备就能立刻看见他们。这个如同哆啦A梦的任意门系统,将免去大家旅途的奔波,让地域对我们的阻隔几乎消失。那么,一副小小的眼镜如何让人们面对面交流?眼睛在其中起到了怎样的作用呢?

微软推出“全息瞬移”技术 戴眼镜感受瞬间移动

心灵之窗里的秘密

俗话说,眼睛是心灵的窗户,人类每天接收到的信息有80%以上来自于眼睛,视觉是我们认识这个世界的最有效方式。在著名的“麦格克效应”中,心理学家们更是发现:当在人类语音感知过程中出现听觉和视觉互相干扰(即二者有细微差异)的现象时,视觉会影响听觉,让人们感觉到第三种根本不存在的声音,这便是眼睛在影响大脑对其他感官的判断。

光的反射与折射

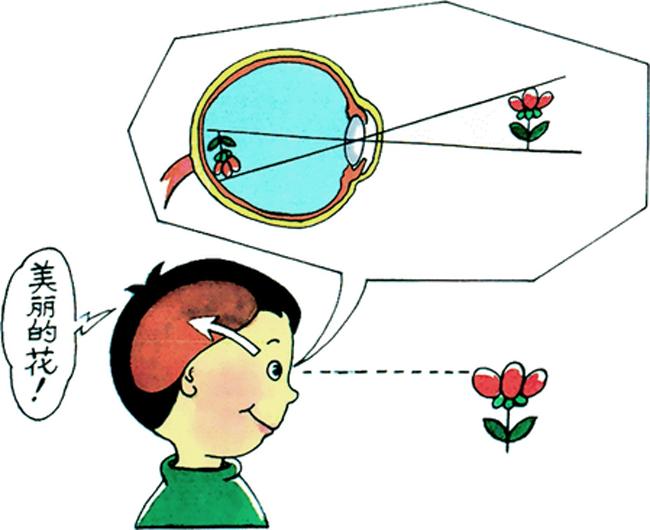

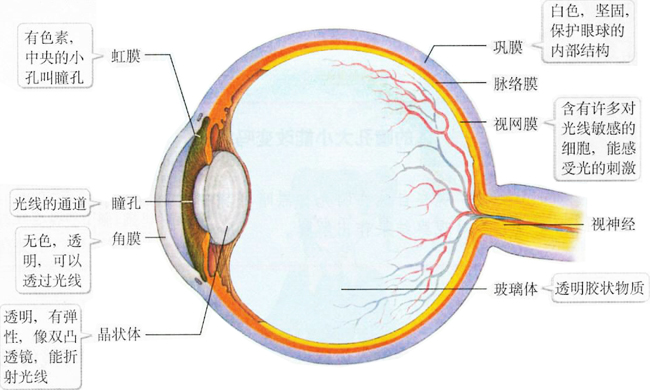

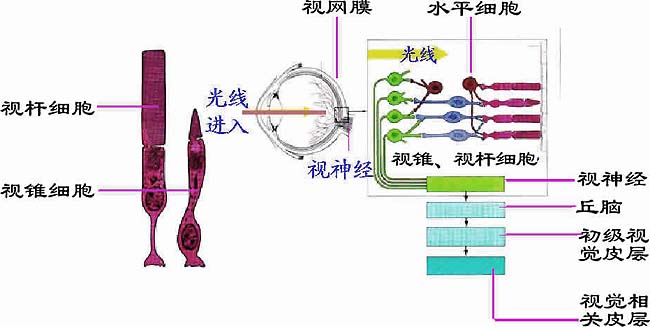

当照射物体的光线被反射或折射(比如看到水中的游鱼)后进入人眼,穿过角膜、瞳孔,经过晶状体折射后,通过对眼球屈光、减震的玻璃体,到达视网膜,形成倒立且缩小的实像。紧接着,视神经传递视觉信息,最后在视觉中枢形成视觉,人们就能看见物体了。

视觉的形成

作为人类最重要的感官之一,眼睛可不是运用简单的小孔成像原理来认识世界。因为增加了能够折射光线的晶状体,所以人眼是利用凸透镜成像原理工作的,相比小孔成像原理更加清晰。如果把人眼比作一台照相机,那么晶状体是镜头,瞳孔是光圈,视网膜是胶卷,但这并非人眼最神奇的地方。

眼球的基本结构和功能

1824年,英国伦敦大学的教授皮特·马克·罗葛特最先在其研究报告《移动物体的视觉暂留现象》中提出视觉暂留现象:人眼在看到某个物体后,视觉形象会维持0.1~0.4秒时长而不立即消失。这是由于眼睛中的感光细胞形成感光色素需要一定的时间所造成的。其实,早在我国古代,充满智慧的人们就利用这一原理制作了走马灯,如今,深受大众喜爱的电影也是利用视觉暂留而发明的。

不同动物瞳孔的形状

在大自然中,许多动物有着和我们不一样的眼睛,例如猫头鹰的眼睛被固定在眼眶中,无法转动;山羊的长方形瞳孔(右上)让它拥有330度的视野,相比之下,人类185度的视野就显得过于狭窄了;壁虎昼伏夜出,瞳孔(右下)收缩时会形成四个连成一排的小孔,只允许一定数量的光线进入眼睛;而乌贼的瞳孔(左上)可以模仿任何动物瞳孔的形状,收缩时呈W形,能够感知光的偏振。也许有一天,我们能从这些动物的眼睛中受到启发,有更多类似于电子蛙眼这样的雷达系统被发明出来。

虚拟成像的技术爆炸

人类在“发明创造”这件事情上的潜力远远超出大家的想象。前不久,日本东京大学的科学家制造出一台可触摸式全息投影机器,成功地将“3D触觉技术”运用到现实生活中。这台名为“Haptoclone(触觉克隆)”的全息投影机由两个盒子组成,一个用来放置被触摸的物体,另一个则呈现该物体的全息投影,并通过在实验者的手指上施加超声辐射压力,使其感受到物体的触感,达到混淆大脑、调和影像的目的。而早在2014年,Immerz公司就开发了一款名为“KOR-FX”的触觉背心,让游戏玩家切身体验游戏中受到的攻击。我们有理由相信,这项技术假以时日一定会被应用到更广阔的领域中去,比如在虚拟动物园中触摸猛兽,在虚拟网络中触摸实体商品,甚至用于医生对病人的远程诊断病情、进行手术。

名为“KOR-FX”的触觉背心

当然,这其中不可或缺的视觉影像部分所需要运用到的全息瞬移同样值得大家关注。不同于我们常用的二维视屏对话,全息瞬移将使用者的表情、声音、肢体语言等信息全方位的同步呈现于对方眼前。其使用者还能对画面进行缩小,让对方在你的掌中交流。此外,全息瞬移支持录制、编辑、移动、传送和回放等操作,人们可以在任何时间、任何地点见到彼此。那么,如此神奇的全息瞬移是如何实现的呢?

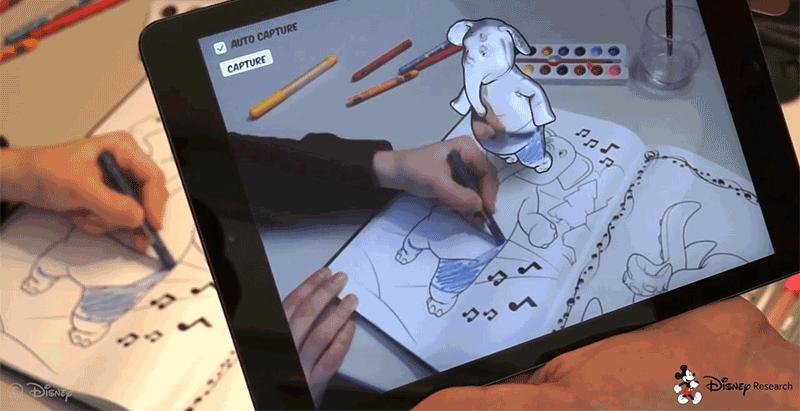

增强现实技术应用

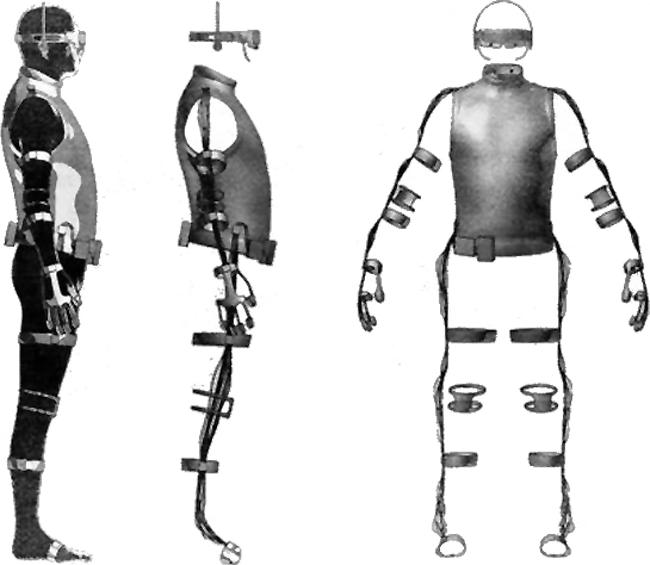

这就必须提到一个新名词——“增强现实技术”,全息眼镜中的处理器通过实时记录、计算使用者周围多台3D摄像机的位置和角度,并利用“动态捕捉技术”形成三维图像,传入人眼,达到将虚拟世界与现实世界相融合。全息瞬移正是依靠这项技术,把摄像机中的数据转化为一个个瞬时且相似度极高的图像,将其无缝拼接成三维立体模型,展现在对方的眼前。“增强现实技术”看似高深莫测,但早在1990年就已经被提出了,其中最重要的“动态捕捉技术”在20世纪70年代由迪斯尼公司尝试过,却受限于当时的计算机性能而未能被应用。

摄像机正在捕捉人物动作和表情

直到1988年,计算机性能的飞速发展,让SGI公司开发了一套可以捕捉人类头部运动和表情的软件系统来制作三维动画。人们通过摄像机的跟踪、测量、计算,获取运动物体的动态数据,再利用这些数据控制三维角色的运动,完成由实物虚拟化数据到虚拟化数据还原实物的一系列过程。而3D电影的原理并非如此,由于人类双眼的位置不同,看到的图像会有细微的差别,大脑则根据这些不同的图像形成立体画面。虽然原理简单,但操作起来可比2D电影要复杂得多呢!在大家确定了最终的剧本情节、概念设计和分镜头脚本后,图像建模人员开始进行组建3D故事版、构建3D模型等工作,摄影师也会用专门的3D摄影机开始拍摄工作,然后由专业人员来完成添加特效、分层渲染、图像合成等工作,最后得到的影片经过剪辑、配音、配乐后才能被搬上银幕。

3D眼镜

说到3D电影,就不得不提到3D眼镜。它通过左右眼镜片在透光与不透光之间迅速切换,使人眼看到不同的图像,让大脑形成立体画面。当银幕上*放播**左眼图像时,眼镜会接收到信号,左眼镜片变为透光,右眼镜片变为不透光;相反,当银幕上*放播**右眼图像时,眼镜也会接收到信号,让右眼镜片变为透光,左眼镜片变为不透光。

李宇春亮相羊年春晚 全息舞美演绎《蜀绣》

考虑到全息眼镜、3D眼镜的局限性,全息投影则更加方便。通过360度幻影成像系统将多角度的三维画面投影到全息膜上,形成实物与影像的完美融合。目前,这项技术被广泛地应用在各大科技馆与博物馆中,在2015年春晚上,李宇春的一曲《蜀绣》也是采用全息投影技术让三个影像与真实的她同台表演。

曾几何时,《星球大战》电影里的场景令人过目难忘:具备邪恶原力的黑暗尊主不用亲临现场,通过全息投影的方式实时出现在手下的面前发号施令,完全打破时空的障碍,神秘感满满。而如今,这种之前只能存在于科幻电影和想象中的交流方式,在增强现实技术的协助下将走进现实生活。

黑暗世界的闪烁星光

你是否遇到过这样的情景?在漆黑的夜晚,伸手不见五指,每走一步都小心翼翼,生怕撞上墙壁和行人。可对于盲人而言,生活中每时每刻都是这样的场景,车水马龙的街道,嘈杂喧闹的人群,许多看似平常的事情都会让他们如临大敌,那么,究竟是什么原因导致他们失明的呢?

过人行横道的盲人

经过研究发现,盲人分为先天性失明和后天性失明这两种,前者由于眼睛中缺乏感光细胞等传递视觉信息的物质而失明,后者则由于后天刺激引起视网膜脱离、感光细胞死亡等情况,造成难以逆转的视觉损伤而失明。简而言之,绝大部分盲人是由于视觉信息无法通过眼睛传递到大脑的视觉中枢而形成视觉所导致。

视冲动传导途径

也许正是明白盲人生活的艰难,微软盲人工程师Saqib Shaikh开发了一款让盲人“看得见”的应用程序——“Seeing AI”。人们只需将它安装在智能手机或者智能眼镜“Pivothead”上,这款应用程序就能自动识别、描述周围的环境,并且将文字转化为语音,甚至可以指导盲人调整角度拍摄照片,以及观察交谈对象的面部表情,感知他们的肢体语言所表达的情绪。

“Seeing AI”识别谈话对象的表情

“Seeing AI”通过获取的人脸资料(肤色、五官等)来建立面像档案,配合声音、表情等信息来形成一个个盲人专属的社交档案,配合资料库里的特定表情与肢体动作的含义,以及面部识别技术来帮助他们完成日常生活中的人际交往。同时,将文字转化为语音的功能可以协助他们完成点餐等日常生活中的事情。

用全息投影展示豪车

科技的发展越来越快,许多科幻电影、小说中的情节在一点点的变为现实,就像《星球大战》中的黑暗尊主现身时运用到的全息投影,如今也被人们用来展示华表、豪车、珠宝首饰等各类商品。

《星球大战》中的黑暗尊主现身时运用到的全息投影

在电视节目《锵锵三人行》中,梁文道先生提到:“如果逝去的亲人用全息投影的方式被留下,电脑模拟出他们的日常行为与交谈方式,那么,对我们活着的人的影响将是难以想象的”,虽然这是虚拟的,但我们也会期待这一天的到来吧?