可以显示10亿种颜色的屏幕,也就是原生硬件支持10bit色深的屏幕,好像一夜之间成为了显示设备的标配,所有带屏幕的设备都在提这个概念。

实际上这个概念很早以前就在摄影专业圈子里被讨论透了,专业显示器,高端电视,相机圈,已经对10bit有成熟的结论了。

简而言之就是:大部分时候没感知,除非你有专业的需求。

因为绝大部分时候我们看到的视频内容,都是非常复杂的,多种色彩和细节交杂在一起,8bit显示的1677万种颜色已经足够表达了,没人会暂停去放大一个色块看里面的断层如何表现,快节奏内容的当下,很难注意到这些要素。

要理解色深的话,我们先打个简单的比方,炒菜放调味。

色深就好比是勺子。

色彩这个厨子放盐的时候有个毛病,强迫症一样,每次都要把勺子给盛满了给放到锅里,每盛一次,他就尝一下味道。

但是顾客的口味是各不相同的,而且在这个次元里面,顾客可以精确地知道自己喜欢什么口味(色准)。

有人喜欢咸的,有人喜欢淡的,有人喜欢味精多一点,有人喜欢醋多一点。(RGB)

如果勺子太大的话,就导致口味会太咸或者太淡,勺子越小,口味可以调控地越精确。(色深)

所以色深这个概念其实挺难向消费者科普的,一般来讲,厂商要向消费者普及10bit色深到底有什么用的时候,都是用的同一招,那就是日出日落的视频。

日出日落的视频在8bit显示设备上,会出现明显的色彩断层,就像最左边这张图这样。

一般可以怎么解决这个问题呢,加噪点,强行制造相对平滑的过度。

在《警惕后期陷阱,不要让色彩断层毁了你的照片》这篇文中,就介绍了通过蒙版和加噪点的办法,来解决天空部分色彩断层的问题。

为什么会出现这种断层呢,就是因为8bit色深可以表达的色彩不够多。

我们知道图像的分辨率低,会导致画面细节纹理很模糊。

这张图可以很直观地看到,高分辨率的图可以有更多的纹理细节。

那么同样的,色彩也是一样的,它有自己的“分辨率”,这个“色彩的分辨率”决定了色彩细腻程度的数值,被我们称为色深。

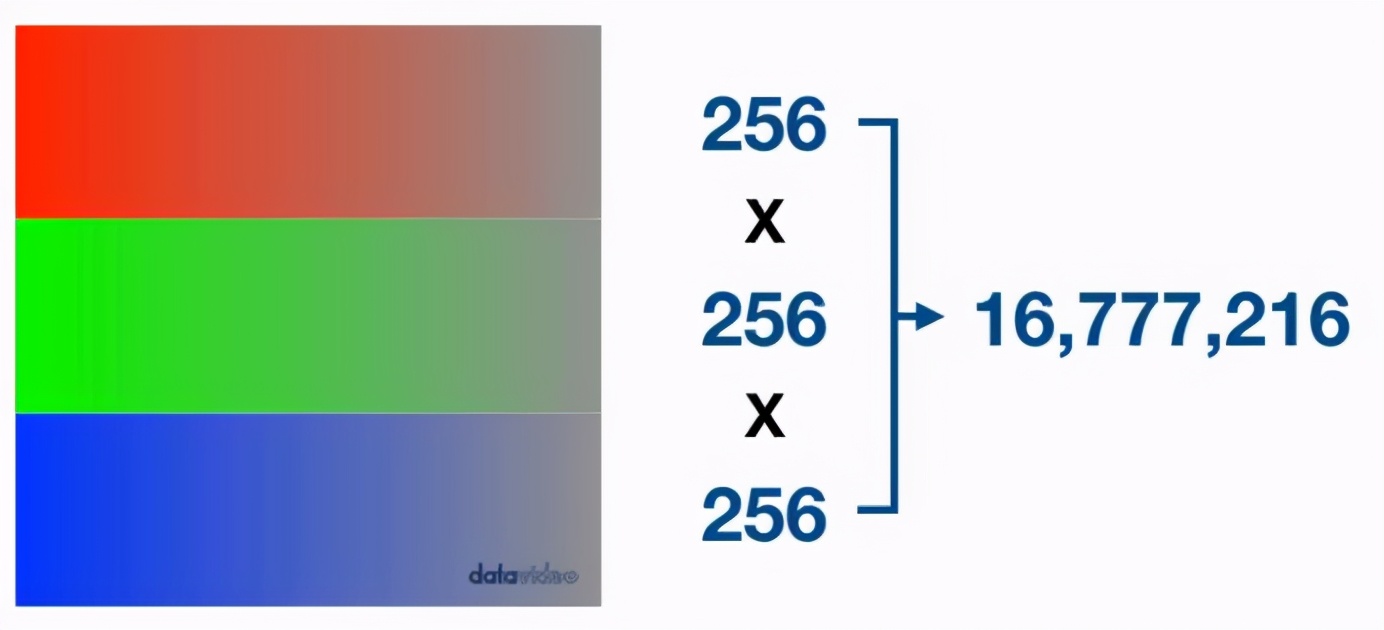

色深是由RGB红绿蓝三个色彩通道来定义的,大千世界,姹紫嫣红,就是由三基色混合而成的。

于是色彩通道的“分辨率越高”,最后能表达的色彩就越多。

所以8bit可以不恰当地类比为一千六百万像素的CMOS拍照能得出来的“色彩分辨率”。

而10bit则就是“10亿像素级别的色彩分辨率”。

既然10bit色深这么好,为啥没有普及这个概念呢?

这又要回到文章的开头了,终究来说10bit还是一个专业化的需求,在我们99%的观影中,8bit都已经足够了,只有少数的场景才有用。

最典型的场景,就是HDR视频的*放播**了,标准的HDR视频就是10bit色深的。

我们在一些学习网站找资料的时候,有些片源同样是2160P,但是8bit的就是SDR,10bit的才是HDR的。

那么HDR视频到底有什么好呢?

大家可以试一试一些视频网站官方的4KHDR演示片。

但是需要注意一些问题:

首先你要客户端打开,网页打开是不行的。

然后你的的手机屏幕是要支持HDR的,同时还需要是原生10bit色深的。

这样你才可以感受到HDR视频的乐趣,那种超高的动态范围,极致的色彩表现。

然而你最可能遇到的问题是——你的设备支持HDR,甚至认证了HDR10+。

但是你就是激活不了HDR的效果,直接表现就是在逆光树叶的镜头,强光下的叶片会发白,而激活了HDR的设备树叶是纯净的翠绿色。

图为不支持HDR的设备*放播**HDR片源出现的悲剧。

本来我的显示器就是8bit色深,在*放播**HDR片源的时候,强行转换过来的色彩几乎全面崩盘了。

大家可以看到,这还不如*放播**SDR片源呢,树叶的边缘几乎全崩了。

而激活了HDR的设备就可以获得同时获得强大的明暗细节,亮的地方不会过曝,暗的地方不会太暗,也就更加接近人眼的实际观感。

由此也可见到,人眼是一个多么强大的影像采集终端。

所以这里就是10bit色深未能普及开的另一个问题,就是内容端支持的太差了。

能够*放播**HDR片源的网站就少之又少,就算有也是特供的片源。

按照B站上传片源的规则来看,可以智能识别HDR片源。

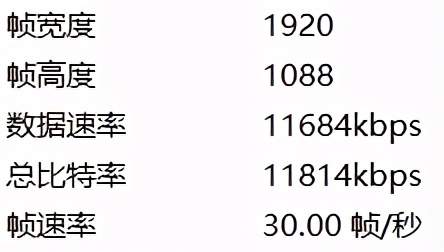

然后问题就来了,我直接拿手机拍了一段五分钟的4KHDR杜比视界30帧视频,仅原片就2G往上,在线*放播**需要的流量和带宽都十分惊人了。

而1080P8bit的视频五分钟只需要四百兆左右,是前者四分之一的大小。

对于平台来说,这些全部都是成本。

所以现在对高码率高品质视频支持最好的平台之一B站来说,做高画质主要还是营销驱动的,实际上消费端的面板没跟上,带宽流量也没能跟上。

但是此一时彼一时,以前10bit色深是摄影机相机的专属,从find X2Pro用Live HDR模式做10BIT色深采样开始,消费端也能用上这种体验了。

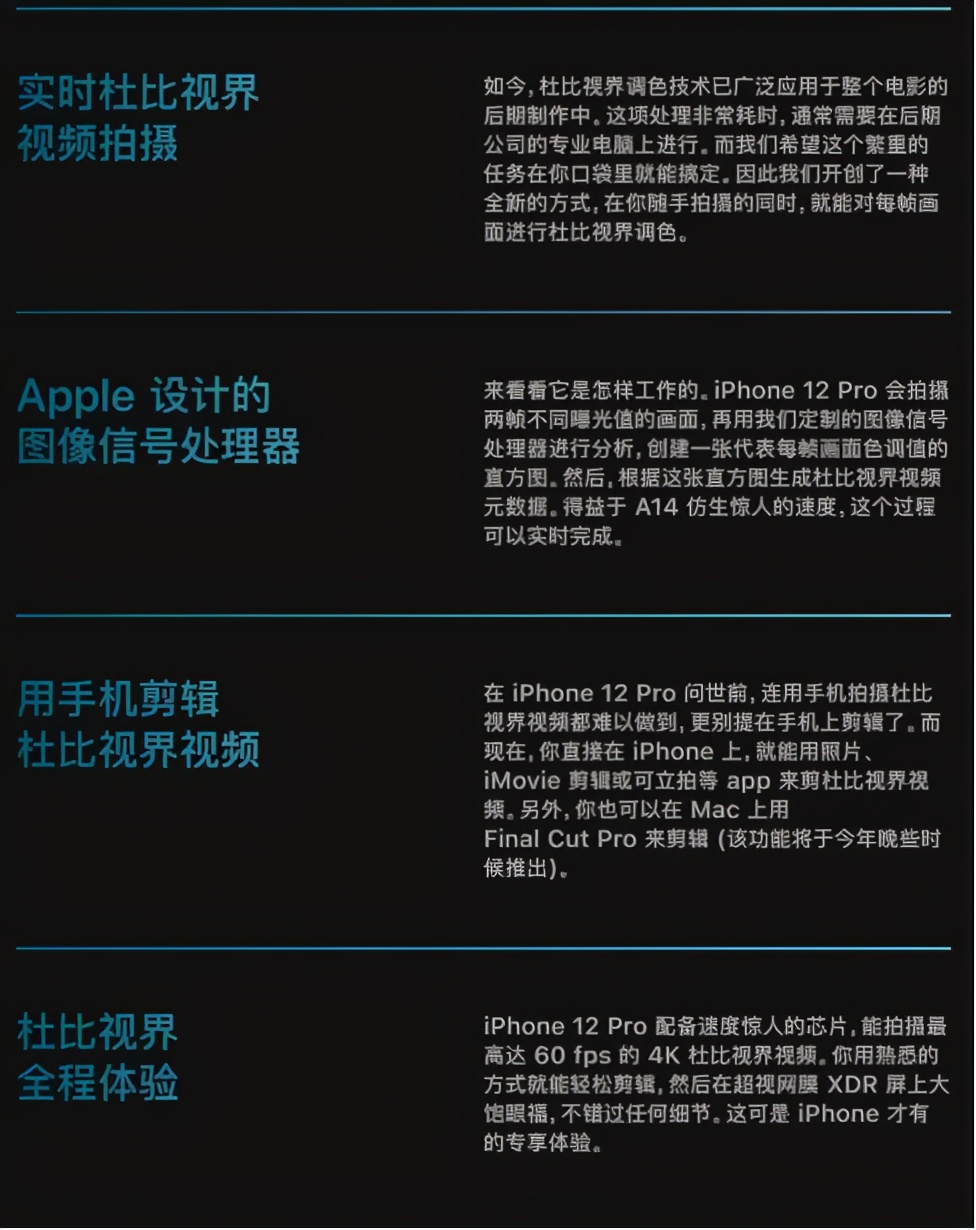

包括这一代iPhone 12 Pro系列,也普及了10bit的HDR杜比视界拍摄,一经推出之后广受好评。

随着旗舰手机普及10bitHDR视频拍摄功能,而且有越来越多屏幕支持HDR之后,我相信在采集端的利好,可以倒推内容端更多地去推广这些内容,鼓励创作者去制作高品质的内容。

消费者手里面有顶级的屏幕,他肯定也更愿意为内容付费——本身愿意购买高端手机的用户,他就是高价值用户,愿意为了更先进的技术特性花钱的。

硬件厂商是所有内容体验的基石,就像最早铺海底线缆的资本一样,你要想推动内容产业进步,首先就是硬件厂商背骂名,把体验基础拉起来。

然后内容创作者再跟上,平台为了标杆效应主动去推,消费者买了会员之后一用,发现10bitHDR真的观感显著,就可以形成一个良性循环。

高端硬件→高价值用户→高品质内容→平台标杆效应创收→体验口碑升华→高端硬件买买买

但是话说回来了,做了同样的事情,为啥OPPO做LiveHDR就没有收获苹果那么多的掌声呢?

这就要回到OPPO正在做的事情了——全链路色彩管理。

很多人看到这个概念之后都觉得一头雾水,其实就是OPPO要在安卓的生态里面,靠一己之力做到ios的色彩体验。

我们回顾iPhone 12 Pro系列的宣发就能看到,它们在推出10bit拍摄的同时,推出了一整条链路的10bit方案,从拍到剪到*放播**,可以在任何设备上完成,甚至可以在手机上剪辑杜比视界的视频。

在安卓这边,接近这个形态的,就是oppo了。

LiveHDR可以拍10bitHDR。

接下来全链路色彩管理估计要把即录soloop也适配10bit剪辑。

相册图片也要完整地支持10bit*放播**和储存,最简单的一个场景,比如我要在相册里面裁剪和编辑照片,后期完之后这个相片还是10bit色深的,不能说编辑一下就被压缩成8bit了。

更重要的是,oppo还要去推动平台方去主动适配10bitHDR的*放播**。

在我多台设备的测试中,很多支持HDR10+的设备,在*放播**HDR片源的时候,都无法激活HDR*放播**模式,这就是软件适配做得不够好。

我的显示器更是干脆彻底崩了。

所以综上所述,我们可以看到,要想得到完整顺畅的10bit体验,是需要一整个链条,完整顺畅地运作,才能够达成的体验。

为什么文章开头讲现在10bit是专业需求,普通人感受不到?

就是因为只有在专业领域,才能有全套的链路处理。

拍摄设备就要可以采录10bit的色深。

采录之后储存的格式就要支持10bit的色深,甚至可以保留更强大的色彩信息,比如HFIF最高可以储存16bit,而JPEG最高只能支持12bit,而且体积比HFIF大了一倍。

储存在介质中,就需要*放播**,这就还需要一个原生支持10bit色深显示的显示屏幕。

那么从摄像头采录,再编译到闪存中,需要*放播**的时候再调动,解码出来,映射到屏幕上。

其中每一个环节,都会客观上造成色彩信息的损失,每一步损失一点,到最后*放播**出来的时候,就会造成大量的色彩失真。

所以像oppo这样做全链路的10bit色彩管理,保证每一个环节都在掌控之中,才能做到完整的10bit色彩体验。

最起码你用OPPO的设备拍10bit的视频,在OPPO的屏幕上看,是非常准确的,这个是OPPO做这个工作最基本需要先做到的问题。

我曾经就用过一部手机,它相机拍视频的时候是P3色域,原生相机*放播**视频的时候是sRGB色域,就导致我拍的时候感觉色彩很鲜艳,*放播**的时候感觉色彩灰灰的,总感觉是自己有问题。

还有一次我在8bit色深的电视上看10bit色深的《环太平洋》电影片源,一开始感觉没啥一到晚上的时候,色彩断层就不断出现,很影响观感,还不如直接看8bit色深的片源。

这些就是片源投映到屏幕上的时候,解码出现的问题。

要想解决这些问题,厂商就需要不断地去定义和推动上下游对于色彩的定义和理解,让整个链条理解什么是好的色彩,认可“色彩可以更好”这个理念。

但在做这个工作的时候还是有一个问题,就是硬件厂商是没有资质去定义什么是“好的色彩”的,可能oppo还是要和相关机构一起来做这个事情。

所以经过我以上简单的介绍,大家可以发现,只是简单一个10bit色深的体验,就需要打通产业上下游,所有环节都需要付出比以往多得多的成本,去推动这个体验的普及。

当时oppo宣布全链路色彩管理的时候,我就感觉是一条漫长的道路。

但是路途虽然遥远艰苦,但基础的工作总是要有人去做,去推动。

oppo愿意在安卓阵营里面主动在国内做这件吃力不讨好的事情,是很具有先锋意义的。