2017年3月14日,驭势科技联合创始人&CEO、原英特尔中国研究院院长、英特尔首席工程师吴甘沙来到北大AI公开课,就“无人车与自动驾驶”主题,与北大人工智能创新中心主任、百度七剑客之一、酷我音乐创始人雷鸣老师一起进行了分享和讨论。

吴甘沙,原英特尔中国研究院院长,英特尔中国研究院的第一位“首席工程师”。2000年加入英特尔,2011年晋升为首席工程师,在英特尔工作期间,他发表10余篇学术论文,有22项美国专利,14项专利进入审核期。2016年1月底,吴甘沙离开英特尔开始创业,现为驭势科技联合创始人&CEO。

本文由北大孵化器投资基金项目高级经理王亮整理发布

“过去十多年,智能驾驶已经发展出来了一套AI体系,而现在,我们觉得可以把其中的一些东西*翻推**重来。”

为什么做无人驾驶?

庞大的汽车拥有量,成为城市的一个顽疾:一方面堵车导致交通事故,废气排放引发雾霾等一系列的问题。另一方面,“停车难”助推“房价高企”。这里有三个数据:1、一辆车96%的时间是停着的,而且需要两个停车位;2、据统计,在城市的商业中心CBD附近,35%的航行里程是与找停车位相关;3、大城市15%以上的土地是用来停车的。还有一个触目惊心的数据:中国一天可能因为上下班交通浪费在路上10亿个小时。而五六千年以前古埃及人建造一座大金字塔就花了这么点时间。无论是摇号、限行、交通拥堵费,还是网约车,现行的解决方案都没办法根本性上解决,系统性解决这个问题,要靠智能驾驶。

有了智能驾驶之后,城市的交通状况就不一样了。例如北京,有接近六百万私家车,而提供按需出行服务的出租车只有7万辆左右。对于我们绝大多数人来说,首先打车很难,其次打车很贵,还不如自己买辆车,这就是买车的逻辑。有了智能驾驶,北京的交通状况就不一样了。首先,城市里面车辆的总保有量可以减少一半,只有100万辆私家车,还有200万辆是无人驾驶出租车。根据大数据的运算规律,可以按照全城人群的分布和出行的规律,把这200万辆车分布在城市的各个角落,保证每个人一叫车,两分钟之内就来车。而且,打车的费用可以降到今天的1/3。

同时,未来只要无人驾驶的调度算法足够好,可以减少空驶,从而解决现在因空驶造成的大量燃油浪费。加上新能源的普及,每公里行驶成本会比现在的燃油低很多,出租车的费用自然就降下来了。由此,城市的一系列交通问题都可以得到解决。

无人驾驶车可以整整齐齐地开,相同距离可以容纳更多车辆,道路的容量可以提升3倍,还可以减少90%以上的交通事故。同时,当第一辆车档掉风阻,后面的车可以开得非常省力,能源的效率也得到提升。这种模式对停车位的需求也会极大降低。

未来滴滴一定是无人驾驶

无人驾驶的场景,在商业上也是一个巨大机会。如今,“滴滴出行”一天的峰值能够达到2100万单。这什么概念呢?阿里巴巴全品类的电商相加一天大约是3000-5000万单。美团、大众点评吃喝玩乐住加起来一天大约1300万单。由此可见,出行是相当刚性的、高频的需求。但是,受限于能够提供服务的车和人,再加上人力成本,今天的快车也并不会比出租车便宜。要突破这两个局限的,必须通过无人驾驶的出租车。

一旦实现无人驾驶,每日出行将达到5亿单甚至更高,会是电商所有品类当中最大的交易量。此外,未来的车交通工具的属性会降低,商业空间的属性会增加:放一台咖啡机,它就是移动星巴克;放一块大屏幕,是移动万达影城;放块小屏幕,是移动的分众传媒;放一套办公设备,是移动的写字楼……未来的打车体验,车费也许就是十来块,但喝杯咖啡需要二三十块钱,看场电影需要三四十块钱。由此,整套新的商业体系就会呈现出来,并带来更为广阔的市场机遇。

智能驾驶里面有一些什么样的AI技术?

智能驾驶要达到3个方面:一是感知和认知的理解部分;二是地图和定位;三是认知的决策部分。

第一步是认路。传统上的无人驾驶从“激光雷达”开始,激光雷达呈现出来一个几何的世界,乘车人通过与几何世界互动实现无人驾驶。激光雷达能够把树,草坪,车辆,房子等等很准确地把模型建立出来。谷歌第一代、第二代、第三代无人驾驶车,上面有个激光雷达。百度的第一代、第二代车的顶上有激光雷达,两边和后面有3个小的激光雷达。激光雷达高昂的价格促使人们寻找其他解决方案,也就是基于视觉以及毫米波雷达,超声波等等助传感器。其实,最重要的还是视觉,视觉构建的不是一个几何世界,是一个像素世界,基于一个像素世界,要去理解和预测,这是基于视觉的智能驾驶。但是,现在的视觉方案存在缺陷:第一,视觉容易受到光照条件的影响,比如若遭遇强逆光,则对判断会有很大的影响;第二,AI只能识别数据库里有的障碍物,这就要求数据库必须要足够完备。比如说一条高速路上行驶,可能只有车;但是在另外一条高速上则可能有其他动物,或者不在数据库里的障碍物,就很可能会出现事故。

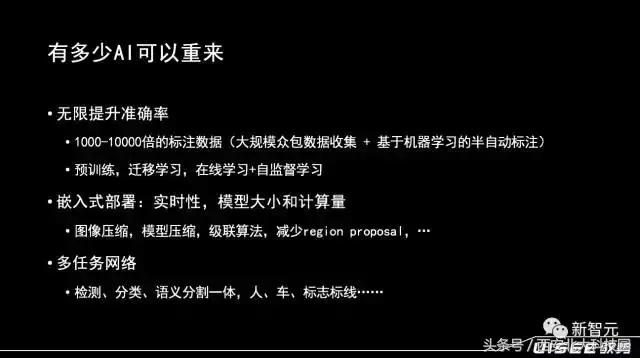

如何解决?一种办法是重新回到几何世界,通过摄像头去构建一个几何的世界。双目立体摄像头,无论是静态的障碍还是动态的障碍物,都有一团点云去标识,点云呈现暖色调,代表距离比较近;呈现冷色调,代表距离比较远。当一辆车刚刚出现的时候,是暖色调,随着它渐行渐远的变成冷色调。这是一种解决问题方案,即不用再去识别是什么障碍,但必须通过对几何世界的建模去了解这里有障碍。还有一种办法,通过更好的计算机视觉,即所谓的语音分割。通过更好的分割办法,去发现障碍物,找到可行驶区域。有几个点需要注意:第一,即使是用了深度学习,在一个复杂场景里面,对障碍物的识别率,比如对车辆的识别率可能只有90%出头,对自行车骑车者,只有百分之七八十。解决方法可能是通过更多的标注数据,现在一般训练可能拿10万张标注数据,如果有能力去获得几十亿张,甚至是几百亿数据,那训练出来模型准确率会非常高,这就存在如何去收集数据的问题。第二,收集到数据之后,如何去进行标注,10万级别还可以通过众包的方式人工进行标注,但到了百亿级就需要研究基于机器学习,做半自动的标注,先让机器学习标注,再有就是通过预训练,预训练是迁移学习的一种表达。没有标注数据,要么就从其他领域迁移过来,要么就是在线学习,通过自监督学习进行标注。第三,嵌入式的部署,因为汽车上面是一个嵌入式系统,而不是一个数据中心,要考虑实时性、模型的大小、计算量等。

第二步就是认路的司机怎么去做,这需要借助地图和定位系统。传统上,采用XJBD方法,首先用一个高精度定位的系统RTK,依靠卫星、地面基站、多个天线做差分计算,获得厘米级的定位精度。但光靠这个是不行的,因为获取的信号通常跳跃性比较大,这时就需要运用XJBD方法加上新的系统,如给车加载视觉里程计;还有一种情况,在环境中贴二维码,通过对二维码的实时监测来辅助定位;再者,也可通过SLAM(同步构图与定位)技术来实现。

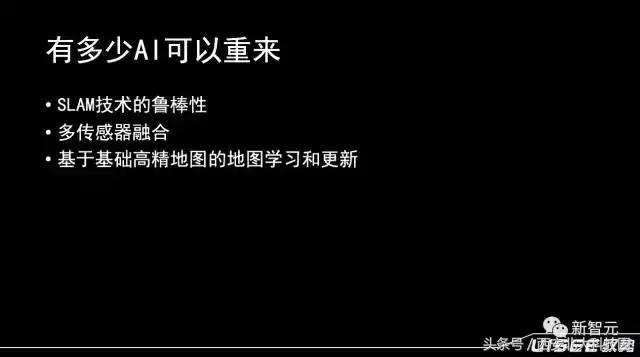

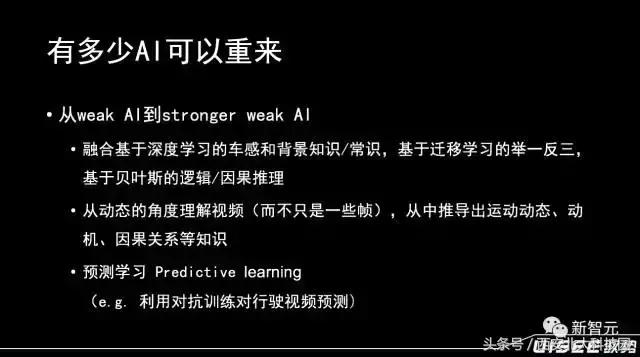

有多少AI可以重来?

第一,SLAM技如何能够做到更加鲁棒?众所周知,SLAM技术由于视觉质量技术,非常受限于在环境当中能够发现的这些特征点,比如说四处都是白墙,是很困难。

其次,多传感器要进行融合,在什么情况下,哪种传感器给出来的数据的可信度是更高,怎么能够把它们融合起来,或者用另外一种传感器来帮助这种传感器?这个融合算法其实也有很多的探索;还有,就是基于基础高精地图不断地对地图的更新和学习。因为四维也好,百度也好,他们可能全国只有100辆扫街的车,因此对于基础地图的更新是非常慢。如果每一辆车,不但具备定位的功能,也能够帮助地图进行更新,那用户始终会拿到最新的地图,这些都是值得去探索的方向。

第三,通过跟环境的互动方式,去推知其他物体的物理特性,预测他们的行为来去决定我该怎么样。这时,传统的监督学习就不够。监督学习是给出一个状态,并能够对它进行一个预测,而这个预测,对外界环境是不会有影响的。但是,实际开车的时候,必须不断跟环境互动。因此,需要新的学习方法,就是比较通用的强化学习的方法,去实现跟环境的互动。这是一个比较广泛含义上的强化学习,这里面可能也包括像马尔可夫决策过程,循环神经网络等。

最后说一下穿过AI落地的迷雾。现在我们看到很多人工智能做出来,Demo非常好,但是它离真正落地,离部署其实有很长的道路。做demo的话,100次当中有1次成功就行了。把成功的视频放在网上,大家都觉得很牛。但是真正部署了以后,100次当中有1次失败就完蛋了。而且,拍demo时可以在车上装6个、9个激光雷达都无所谓,但是真正落地的话成本就变成了考量因素。不仅仅要考虑车,还要考虑基础设施,考虑整个运维的系统。另外,从算法能力到系统能力,算法做好了,下一步要考虑鲁棒性和实施性,但更重要的是软硬件的垂直整合。

往期内容回顾

AI课程:

AI课程|小米黄江吉:从小米看人工智能硬件的发展史

AI课程|滴滴叶杰平:智能交通和交通大数据

AI课程|英伟达董方亮:为AI而生的GPU

AI课程|谢国彤与IBM的AI+医疗:个性化、循证的智慧医疗

AI课程|微软洪小文:有关AI能力的三个问题

在孵精英:

在孵精英|来自NASA的佳格团队当上了中国的“务农人”

在孵精英|翼开科技获2016年度软件类最佳奖项!

在孵精英|平均年龄25岁的团队要让机器人睁开“双眼”看世界!

在孵精英|FireRadar金火眼——新安全 新思考