2021年12月17日,欧洲科学院焦李成院士受邀参加2021中国计算机大会“下一代演化计算发展趋势”论坛,并做了“进化优化与学习的思考与挑战”的主旨报告。以下为报告的部分内容。

非常感谢大会和姚新老师的邀请,也非常荣幸有这个机会与大家分享进化优化和深度学习结合的一些思考,分以下五个部分来进行讨论。

每一门学科的发展,每个研究方向的发展,它的思想是如何起源的呢?人工智能几十年来得到了长足发展。进化优化和类脑启发的深度学习是人工智能技术的核心。它们受自然演化的启发和脑处理知识的启发。回顾诺贝尔奖颁给脑科学工作者的历史就可以看到人是如何进行思考的。获得图灵奖的这些工作清楚的论述了机器是如何进行学习和推理的。获得诺贝尔生理学或医学奖的工作也论述了生物是如何选择和优化的。这些工作对现在人工智能技术的发展有什么样的启示和思考?

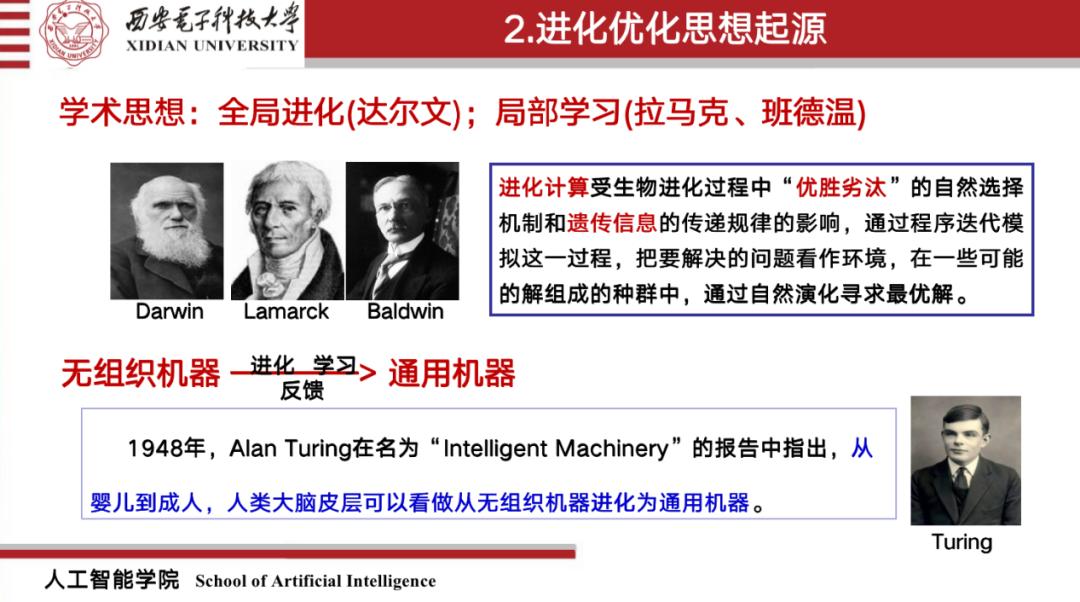

全局进化的达尔文主义和局部学习的拉马克、班德温主义是构成进化优化算法的基本思想。1948年,图灵在“Intelligent Machinery”中指出从婴儿到成人,人类大脑皮层可以从无组织机器进化为通用机器。那应该如何实现上述思想呢?进化优化发展的历史很长,和神经网络的发展史差不多。从1960年的进化编程,1964年的进化策略,1975年的遗传算法到1980年的遗传编程,这些先驱者们都做出了杰出的工作。正是由于他们才有现在进化计算这个研究领域。

群体智能实际上是一个动力学过程,通常由混沌状态出发,通过价值启发信息探索规律、模式和知识,最终得到解。它的过程是通过动力学的演化以概率1收敛到全局最优。它的特点表现为随机性、非线性、遍历性、自组织性、自适应多样性、稳定性和高度并行性。群体智能的思想起源于物理、生物、社会等多个方面。群体智能代表性的方法包括粒子群、免疫、烟火、和雨滴等。

进化优化用于复杂问题的求解,主要是利用其并行性、奇异性、高度非线性和广泛应用性。这些造就了其求解NP难问题和组合爆炸问题的独特优势。从90年代初到现在经过了三十多年的时间,进化计算被用于求解许多实际问题。许多有益工作,对推动这个领域发展具有开拓性作用的科研工作者,研究方向包括进化编程、进化策略、遗传编程、超启发式算法、多任务优化等等。进化计算在多目标领域更是百花齐放。

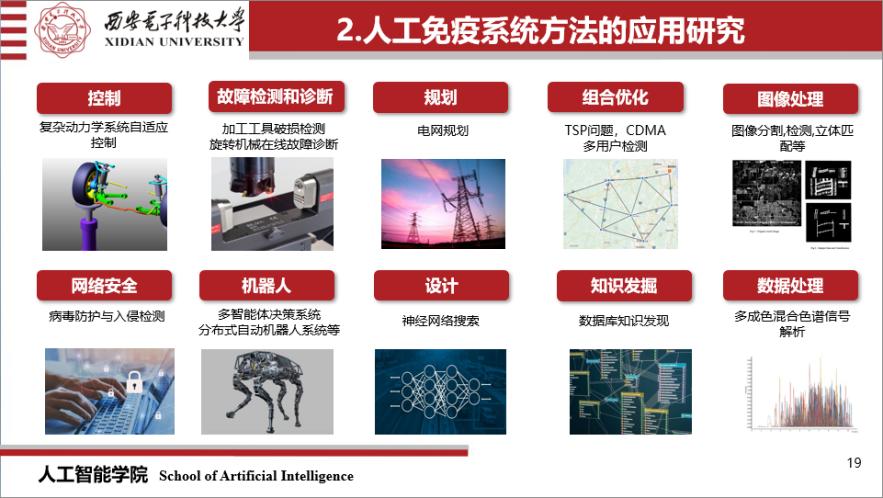

免疫、进化以及神经网络是属于自然科学的三大理论系统支柱。经验免疫,科学免疫,到现代免疫为构造新的免疫系统、免疫进化算法提供了很好的生物学基础,自然免疫学理论也为人工免疫进化优化提供了坚实的理论基础。从信息负表示算法(1994)、免疫进化算法(2000),人工免疫网络(2000)、克隆选择算法(2002)到树突细胞算法(2005)。通过利用先验知识,学者们构造出具有容错性、免疫性、鲁棒性和进化性的新型算法用于求解实际问题,在动态中寻求最优解。

人工免疫系统模型的特点包含学习记忆性、多样性、分布性、容错性和被动免疫性,这为构造高效、鲁棒、容错的方法提供了生物基础。人工免疫系统方法应用在各个领域已经有非常好的表现。希望在未来它能够和进化计算、深度学习有机结合起来,共同推动这个领域的发展。

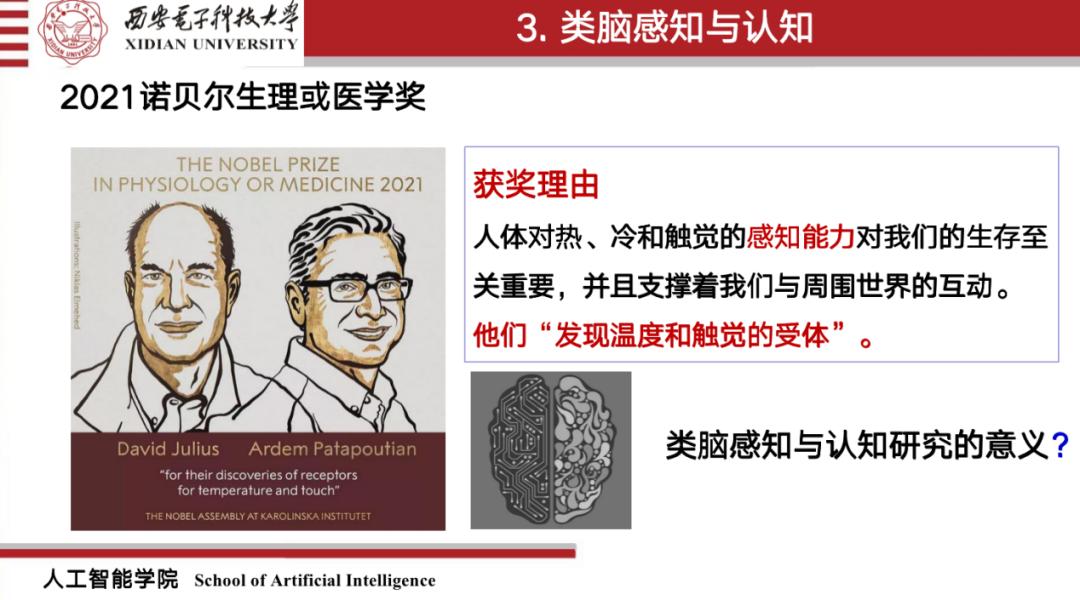

对于学习问题而言,从类脑的感知到认知,是一个漫长的过程。2021年诺贝尔的生理与医学奖授予了David Julius和 Ardem Patapoutian,说明了类脑感知与认知的研究具有特别的意义。认知科学是一门对心智及其过程进行多学科研究的科学,它包含心理、哲学、语言、人类学、人工智能神经科学。感知不仅包含了视觉、听觉、触觉、味觉等,更是教会我们去理解、思考、推断、决策、行动。

在类脑的感知和认知过程中,首先要了解脑的生物机理和基本特性。类脑的具有六个特性——也就是脑神经网络或者脑神经元的稀疏性、学习性、选择性、方向性、知识性和多样性。现在的深度学习、深度神经网络虽然模拟了这些特性,但大多只建立在脑的巨量神经元并行、突触树突的连接上。研究者们更多的热衷于前向的网络,而对于树突与树突、树突与突触、神经元与神经元之间的反馈等连接特性,以及对六性(类脑)模拟仿真研究与利用的较少。

在类脑的“稀疏性”研究中,1996年“神经元的稀疏编码学说”在Nature上被提出,直至2017年的Science上得到了生物实验的证明。类脑的“感知—学习”的特性启示我们,人类能够从少量的数据学到一般化的知识,也就是具有抽象的知识的学习能力。类脑的“选择特性”,也从生物上证明大脑细胞是具有自主可控性,显著性。表明视觉的信息加工同样具有视觉的显著注意机制,多尺度、多分辨特性。类脑感知的“方向性”,明确的指出生物大脑中存在感知方向和位置信息的方位角和倾斜角细胞的机制,这也是构造新的类脑神经网络的基础。此外,类脑感知的方向性还表现在以自我为中心的神经编码的方式,指出群神经元对空间的感知和情景的感知以及情景记忆具有特殊的意义,也对利用群体智能进行情景的理解,感知计算带来了新的启示。

对于类脑的感知和认知,从宏观层面、界观层面和微观层面上来讲,都需要回头看,需要再出发,再利用,对新发现的机理和特性进行分析、模拟。

人工智能的发展和深度学习是分不开的。从1943年1944年、1949年直到现在,经过了几起几落。而其中重要的BP算法,是1974年Paul Werbos在哈佛大学的博士论文中所提出。他对神经网络的推动是非常巨大的,是神经网络第一个可以学习多层神经网络的算法。

而据现有的生物学理论,BP算法缺乏对应的生物机制,需要发现更具有生物意义的大脑学习机制,替代反向传播机制。大脑的机制包含反馈对比、预测性编码、椎体神经元、注意力作用等。这是一个共同作用的过程,这个过程可以有通路,可以有工程上的误差传播,可以有多样性。2021年Nature communication 中指出了突触的可信、可塑性,海马的神经发生和认知的能力。对应了刚才提到的“突触树突神经元的连接和特性是具有可变化性的”。所以神经网络不仅是现在意义上权重调参;更重要的,它的结构具有变化性、可塑性、学习性和动态性。这些特性是现有深度网络所没有重视的。同样在类脑感知的过程中,脑的奖惩、学习、信息表征机制,以及突触的学习记忆,再生长和发育的机制对于整个信息的重建及编码和处理具有重要的作用,这些也是现有深度网络较少关注和模拟的。

人工智能发展到今天,由大数据驱动下的表征学习,大数据和知识先验驱动下的表征学习以及优化更有重要意义。结合今天的报告,把“进化优化”和“深度学习结合”起来,两者有非常好的目标特性和思想的启示。将两者结合是从事感知和认知领域工作者的自然选择。

从认知建模,自动学习,渐进演化,到现在大家比较关注的元学习。都在和环境变化、自然的演化、动态学习变化、外界的表征和增量结合。对我们在稀疏认知、学习、优化、计算识别的道路上构造新的模型,构造新的算法创新新的有潜力的途径有启示意义。结合了物理的特性,脑的生物机制,深度网络的特征,利用了学习的算法。我们提出了系列工作。

- 把物理的Wishart极化特性和脑的稀疏特性相结合起来,同时和并行性解决高效问题的栈式结构结合,将物理、生物并行处理的特性有机的结合,构造了Wishart的深度栈式网络。

- 把物理的特征,脑的稀疏特征、多尺度特征和卷积神经网络相结合构造了Contourlet卷积网络,解决了稀疏的、方向的、多分辨的、尺度特征的提取和表征问题。Contourlet卷积网络在挖掘和融合不同领域的特征,以及相互的关联关系上做出了非常有启示性的工作。

- 用了脊波的多尺度的表征和对抗噪声的能力,把类脑的稀疏特性结合起来,提出了Rigelet-Net网络。在解决大数据小样本奇异特征方面说匹配了实际问题的需要。

- 结合多尺度几何分析理论和散射机理,利用了物理、生物特性,抓住了稀疏的、主要的、物理的、散射的特征,提出的深度多尺度轮廓波散射网络。

- 所提出的复数Contourlet网络,匹配了电磁的、方向的、矢量的、散射的特征。

进化算法其实是从“人工”到“自动”的突围。人脑的进化包括神经网络的进化。神经网络进化应该是参数的进化和超参的调整,还有现在所忽略的结构进化和动力学过程。这个恰恰是深度网络现在比较少的关注的。大家都陷入到GPU与参数的计算过程中,并乐此不疲。但是在这个道路上,要如何实现自动的进化?如何自动的学习?从哪里去找源泉?进化计算也经过了一个漫长的过程,它和神经网络也有许多的结合也是经过了几十年的历程。1999年,姚老师就给出了进化神经网络的长篇的综述,这个对神经网络的研究是有启发性的和开拓性。进化与深度的结合应该是在解决神经网络的结构的优化,权值的优化,参数的优化的新途径。

近几年来,在这方面工作也有许多突破性的进展,除过权值和超参的优化以外,NAS(Neural Architecture Search)得到了非常快速的发展。这也证明了我们能够通过深度和神经网络的结合来解决进化效率低、复杂度高的这些问题。这个时候我们希望两个领域的科学工作者能够结合起来,去共同解决这样的问题。深度有深度的长处,深度有深度的短处,进化有进化的好处,进化有进化的短处。恰恰在学习和进化的过程中,深度和进化使许多的优点是可以互补的。在解决进化的速度慢、多样性退化和质量变低的这个道路上,深度是有潜在的意义的。

当然进化和深度的结合在求解非线性、大数据、小样本、高维度和组合爆炸的问题上,同样是有潜力的。我们应把基于数据的和基于知识的两种途径或者两种取不同的思想方法结合起来,用来对付现在所存在的这些问题上。这是有潜力的,有希望的,也是应该的。

NAS是近年来解决自动机器学习自动深度学习的有效的途径之一。虽然大家较少的关注神经网络结构,但其实神经网络结构的进化同样也有几十年的历程,也有一些出色的工作。但是这些工作没有引起大家的关注,是因为大家过多关注在GPU的计算上。所以这个时候思想首先是重要的。进化计算不需要求导,群体可以抗组合爆炸,可以得到以概率1收敛到全局最优。特别是它是对非线性随机的遍历的搜索,这是解决群体智能核心问题的法宝。这恰恰是NAS把这些特性和神经网络结合起来才有的潜力。当然今年的生物 nature neuroscience 上的出色的工作给构造神经网络提出了非常良好的生物基础。也就是说,可以利用突触的规则构建深度网络,使它能够具有良好的结构搜索的能力。

权重的进化当然也经过一个漫长过程。80年代初Hopfield提出的网络,以及RNN网络都是有动力学过程的。这个动力学过程实际上是靠动力学的演化过程来完成的。而进化恰恰是通过动力学的演化来实现全局的最优解。后来大家更多的去关注到参数的调整。大家认为BP(Back Propagation)就是深度,就是一切。其实应该好好的停下来想一想BP的局限性。BP算法怎么解决当计算梯度不存在、模型变化、海量的局部最优、海量的鞍点、组合爆炸和导数不存在的任务问题。还有什么法宝呢?参数优化问题依赖于GPU,使用大量的GPU进行计算。但是这种方法,只能说缓解了计算量的问题。但从机理上来讲,怎么样能找到自动学习快速高效的办法,仍然需要扎实的工作。超参同样存在非线性、非凸组合优化、混合优化、成本高等等这些问题,又怎么办?从哪里入手找到这个办法?超参的这个过程同样也有一个历史脉络。这个历史脉络整理出来,就是想让大家看看目前组合位爆炸问题解决了吗?非线性问题解决了吗?全局最优的问题解决了吗?

最近火热的元学习,最初开始就叫“学习”或者“学会学习”。元学习的思想能不能启示我们通过进化计算来进行自我学习。其实这个思想的提出也有几十年的时间。但这几十年来是怎么样在这条道路上前行的呢?元学习要解决的基本问题就是表征、学习器和元目标优化的问题。当然现在也提出了一系列的办法,一起来对付泛化可解释性和鲁棒性,但是远远不够。对泛化性能的提高,对可解释性的追求,对进化全局最优解的追求永远在路上。

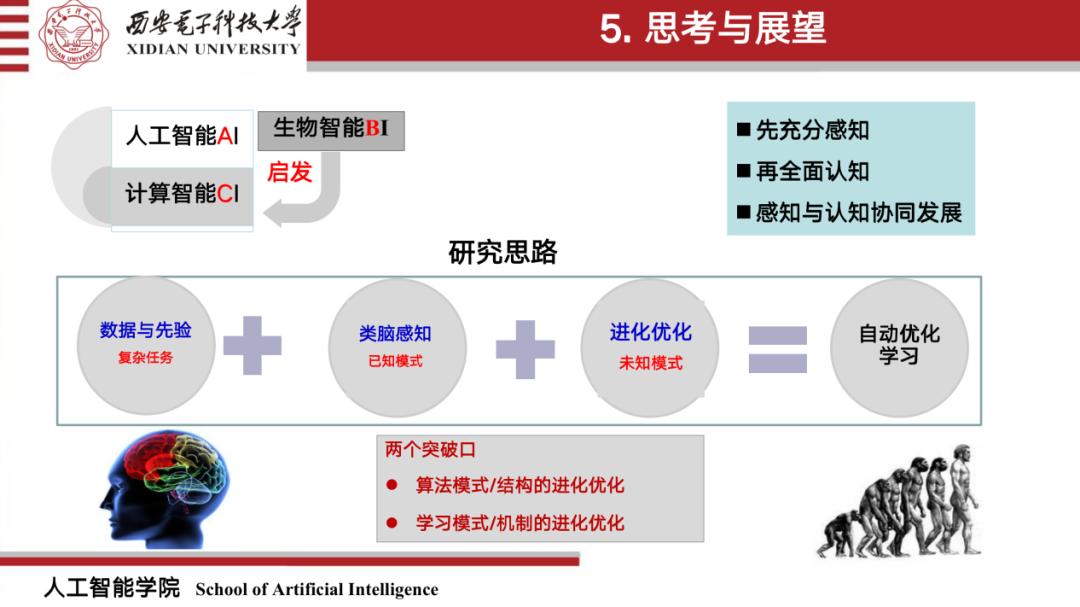

所以我们通过自然智能,包括类脑智能进行学习和优化。如果做图像的任务,要进行学习表征、决策,分类识别。同样在进化的路上,需要表征的紧凑正交、准确,学习的明确和解释的清楚。应该说,要做到耳聪目明。雷达也是这样。从最早的看得见到测得准,再到观的清,到后边辨的明,恰恰是印证了人工智能,包括进化计算和深度学习这样的历程。所追求的目的和经过的道路不谋而合,思想一脉相承相通。我们和学生在这条道路上,应该让学生理解这些东西,还要思考怎么去做。我们自己不仅要思考,而且我们要教会学生去思考进化计算和深度学习:怎么样能够很好的从相识、相知、相恋、结婚到携手前行,还有很长的道路要走。当然,对人工智能来讲,深度学习来讲,进化计算来讲,我们都是走在ABC(人工智能AI、生物智能BI和计算智能CI)的路上。

我们需要把人工智能、生物智能、计算智能有机的结合起来,这三者是相互互补的。思考我们怎么样能够充分感知、全面认知再到感知与认知的协同的发展。我们探索如何在先验知识的道路上和在数据的道路上,通过类脑感知与进化优化的结合实现自动优化的学习。这条道路上有机遇、有挑战、有问题、有希望,仍然任重而道远。希望我们共同牢记初心,不负使命,砥砺前行,认认真真扎扎实实做学问。ABC是有出路的,谢谢大家。

(通讯员 张若浛,王超,赵嘉璇,刘旭)

嘉宾简介

焦李成,欧洲科学院外籍院士,俄罗斯自然科学院外籍院士,IEEE Fellow。现任西安电子科技大学计算机科学与技术学部主任、人工智能研究院院长、智能感知与图像理解教育部重点实验室主任、教育部科技委学部委员、教育部人工智能科技创新专家组专家、首批入选国家百千万人才工程(第一二层次)、教育部长江学者计划创新团队负责人、“一带一路”人工智能创新联盟理事长,陕西省人工智能产业技术创新战略联盟理事长,中国人工智能学会第六-七届副理事长,IEEE/IET/CAAI/CAA/CIE/CCF Fellow,连续七年入选爱思唯尔高被引学者榜单。

焦院士主要研究方向为智能感知与量子计算、图像理解与类脑计算、深度学习与进化优化。曾获国家自然科学奖二等奖、吴文俊人工智能杰出贡献奖、霍英东青年教师奖、全国模范教师称号、中国青年科技奖、及省部级一等奖以上科技奖励十余项。