本人在工作过程中需要Nutch2.3,基于hadoop的爬虫,准备用Hbase存储爬取的数据,于是研究并记录了Hadoop2.5.2+Zookeeper3.4.6 + HBase0.98.8-hadoop2环境搭建,花费了很多加班时间啊,废话不多说,直接上实战干货。记录在云笔记中,可能有点乱,大家担待下,最好用电脑看啊。

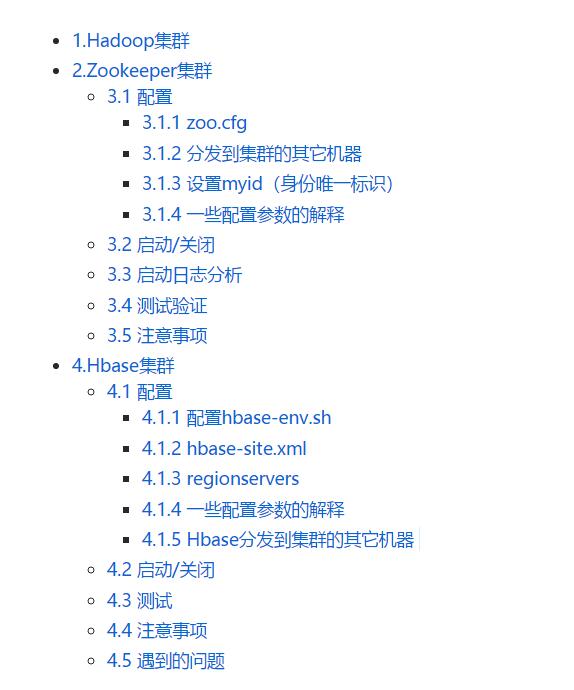

先给个目录截图(参考)

1.Hadoop集群

参考之前我的hadoop集群搭建系列文章:

Hadoop 2.5.2分布式集群搭建(一)基本环境搭建(虚拟机)

Hadoop 2.5.2分布式集群搭建(二)Hadoop部署配置

2.Zookeeper集群

3.1 配置

3.1.1 首先编辑zoo.cfg配置文件

# cd /usr/local/# tar -zxvf zookeeper-3.4.6.tar.gz # cd zookeeper-3.4.6 # cp conf/zoo_sample.cfg conf/zoo.cfg # vim conf/zoo.cfgtickTime=2000 dataDir=/usr/local/zookeeper-3.4.6/dataclientPort=2181initLimit=5syncLimit=2 server.1=Hmaster:2888:3888 server.2=Hslave1:2888:3888 server.3=Hslave2:2888:3888

3.1.2 降配置文件一一分发到集群的其它服务器

把zookeeper文件夹连同修改后的配置文件通过scp拷贝到另外两台机器(Hslave1, Hslave2)上。

# cd /usr/local

# scp -r zookeeper-3.4.6 root@Hslave1:/usr/local

# scp -r zookeeper-3.4.6 root@Hslave2:/usr/local

3.1.3 设置好每天机器的myid(这是身份唯一标识)

首先创建各自的目录

在Hmaster, Hslave1, Hslave2上创建dataDir中配置的目录/usr/local/zookeeper-3.4.6/data。

// 先创建目录

# mkdir /usr/local/zookeeper-3.4.6/data

// Hmaster

# echo "1" > /usr/local/zookeeper-3.4.6/data/myid

// Hslave1

# echo "2" > /usr/local/zookeeper-3.4.6/data/myid

// Hslave2

# echo "3" > /usr/local/zookeeper-3.4.6/data/myid

3.1.4 一些配置参数英语名词的解释

tickTime :心跳时间,单位毫秒。同时tickTime又是zookeeper中的基本单位,比如后面的initLimit=5就是指5个tickTime时间,在这里是10秒。

dataDir :存储数据信息的本地目录。

3.2 启动/关闭服务命令

{ZOOKEEPER_HOME} /bin/zkServer.sh start

启动和关闭命令必须到zookeeper集群的每个机器上,没有像start-dfs.sh那样的命令可以一下子把整个集群启动。

3.3 然后启动日志的分析

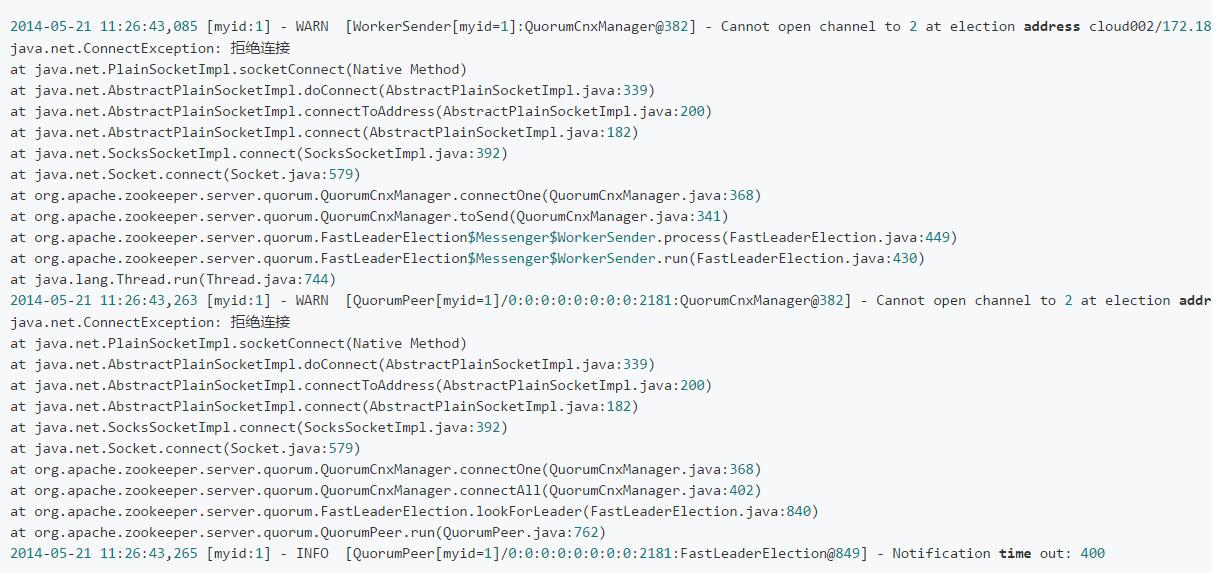

你可能会可能出现如下情况

由于ZooKeeper集群启动的时候,每个结点都试图去连接集群中的其它结点,先启动的肯定连不上后面还没启动的,所以上面日志前面部分的异常是可以忽略的。通过最后面部分可以看到,集群选出了一个最终Leader后,运行稳定。如果 其他结点可能也出现类似问题,这都属于正常情况。

3.4 命令测试验证

{ZOOKEEPER_HOME} /bin/zkServer.sh status

以下是结果示例,你们可以看到各机器的角色是follower还是leader。

[root@hmaster zookeeper-3.4.6]# jps

2118 Jps

2013 QuorumPeerMain

[root@hmaster zookeeper-3.4.6]# bin/zkServer.sh status

JMX enabled by default

Using config: /usr/local/zookeeper-3.4.6/bin/../conf/zoo.cfg

Mode: follower

[root@hslave1 zookeeper-3.4.6]# bin/zkServer.sh status

JMX enabled by default

Using config: /usr/local/zookeeper-3.4.6/bin/../conf/zoo.cfg

Mode: leader

[root@hslave1 zookeeper-3.4.6]# bin/zkServer.sh status

JMX enabled by default

Using config: /usr/local/zookeeper-3.4.6/bin/../conf/zoo.cfg

Mode: follower

3.5 过程中一些注意事项

对于一个包含3台server的Zookeeper集群,最多容许关闭一台(如果被关闭的是leader,则会重新选举出一个)。如果关闭两台,则剩下那台虽然进程QuorumPeerMain还在,但zkServer.sh status查看状态则显示Error contacting service. It is probably not running。

对于一个包含5台server的Zookeeper集群,最多容许关闭两台。关闭三台,则剩下两台虽然进程QuorumPeerMain还在,但也显示同样的错误。

(如果这个时候用Java程序去连接Hbase,则会提示:org.apache.hadoop.hbase.ZooKeeperConnectionException: Can't connect to ZooKeeper)

通常情况这里会出现有两个常见的疑问:

1) 当3台server关闭一台时,只剩下两台时,无法形成majority,那么它是如何选举出leader的?

2) 当5台server关闭三台时,剩下两台,为什么不能像第一种情况中一样正常工作?

这两个问题的答案是同一个,Zookeeper中的所谓majority voting机制,其majority是针对原始的server数量,不是指变化后的数量,这个原始的数量即你配置在zoo.cfg中的server个数。

还有一个常见的问题是为什么推荐使用奇数个Zookeeper server,那是因为3个server与4个server能够提供的可靠性是一样的,3台server的集群允许其中一台server宕机,而4台server的集群也只能容许其中一台server宕机,因为如果两台server宕机,那么剩下两台,对比于原来的4台,2/4不够成大多数。

4.Hbase集群

4.1 配置

4.1.1 配置hbase-env.sh

配置JAVA_HOME和pids目录,export HBASE_MANAGES_ZK=false,这表示不使用hbase自带的zookeeper,而使用外部的zookeeper(这里指我们在上面建的zookeeper)

# The java implementation to use. Java 1.6 required.

export JAVA_HOME=/usr/java/default

...

# The directory where pid files are stored. /tmp by default. 尽量不要用默认的tmp

export HBASE_PID_DIR=/usr/local/hbase-0.98.8/pids

...

# Tell HBase whether it should manage it's own instance of Zookeeper or not.

export HBASE_MANAGES_ZK=false

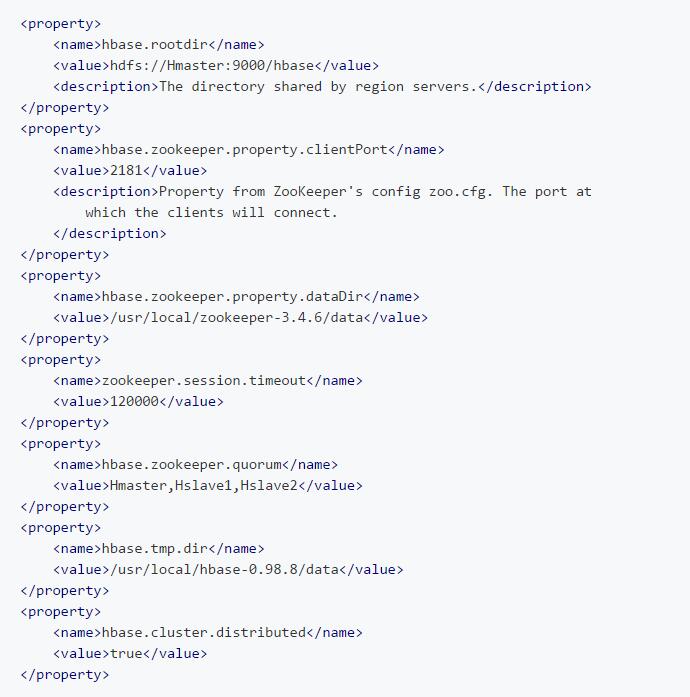

4.1.2 hbase-site.xml

4.1.3 regionservers

Hslave1Hslave2 Hslave3

4.1.4 一些配置参数的解释

hbase.zookeeper.property.clientPort:指定zk的连接端口

zookeeper.session.timeout:RegionServer与Zookeeper间的连接超时时间。当超时时间到后,ReigonServer会被Zookeeper从RS集群清单中移除,HMaster收到移除通知后,会对这台server负责的regions重新balance,让其他存活的RegionServer接管.

hbase.zookeeper.quorum:默认值是 localhost,列出zookeepr ensemble中的servers

4.1.5 Hbase分发到集群的其它机器

将Hbase目录分发到Hsalve1,Hslave2,Hslave3上

# cd /usr/local

# scp -r hbase-0.98.8 root@Hslave1:/usr/local

# scp -r hbase-0.98.8 root@Hslave2:/usr/local

# scp -r hbase-0.98.8 root@Hslave3:/usr/local

4.2 启动/关闭

bin/start-hbase.sh

bin/stop-hbase.sh

4.3 测试的方法

在Hmaster上执行

{HBASE_HOME}/bin/hbase shell

进入shell命令行,通过创建表等操作来检查不是不工作正常。

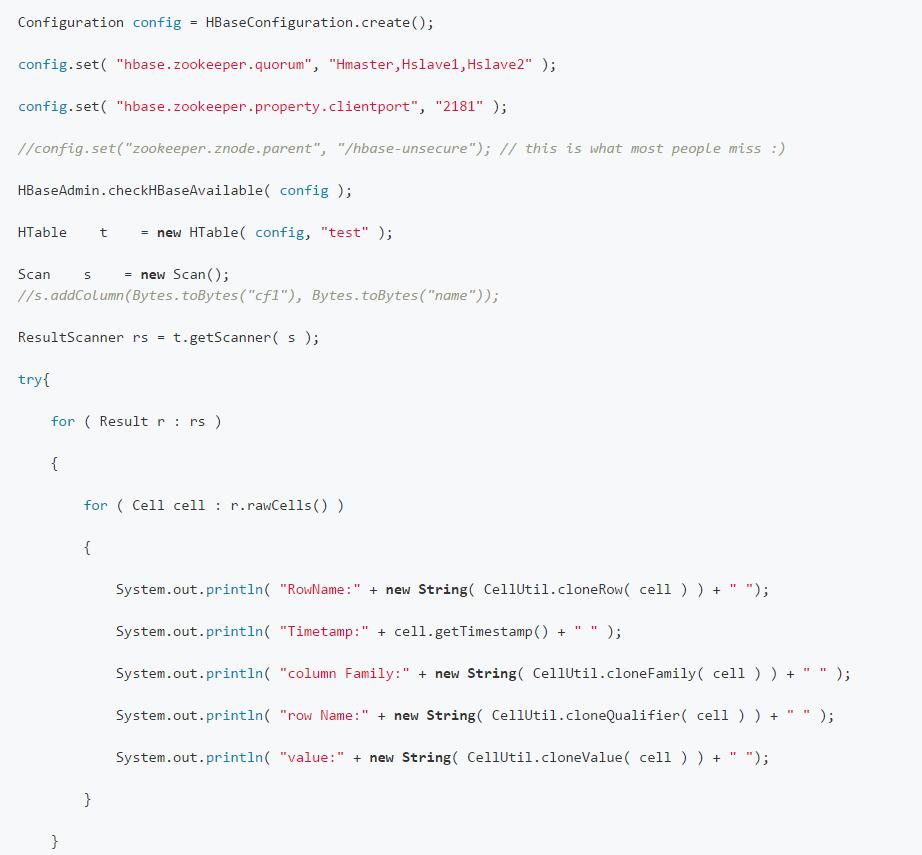

或者通过一个简单的Java程序来测试:

注意,java测试程序所在机器的hosts文件,注意必须有全FDQN(fully qualified domain name, 参见上面linux中的hosts文件),否则有java访问时会提示找不到Hmaster.mh.com

4.4 注意事项

HBase集群需要依赖于一个Zookeeper ensemble。HBase集群中的所有节点以及要访问HBase的客户端都需要能够访问到该Zookeeper ensemble。HBase自带了Zookeeper,但为了方便其他应用程序使用Zookeeper,最好使用单独安装的Zookeeper ensemble。

此外,Zookeeper ensemble一般配置为奇数个节点,并且Hadoop集群、Zookeeper ensemble、HBase集群是三个互相独立的集群,并不需要部署在相同的物理节点上,他们之间是通过网络通信的。

需要注意的是,如果要禁止启动hbase自带的zookeeper,那么,不仅仅需要刚才的export HBASE_MANAGES_ZK=false配置,还需要hdfs-site.xml中的hbase.cluster.distributed为true,否则你在启动时会遇到Could not start ZK at requested port of 2181 错误,这是因为hbase尝试启动自带的zookeeper,而我们已经启动了自己安装的那个zookeeper,默认都使用2181端口,所以出错。

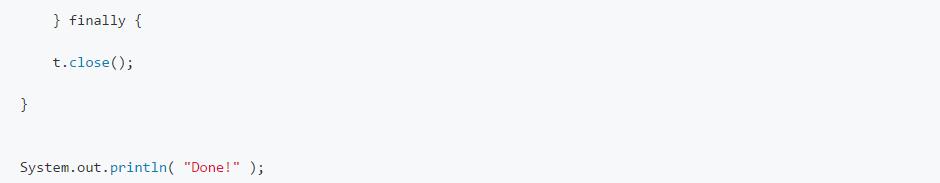

还有,有时候会遇到stop-hbase.sh执行很长时间未结束,很可能的原因是你之前把zookeeper关闭了.

最后,Hbase不需要mapreduce,所以只要start-dfs.sh启动hdfs,然后到zookeeper各节点上启动zookeeper,最后再hbase-start.sh启动hbase即可.

4.5 遇到的问题

HBbase 0.98.8启动后,zookeeper集群独立,没有被Hbase管控,

1.启动时查看主控节点的日志hbase-hadoop-master-master.log,其中的报错如下,

NotServingRegionException: Region hbase:meta,,1 is not online Hslave2...

2017-11-13 15:16:32,003 INFO [master:Hmaster:60000] catalog.CatalogTracker: Failed verification of hbase:meta,,1 at address=Hslave2,60020,1510556718821, exception=org.apache.hadoop.hbase.NotServingRegionException: org.apache.hadoop.hbase.NotServingRegionException: Region hbase:meta,,1 is not online on Hslave2,60020,1510557380354 at org.apache.hadoop.hbase.regionserver.HRegionServer.getRegionByEncodedName(HRegionServer.java:2776) at org.apache.hadoop.hbase.regionserver.HRegionServer.getRegion(HRegionServer.java:4333) at org.apache.hadoop.hbase.regionserver.HRegionServer.getRegionInfo(HRegionServer.java:3676) at org.apache.hadoop.hbase.protobuf.generated.AdminProtos$AdminService$2.callBlockingMethod(AdminProtos.java:20158) at org.apache.hadoop.hbase.ipc.RpcServer.call(RpcServer.java:2027) at org.apache.hadoop.hbase.ipc.CallRunner.run(CallRunner.java:108) at org.apache.hadoop.hbase.ipc.RpcExecutor.consumerLoop(RpcExecutor.java:110) at org.apache.hadoop.hbase.ipc.RpcExecutor$1.run(RpcExecutor.java:90) at java.lang.Thread.run(Thread.java:745)

或者

2.启动hbase时,hmaster启动后又消失了,且hin/base shell后,list执行报错"ERROR:can't get master address from ZooKeeper; znode data == null"

一般认为是,停止Hbase服务时导致zookeeper的meta数据丢失或损毁所致,解决办法为,先停止HBase服务,再停止ZooKeeper服务,然后把zookeeper的每个节点的zoo.cfg配置文件指定的dataDir=/hadoop/zookeeper-data目录的文件rm清除掉,然后重启zookeeper,再重启hbase,接着去观察hbase主节点日志hbase-hadoop-master-master.log日志文件,发现一切正常时问题已经得到了解决。