转自新浪科技,文/CJ 编辑/Vicky Xiao,

来源:硅星人(ID:guixingren123)

关上Deepfake的潘多拉魔盒,他们能做到吗?

自从Deepfake被发明以来,它就一直朝着人性的阴暗面前进。

B站的用户让蔡旭坤在偶像实习生C位出道,他的脸和六小龄童互换,毫无违和感。民间科技流已经能够玩坏AI变脸教程。

但与此同时,每个人也更容易受到攻击:为了敲诈勒索而对视频进行伪造,为了破坏声誉而对视频进行不雅处理,或者为了制造混乱而对视频进行恐怖处理,这一切都是因为Deepfake的开源技术,使得这一切比以往任何时候都更容易。

在Ps破坏了公众对图片的信任之后,Deepfake正在破坏公众民众对视频的信任。没有人愿意看到他们的脸在互联网上说一些他们从未说过的话、做没做过的事。很多人身伤害,因为影响不够巨大而投诉无方。

Deepfake在美国的打假团队,不仅在大学实验室和研究中心寻找破绽的进程上取得了进展,而且在创业趋势方面逐步兴起。

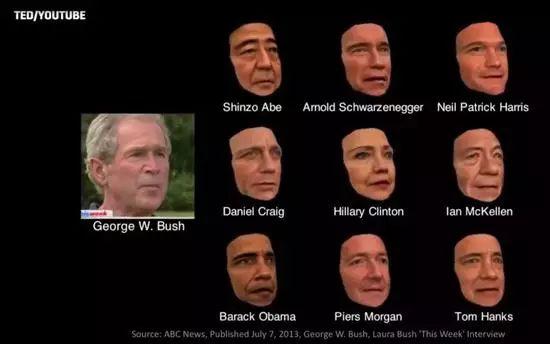

让一众名人换上布什的面部动作 图 TED

但这是一场“你有张良计,我有过墙梯”的竞赛。每一篇研究Deepfake的论文似乎都表明,通过修复自身的缺陷,该技术可以更进一步。

但是,他们能关闭Deepfake的潘多拉魔盒吗?

用打假Deepfake创业

希瓦•金塔里(Shiva Kintali)已经离开普林斯顿大学计算机科学系(Princeton computer science department),正在为硅谷创业鉴别伪造视频。她在普林斯顿大学担任了四年的讲师。他的合作对象包括警察、记者、保险公司等,通过机器学习发现伪造视频的漏洞,并利用区块链录信息等技术协助识别。

金塔里的网站已经可以上传图片、音频和视频,可以分析修改的痕迹。他还在开发一款手机摄像头应用,该应用使用人工智能为图像添加地点、时间和水印,并在区块链上打印原始信息。一旦传输的图像信息与原始图像不一致,就很容易判断其真实性。

这些产品旨在帮助记者、媒体公司、政治竞选团体、执法机构(如FBI、NSA)、保险公司(因虚假事故照片而面临保险索赔)和大公司(如Facebook、Twitter、Redditt、PornHub)停止在其平台上传播虚假视频、音频和照片。

Deepfake降低了视频欺诈的门槛。面对难以辨别的视频数据的真实性,记者不知道是否要公布,保险公司不知道是否要索赔还是报警诈骗,警方收集证据,还需要专业的工具来鉴定图片和视频的真实性。

目前传播的假视频大多是“浅度伪造”,但由于数量庞大,造成了诸多麻烦。斯坦福大学的研究人员从专业的鉴别公司那里了解到,他们有三个主要问题:量太多、可供身份识别的时间太少,以及缺乏标准化的工具。

因此,研究人员正在寻找可以大规模使用的方法。Facebook和Twitter等社交网站上的图片和视频爆炸式增长,而揭露这些谣言所需要的时间却越来越短。公众也不可能雇佣专业人士来识别出真伪。

Truepic是第一个商业图像验证平台,它推出了一款智能摄像头app,用户拍摄的照片将上传至服务器,照片和视频在创建时进行身份验证,获得独特的编码。

相机应用从设备上捕捉传感器数据,在传输前对照片或视频进行加密,运行20多个图像取证测试,并在几秒钟内将图像的加密签名打印到公共区块链上,使信息不可篡改。

这是适合电子商务平台和公民记者之类的用户使用的“证明清白”的一种方式。如果用户将图像发送给收件人,Truepic允许收件人验证图像的来源和原数据完整性。任何重新传输的多媒体材料都可以与区块链上的原始信息进行比较,以区分真假。

在Deepfake的威胁下,认证图像和视频已成为相机应用程序的一个卖点。但这类营利性产品在用户中引发了新的隐私担忧。毕竟,谁能保证Truepic不会作恶呢?

算法打算法

总部位于硅谷的SRI国际人工智能公司(SRI International AI)正在“以火还火”,利用伪造视频训练算法,以便更好地识别赝品。当人们上传视频到社交网站时,平台需要重新编码视频。这是检测假视频的好时机。

但随着Deepfake的漏洞越来越多,使用算法操作的难度也越来越大。

防伪人工智能最初是仿冒人工智能训练的一部分,二者处于生成对抗性网络的两端。一个生产器,一个鉴别器,真真是道高一尺,魔高一丈。

由于Deepfake的技术是关于篡改数据的,鉴别器正在寻找任何篡改的痕迹。一种方法是基于像素的视频检测。而视频呢,实际上是成千上万帧图像的连续显示。对每个像素的变化痕迹进行详细的检测,真的是一个相当大的工程。

此外,虚假视频的面部表情仍然存在缺陷。伪造的面部表情通常与脸部的其他部分不一致,计算机算法可以在图像或视频中检测到这种不一致。

例如,在原始的Deepfake视频里的人物,他们的眨眼的方式都有点奇怪。

纽约州立大学奥尔巴尼分校(state university of New York at Albany)计算机科学副教授吕思伟(Siwei Lyu)写道,成年人眨眼的时间间隔在2到10秒之间,一次眨眼需要十分之一到十分之四秒。这是正常视频中人类的正常眨眼速度,但许多假视频无法做到这一点。

当时,由于缺少闭眼图像数据,算法训练不完善,视频人脸总是有一种“哪里出了问题”的感觉。

然而,通过使用闭着眼的面部图像或使用视频序列进行训练,可以提高眨眼间隔。虚假视频的质量将不断提高,研究人员将继续寻找检测其它漏洞的方法。

南卡罗莱纳大学的研究人员Wael Abdel -Almageed说,社交网络可以使用算法大规模识别Deepfake。为了使这个过程自动化,研究人员首先建立了一个神经网络来“学习”人类说话时的动作的重要特征。然后,研究人员使用这些参数,在伪造视频堆叠帧中输入AI模型,以检测随时间推移时产生的不一致性。

普渡大学(Purdue university)的研究人员采用了类似的方法,他们认为,随着作为训练模型的Deepfake视频数据量越来越大,它将变得更准确,更容易检测到假视频。

随着2020年美国大选的临近,研究人员最迫切的是如何防止Deepfake从低俗娱乐演变为操纵*意民**。希望一键打假的速度,能赶上一键换脸的速度。

声明:我们尊重原创者版权,除确实无法确认作者外,均会注明作者和来源。转载文章仅供个人学习研究,同时向原创作者表示感谢,若涉及版权问题,请及时联系小编删除!

精彩在后面

Hi,我是超级盾

更多干货,可移步到,微信公众号:超级盾订阅号!精彩与您不见不散!

超级盾:从现在开始,我的每一句话都是认真的。

如果,你被攻击了,别打110、119、120,来这里看着就行。

截至到目前,超级盾成功抵御史上最大2.47T黑客DDoS攻击,超级盾具有无限防御DDoS、100%防CC的优势。