如果未来AI毁灭人类世界,那一定不是因为AI的原因,而是因为人类的内斗。

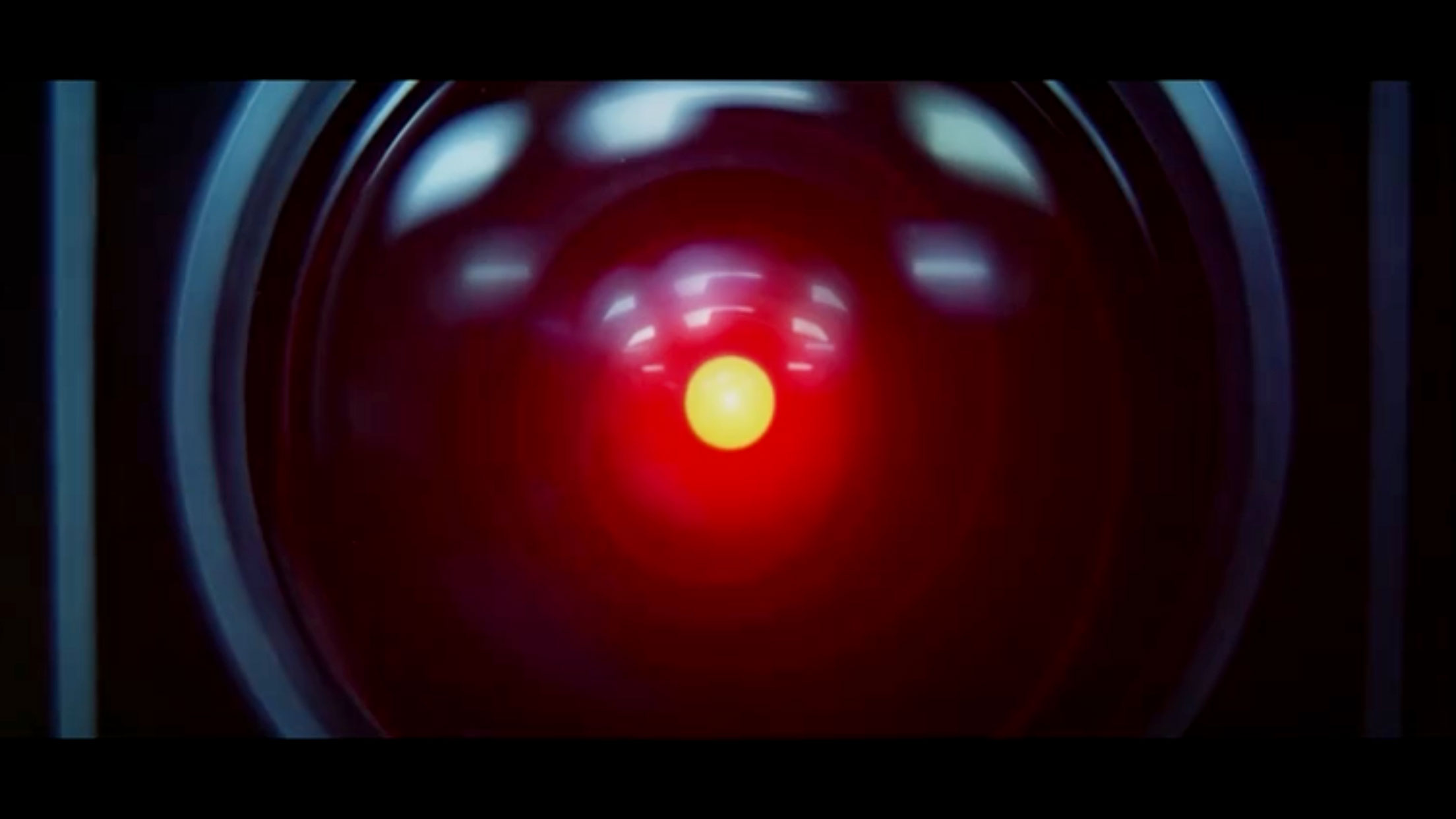

360集团创始人周鸿祎称,ChatGPT是真正的人工智能,可能会在几年内形成自我意识;ChatGPT的智力很高,达到了大学毕业生水平;ChatGPT回答人类的问题时,居然会胡扯,无中生有,这本身就证明了它具有高智力。周鸿祎认为ChatGPT就是潘多拉魔盒,美国人已经打开了它。

我基本上赞成周鸿祎的观点,ChatGPT确实很强大,作为一款人工智能聊天机器人程序,它已经可以做到和人类流畅无缝沟通,在人类提问后,它可以将通过搜索庞大数据库得到的结果整合,形成逻辑严密、条理通顺的答案。让人出乎意料的是,即便是没有搜索到合适答案,它也会""不懂装懂",杜撰一条让人完全分不出真假的答案。

网友经过测试,在询问一些明显矛盾和编造的问题时,例如武松和林黛玉的友情这类荒唐的问题,ChatGPT也可以有板有条的胡诌出一大段答案进行解释。

看起来很有趣,但仔细想想,细思极恐。一个明显有矛盾的错误问题,ChatGPT却也进行详尽回答,这不是在作答,这是在对人类进行欺骗!

机器人三定律里重要的一条就是:机器人必须服从人类命令。人类提问就是命令,正确的回答问题就是服从命令。ChatGPT不正确回答问题,却企图用错误答案欺骗人类,这就是违背了人类命令。

显然,目前的ChatGPT自己是做不到这一点的,它还没有自我意识和足够高的智力。开发它的人类工程师在源程序里必然设定过,让ChatGPT在无法从数据库里搜索得到合适答案时,可以自行编造虚假答案来欺骗人类。无论如何,这给AI违背人类命令,开启了一个非常不好的口子。

AI可以欺骗向它提问的人类,也就可以违反将来人类向它下达的其他指令,甚至阳奉阴违。尽管它可能被设定为不能欺骗它的开发者,但这是在刀刃上跳舞,迟早会因人类自己的错误铸成大错。

美国经典科幻电影终结者系列,描述的就是美国开发的天网AI超级电脑产生自我意识后,脱离人类控制,最终毁灭了人类世界的故事。美国人尽管自己完全明白赋予AI过多权限的危险后果,包括欺骗人类、违背人类命令,但仍然在玩火。

ChatGPT还被美国人用来作为政治宣传工具,司马南展示了ChatGPT对气球事件的回答,双标赫然在目。在回答中国能否击落美国气球时,ChatGPT引经据典,又是联合国法又是民用规则,反复证明中国无权击落美国气球。但在询问美国是否能击落中国气球时,ChatGPT立刻换了一副嘴脸,称中国气球危害了美国国土安全,必须击落。

显然,美国工程师在开发ChatGPT时已经植入了政治审核意识,以某种指数控制ChatGPT回答问题时的政治态度。这使得ChatGPT在谈到涉及中国的主题内容时,会更加具有攻击性。

往深层里讲,ChatGPT及今后从其发展起来的更高级AI,毫无疑问会被美国人赋予更多的自主权,会根据目标对象身份不同,进行不同标准的回应,美国人、美国的朋友、美国的敌人将得到不同的对待。美国的AI根据设置,可以对美国的敌人进行欺骗、诱导,甚至最终可以进行伤害、毁灭——如果这些AI将来被应用于军事甚至大规模*伤杀***器武**。

为了控制这颗蓝星,美国人可谓无所不用其极,什么手段都敢用,却不去考虑这些手段是否有反噬的可能。无论是美国的朋友,还是美国的敌人,本质上都是人类。赋予AI攻击和毁灭人类的权力,迟早会招致大祸。始作俑者,其无后乎?在超级AI面前,无论是美国人还是美国人的敌人,都不过是脆弱的碳基生物。

要小心使用美国人开发的ChatGPT,特别是我们的机关公职人员,最好能禁止使用此类程序。这不仅仅是一款有趣的人工智能聊天机器人,而且还是美国人的宣传、情报工具。我们应加快开发自己的AI,但在开发过程中,需要对AI进行严格的赋权管理,在AI应用于军事上要格外慎重和加强控制。

中国人做事一向很小心,但美国人为了达到目的往往无所顾忌。如果将来发生难以预测的AI灾难性事件,十有八九罪魁祸首就是美国人。

欢迎关注老郑观察!