谷歌如何使用人工智能来改变谷歌翻译这项颇受欢迎的服务,以及机器学习如何重塑计算。

序言:你所读到的就是你自己

在十一月初的某个周五晚上,Jun Rekimoto(东京大学人机交互领域的杰出的教授)正准备在线演讲,他突然注意到社交媒体滚动条上有一些特别的内容。这些内容是关于谷歌翻译的,这项流行的机器翻译服务最近突然有了大幅改善。Rekimoto开始研究谷歌翻译并用它做了一些测试,测试结果令他非常震惊。虽然已经夜深,但谷歌翻译取得的进展依然让Rekimoto久久无法入睡。

Rekimoto在一篇博客中写了他的初步发现。首先,他用谷歌翻译翻译了《了不起的盖茨比》中的一些句子,并与1957年Takashi Nozaki译版和最新的Haruki Murakami的译版进行对比。Rekimoto后来通过电子邮件向我解释,Murakami的版本语言非常细腻,具有独特的“Murakami风格”。相比之下,谷歌的翻译虽然有些不自然,但是对他来说“更透明”。

Rekimoto博客的后半部分从日译英的方向测试了谷歌翻译。他先是自己用日语翻译了海明威的《乞力马扎罗的雪》的开头部分,然后把这段话通过谷歌翻译转译成英语。他列出了此版本与海明威的原版,并让读者猜测哪个版本是机器完成的。

NO. 1:

Kilimanjaro is a snow-covered mountain 19,710 feet high, and is said to be the highest mountain in Africa. Its western summit is called the Masai “Ngaje Ngai,” the House of God. Close to the western summit there is the dried and frozen carcass of a leopard. No one has explained what the leopard was seeking at that altitude.

NO. 2:

Kilimanjaro is a mountain of 19,710 feet covered with snow and is said to be the highest mountain in Africa. The summit of the west is called “Ngaje Ngai” in Masai, the house of God. Near the top of the west there is a dry and frozen dead body of leopard. No one has ever explained what leopard wanted at that altitude.

即使是以英语为母语的人,也很难分辨出第二段是由机器完成的。这两段翻译是如此的相近,Rekimoto甚至觉得这很神奇。因为Rekimoto非常熟悉谷歌翻译之前的能力,甚至在24小时前,谷歌只能翻译成下面这段话:

Kilimanjaro is 19,710 feet of the mountain covered with snow, and it is said that the highest mountain in Africa. Top of the west, “Ngaje Ngai” in the Maasai language, has been referred to as the house of God. The top close to the west, there is a dry, frozen carcass of a leopard.Whether the leopard had what the demand at that altitude, there is no that nobody explained.

Rekimoto在Twitter上向他的十万个粉丝公布了他的发现,在接下来的几个小时里,成千上万的人发出他们使用机器翻译的结果。有些是比较成功的,但也有些是非常滑稽的。

在东京破晓之时,谷歌翻译登上了日本Twitter热度榜的第一位,甚至连人气动漫和人气偶像少女的被挤了下去。每个人都很惊奇:谷歌翻译为何能如此让人刮目相看?

四天之后,来自世界各地的上百名记者、企业家和广告客户齐聚于谷歌的伦敦办公室中,观看谷歌的特别发布会。客人们的甜点是印有翻译标志的幸运饼干,每个人的面前还放有一张纸条,一面写着不同国家的短语,另一面邀请客人们*载下**谷歌翻译的软件。桌子上还摆放了甜甜圈和冰沙盘,旁边的标语牌标注了各种国家的风味。过了一会,所有人来到了一个豪华的黑暗剧场中。

上图:Sundar Pichai,谷歌的首席执行官,在他加利福尼亚州山景城的办公室外。

伦敦市长Sadiq Khan首先上台演讲。演讲的开始,市长提到他有个朋友觉得市长就像谷歌一样。于是市长问朋友:“为什么?因为我什么都懂?”朋友否认道:“不是的,是因为你就像谷歌一样,总是试图把我的话补充完。”观众们纷纷被市长的幽默逗笑。随后,谷歌的首席执行官Sundar Pichai上台发表演讲。

Pichai此行的目的之一就是启动谷歌伦敦国王大道的新大楼,预示着公司完成了去年提出的转型计划的初始阶段。Pichai曾经多次在不同场合说过谷歌的未来将以“AI为先”,这在理论上听起来很复杂,引发了许多学者的推测。在实践生产中意味着,未来谷歌将不再依靠传统计算编程来生产产品,而是“机器学习”。

谷歌公司中有一个鲜少提及的部门,谷歌大脑。这个部门成立于五年前,一直遵循着一个原理:人工“神经网络”能够像婴儿一样,通过不断的尝试和犯错来认知这个世界,最终拥有像人类一样的灵活性。这其实并不是一个新理论,早在现代计算机初步发展的20世纪40年代就出现了。但当时大部分科学家并不看重,认为它过于深奥。直到2011年,谷歌大脑证明了将这个强大的方法运用在人工智能领域里可以解决此前几十年的棘手问题。例如,此前谷歌手机在语音识别方面一直效果不是很好,直到谷歌将机器学习算法移植到手机平台后,语音识别精度已经可以和人类媲美。而在图像识别领域也同样取得了良好的效果。一年前,谷歌大脑就已经将这些核心技术成功运用在消费级产品里。

谷歌翻译于2006年首次亮相,目前已经成为谷歌最可靠和最流行的应用之一。每天,谷歌翻译会面对 5 亿个月度活跃用户的 1400 亿个不同语种的单词。现在它已经不是座位一个独立的应用存在,更是已经集成到Gmail、Chrome 及许多其它谷歌产品中了,谷歌将它作为其数字商务中的一个无缝贴合的部分。Pichai在台上讲到,直至叙利亚难民危机之时,公司才意识地区间的翻译交流是何等重要。他背后屏幕的陡峭的曲线图显示,阿拉伯语与德语互译的翻译请求最近增长了五倍之多。(这个结果也符合Pichai的内心想法,他在印度出生成长,那里有几十种不同的语言。)谷歌翻译此后也在逐步增加新的语言和功能,但是过去的四年,发展速度正在逐年减缓。

截至到上个周末,谷歌翻译已经在美国、欧洲、亚洲等地区完成了基于人工智能的转换,包括西班牙语、葡萄牙语、法语、德语、中文、日语、韩语及土耳其语在内的语言与英语的互译。而其它上百种语言也即将实现互译,谷歌预计将会以每月八个的速度在年底前更新完毕。而对于谷歌工程而言,只花费九个月的时间就完成这一重大革新无疑是一个惊喜。AI系统一个通宵所取得的进展就相当于过去所取得的进展之和。

Pichai对含蓄的古典文学尤为偏爱,一个月前,他曾告诉我,在他加利福尼亚州山景城的办公室里,有些文字还是需要谷歌翻译来辅助显示,毕竟并不是所有人都像物理学家Robert Oppenheimer一样能读原版的《博伽梵歌》。因此在伦敦的发布会上,幻灯片上出现了博尔赫斯的经典名言:“Uno no es lo que es por lo que escribe, sino por lo que ha leído.”

Pichai大声地读出旧版谷歌翻译翻译出来的拙劣的句子:“One is not what is for what he writes, but for what he has read.”

而在大屏幕的右边,新的AI系统版本则翻译的更加优雅:“You are not what you write, but what you have read.”

这是有一个对新版的谷歌翻译非常恰当的描述:在某种意义上,谷歌翻译是第一条可以通过学习理解任何事物的机器。

谷歌以AI为中心重组公司。在过去的四年中,谷歌、Facebook、苹果、亚马逊、微软和中国百度等六家公司都围绕AI人才展开了一场军备竞赛,尤其是在大学。企业纷纷到顶尖的学术院校挖掘人才,给人才以丰富的资源和极大的自由。在硅谷,Facebook的CEO Mark Zuckerberg会亲自通过电话和视频聊天软件跟公司最优异的研究生进行会话,七位数的起薪根本不在话下。参加人工智能最重要的学术会议的人数增加了近四倍。大家所关注的不仅仅是小小的创新,还有该如何掌控全新的计算平台:无处不在的人工智能。

我们好像理所当然地就开始使用“人工智能”这一短语,但它其实一直是引发争议的根源。想象一下,如果你回到20世纪70年代,在大街上拦住一个路上,拿住智能手机并向她展示手机里的谷歌地图。你可能需要不停地向她解释,你并不是穿着奇怪的巫师,从口袋里掏出的手机也不是什么黑色护身符,它只是一个比阿波罗时光机更强大的电脑。实际上,谷歌地图就是能跟她展示什么是“人工智能”的例子。在某种意义上,谷歌地图确实是人工智能的例子。它能帮你规划从酒店到机场的路线,而且比人类能完成得更快更好。它还能做一些人类显然不能做的事情:它可以判断交通状况;规划最佳路线;在你走错路时,它能重新定位并进行路线的重新规划。

实际上,如今没有人会把谷歌地图跟高贵的“AI”相提并论。所以我们在使用“智能”这个词的时候,是带“情感”色彩的。人工智能可以区别HAL和其它任何用织机或手推车就可以做出的东西。我们能自动化一项任务,涉及到的相关技能会转变为单纯的机制。现在,谷歌地图似乎还不能称之为人工智能,充其量是机器人:它只接受一个明确的需求(从一个地方到另一个地方),并尽力满足这种需求。因此,“人工智能”的所对应的实际应用其实范围很小。

Pichai的终极目标是区分AI应用和“通用人工智能”。通用人工智能不涉及对显式指令的忠实遵守,它是为一般情况下的一般用途而设计通用工具。Pichai认为,他公司的未来取决于通用人工智能。想象一下,如果你告诉谷歌地图,“我想去机场,但需要在中途停一下给我的侄子买礼物。”一个通用的智能服务,就像三年前的电影《她》中,由Scarlett Johansson配音的那个无处不在的助手一样,她像好朋友一样了解你的情况:你侄子的年龄,你通常喜欢给孩子买什么礼物,以及哪里有能买礼物的商店。但是,一个真正聪明的地图能做一些好朋友考虑不到的事,比方说,你侄子学校的孩子里,最近流行什么玩具。如果聪明的机器能够辨别一些错综复杂的数据,从中找到过去我们做过的事情中暗藏的规律性,那么它就可以推断我们的想法。

AI助手是人工智能的新浪潮,苹果的Siri、Facebook的M,还有亚马逊的Echo都是机器学习的产物,作用都很相似。然而,机器学习并不一定只局限于此。今年,三星的医学成像子公司宣布其新的超声设备能够检测乳腺癌。公司也在招贤纳士,以扩大计算机的工业应用。DeepMind于2014年被谷歌收购,AlphaGo在围棋游戏中击败了人类围棋大师,尽管当时人类预测人工智能要想战胜人类还需要10年。

1950年,Alan Turi吴恩达在那篇著名的文章中提出了一个人工智能的测试:一台计算机是否能在5分钟的文本交流中成功地欺骗人类。一旦机器可以在两种自然语言之间流利地翻译,机器就能很好地“理解”人类语言,从而与人类进行对话。谷歌大脑的成员们正推动和协助监督翻译项目,他们相信这样的机器将会成为通用人工智能的助手。

谷歌的研究人员和工程师团队从最初的一两个人,扩大到三四人,甚至后来扩大到一百多人,他们在这一领域取得了巨大进步。接下来要讲的关于谷歌团队的故事非常少见,因为它跟我们对硅谷的通常印象有所不同。它并不是一些俗套的剧情。它不是一个关于技术能解决所有问题的故事,也不是一个技术会毁灭世界的故事。它跟颠覆无关,至少不是通常意义上的颠覆。

事实上,这个故事又包含了三个相关的故事,这三个故事在谷歌翻译成功转型为AI的过程中融合在一起,它们分别是:技术故事,制度故事和关于思想演变的故事。技术故事是关于一个公司的一个产品团队,以及他们对旧产品进行改进、测试并形成全新版本的过程,而且他们只用了别人预期的约为四分之一的时间就完成了这个过程。制度故事是关于该公司内的一个虽然规模不大但很有影响力的人工智能团队,以及他们凭借对一些旧的、未经证实的和广泛不适用的计算观念的直觉信念,超越了几乎其他所有公司的过程。思想的故事是关于坚持不懈的认知科学家、心理学家和工程师,他们长期以来用看似不合理的信念,最终激发了我们对技术和理论的理解,以及意识本身的范式转变。

第一个故事是谷歌翻译的故事,发生在山景城,时间跨度为九个月,故事解释了机器翻译发生的转变。第二个故事是谷歌大脑及其众多竞争对手的故事,发生在硅谷,时间跨度为五年,它解释了整个领域的转型。第三个故事是深度学习的故事,发生在苏格兰、瑞士、日本和加拿大等大部分地区的遥远实验室,时间跨度长达七十年,它可能非常有助于改变人类的自我认知。

这三个故事都跟人工智能有关。七十年的故事是关于我们对人工智能的期待。五年的故事是关于人工智能在不久的将来会带来什么。九个月的故事是关于人工智能现在可以做什么。这三个故事本身都是对概念的证明,而所有这一切都只是开始。

第一部分:学习机器

1 、谷歌大脑的诞生

虽然Jeff Dean的职位是高级研究员,但是事实上,他才是谷歌大脑团队的领导者。 Dean有着长而窄的脸,深深的眼睛并且十分热情。作为医学人类学家和公共卫生流行病学家的儿子,Dean成长时期几乎周游了世界各地,包括明尼苏达州、夏威夷、波士顿、阿肯色州、日内瓦、乌干达、索马里、亚特兰大等地。在高中和大学期间,他写的软件就被世界卫生组织所采用。自1999年以来,他一直在谷歌工作,当时他才25岁,从那时起,他几乎参与了谷歌所有重大项目中核心软件系统的开发。作为公司的元老级人物,Jeff Dean Facts已经成了公司开玩笑的对象。以Chuck Norris的事实模式为例:“Jeff Dean的PIN是pi的最后四位数字。”“当Alexander Graham Bell发明电话时,他接到了一个来自Jeff Dean的未接来电。”“Jeff Dean在最高级别为10的系统中晋升到了11级。“(最后一个是真的。)

上图:谷歌工程师和谷歌大脑的领导者Jeff Dean。

来源:纽约时报的Brian Finke

2011年初的一天,Dean在谷歌校园的“微型车间”之一,也就是山景城大楼的共享休息室,遇见了年轻的斯坦福计算机科学家吴恩达教授,他兼任谷歌公司的顾问。吴恩达跟Dean介绍了Marvin项目(以著名的AI先锋Marvin Minsky命名),在这个项目中,他协助谷歌建立了一种基于大脑架构的柔韧的数字网格的“神经网络”。1990年,Dean在明尼苏达大学读本科的时候,也曾经研究过该技术的原始版本,当时神经网络的概念已经开始流行。在过去的五年中,神经网络领域从事相关研究工作的学者数量开始再次增长。吴恩达告诉Dean,Marvin项目是由谷歌的秘密X实验室负责研究的,目前已经取得了一些可观的进展。

Dean对此很感兴趣,决定花自己“20%”的时间来投入这个项目,每名谷歌员工都要将自己20%的时间贡献给他或她的核心工作以外的工作。很快,Dean向吴恩达推荐了有着神经科学背景的Greg Corrado。(在研究生院的课堂上,Corrado粗略地学习了该技术,但他对此很感兴趣,他开玩笑说道:“那天我上课的时候很专心。”)在春天,他们团队又多了一名吴恩达的得意研究生Quoc Le,他是项目团队的第一个实习生。在那之后,一些谷歌工程师用“谷歌大脑”来形容Marvin项目。

术语“人工智能”是在1956年夏天在达特茅斯的一种宪法惯例中诞生的,当时大多数研究人员认为创造AI的最佳方法是写一个非常大而全面的程序,将逻辑推理的规则和有关世界的知识写入其中。比方说,如果你想把英语翻译成日语,你需要把所有的英语语法规则、牛津英语词典中包含的所有定义、所有的日语语法规则,和日语字典中的所有单词都编入计算机。这种观点通常被称为“符号化AI”。因为它的认知定义是基于符号逻辑的,但它已经有些过时,只能算作是“好的老式的AI”。

这种老式方法有两个主要问题。一是,它非常耗费人力和时间;二是,它只有在规则和定义非常清楚的领域(比如数学或象棋)才真正起作用。然而,如果翻译采用这种方法,效果会很差,因为我们平时说的话没办法跟词典上的规则和定义完全对应。比方说,这样的系统可能会把“农业部长”翻译为“农业牧师”。但是,对于数学和国际象棋来说,这种老式方法就很奏效。

不过,这种老式方法的系统确实有限。在20世纪80年代,卡内基梅隆的机器人研究员指出,让计算机做成人能做的事情很简单,但让计算机做一个1岁的小孩可以做的事情却几乎是不可能的,比如拿起一个球或识别一只猫。到了20世纪90年代,尽管计算机能够在国际象棋上战胜世界冠军,我们离真正的人工智能还差得远。

关于AI,还有另外一种看法,计算机的学习是自下而上(从数据),而不是从上到下(从规则)学习。这个概念可追溯到20世纪40年代初,研究人员发现灵活自动智能的最佳模型就是人类大脑本身。毕竟,大脑只不过是很多神经元的集合体,神经元之间可能会相互传递电荷,或者不会传递。重要的不是单个神经元本身,而是它们之间的连接方式。这种结构很简单,为大脑提供了丰富的适应性优势。大脑可以在信息量少或缺失的情况下工作;它在承受重大的损害时,也不会完全失去控制;它可以用非常有效的方式存储大量的知识;它可以区分不同的模式,但同时保留必须的混乱来处理歧义。

所以人类开始试图用电子元件来模仿这种结构,1943年研究表明,简单的人工神经元排布可以执行基本的逻辑功能。至少在理论上,神经元可以模仿人类的方式。实际上,神经元会根据试错把相互之间的突触连接调节得更强或更弱。人工神经网络也可以做类似的事情,在不断试错的基础上逐步改变人工神经元之间的数字关系。人工神经网络不需要使用固定规则来预编程,相反,它会改变自身以反映所输入的数据中的模式。

这种观点认为人工智能是进化得来,而不是创造出来的。如果你想要一个灵活而且能适应环境的机制,不能一开始就教它国际象棋。必须从非常基本的能力,如感官知觉和运动控制开始,长此以往更先进的技能才有可能出现。人类并不是通过记忆字典和语法书来学习和理解语言的,所以我们有什么理由要让计算机通过这样的方式来学习呢?

谷歌大脑是第一个对这种思维方式进行商业投资的机构。Dean、Corrado和吴恩达利用闲暇时间进行合作并对此展开研究,很快他们便取得了进展。他们从最新的理论大纲和自20世纪八九十年代以来的已有框架中提取了他们的模型的搭建灵感,他们还利用了谷歌巨大的数据储备和庞大的计算基础设施。他们利用网络上大量的“标记”数据,让计算机不断改进从而更好地匹配现实。

某天,Dean告诉我说:“动物进化出眼睛是个巨大的发展。”我们像往常一样坐在会议室,他在白板画了一个复杂的时间线,展示了谷歌大脑以及它与神经网络的历史关系。“现在,计算机也有了眼睛,我们能够借助眼睛让计算机识别图片。机器人的能力将得到巨大提升。他们将能够在一个未知的环境中,处理各种不同的问题。”这些他们正在研发的能力可能看起来很原始,但它们的影响是深远的。

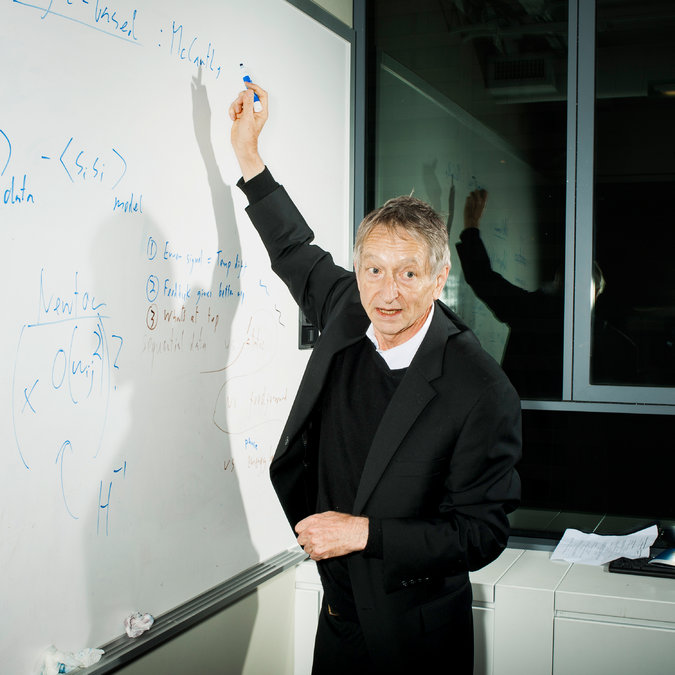

上图:Geoffrey Hinton,他在谷歌多伦多办事处提出的想法为谷歌翻译的神经网络方法奠定了基础。 图片来源:《纽约时报》的Brian Finke

2 、重量级实习生

正如Dean所说,谷歌大脑诞生一年后,就在研发具有1岁小孩智力的机器中取得了不错的成绩。谷歌的语音识别团队将其旧系统的一部分转换为神经网络,并因此取得了该系统20年来的最好成效。该系统识别对象的能力提高了一个数量级。这不是因为谷歌大脑的研究人员在短短一年内就产生了很棒的新想法,而是因为谷歌终于在该领域投入了资源和人力。

Geoffrey Hinton的到来让谷歌大脑发展更为迅猛。在谷歌大脑成立的第二年,Hinton被招聘到了谷歌大脑,而吴恩达离开了谷歌(吴恩达现在领导百度1300人的AI团队)。Hinton只能离开多伦多大学在谷歌任职三个月,因此由于奥术合同的原因,他不得不被聘为实习生。在实习培训中,辅导人员说“输入您的LDAP(目录访问协议)”,他问道:“什么是LDAP?”在场其他所有25岁的职员,尽管他们可能刚刚弄清深度学习是人工智能的必要条件,都在想“那个老家伙是谁?为什么他连LDAP是什么都不知道?”

Hinton说道:“在午餐时间,团队成员里有个人惊呼‘Hinton教授!我选修了你的课程!你居然在这里?’”从那以后,大家才不对Hinton议论纷纷。

几个月后,Hinton和他的两个学生在一个称为ImageNet的开源集合运行的大型图像识别竞赛中展示了惊人的成果,他们让计算机不仅能识别猴子,而且能够区分蜘蛛猴和吼猴,以及各种不同品种的猫。谷歌很快就向Hinton和他的学生发起了聘用书,他们接收了谷歌的聘用。Hinton说道:“我本以为谷歌对我们的知识产权感兴趣,结果没想到是对我们这几个人感兴趣。”

Hinton来自英国的传统家族,像Darwins一样,他们家族非常注重教育。他伟大的曾祖父是George Boole,他在符号逻辑方面的基础工作为计算机打下基础;Hinton的祖父是一位著名的外科医生,Hinton的父亲是一位热爱冒险的昆虫学家,Hinton的父亲的表哥是洛斯阿拉莫斯研究所的研究员,等等。而Hinton曾在剑桥和爱丁堡大学读数,然后又到卡内基梅隆大学学习,最后他又到多伦多大学。(他的工作长期以来一直受到加拿大政府的慷慨支持。)我在他的办公室对他进行了采访,他顶着一头成熟的诺埃尔加拉格尔风格的黄到褪色的头发,穿着一件宽松的条纹衬衫,椭圆形的眼镜滑落到高挺的鼻子尖端。他开口说道:“计算机会比美国人更早地理解讽刺为何物。”

19世纪60年代末,Hinton在剑桥大学读本科时,就一直致力于研究神经网络,他是该领域的先驱。但大多数时候,每当他谈及机器学习,人们都觉得他在满口胡言。人们之所以觉得神经网络荒谬,主要是因为感知机(Perceptron)被过度炒作,感知机是一个人工神经网络,是康奈尔心理学家Frank Rosenblatt于20世纪50年代后期提出的。《纽约时报》曾报道,感知机的赞助商美国海军期望它“能够走路、说话、看、写作,甚至再造自己,并意识到自己的存在”。结果证明这是不切实际的。美国的Marvin Minsky曾在1954年的普林斯顿论文中研究过神经网络,但是他对于布朗克斯科学当代的Rosenblatt对神经范式的夸张描述已经厌倦了。(他也在争取国防部的投资。)Minsky与MIT的同事一起出版了一本书,来证明有一些简单问题是感知器永远不能解决的。

Minsky对感知机的抨击只是一个“层”的网络,在后来的生活中,他阐述了与当代深度学习非常相似的想法。Hinton认为,如果使用多层神经网络,就能够完成复杂的任务。神经网络的最简单的描述是,它是一个机器,能在数据中发现模式并进行分类或预测。如果只有一层神经网络,你可以找到简单的模式,但如果有多层神经网络,你应该去找模式中的模式。在图像识别的领域,主要使用的是“卷积神经网络”。(这是在1998年的一篇开创性论文中阐述的,其主要作是Yann LeCun,他在多伦多大学读博士后,是Hinton的学生,现在是Facebook人工智能实验室的负责人。)网络的第一层负责学习识别“边缘”的基本视觉效果,也就是判断一个东西(一个像素上)是否有东西。网络的每个连续层都在前一层中寻找模式。边缘的图案可以是圆形也可以是矩形,圆形或矩形的图案可能是面部。这种方法或多或少地以越来越抽象的方式将信息组合在一起,从视网膜中的光感受器将信息返回到大脑的视觉皮层。在每个步骤中,不相关的细节会被丢弃,因为如果几个边缘和圆圈合在一起成为一张面部,你无需知道发现面部的位置,只需要知道它是一张脸。

多层“深度”神经网络的问题是试错法部分非常复杂。对于单层神经网络来说,这很容易。想象一下,如果你正在和一个孩子玩。你告诉孩子,“拿起绿色的球,把它放入盒子A中”,孩子拿起一个绿色的球,但把它放入了盒子B。你会说,“再试一次把绿色球放在盒子A中”,孩子会再次尝试把球放入了盒子A中。

现在想象你告诉孩子,“拿起一个绿色的球,穿过三号门,然后把绿色的球放入盒子A。”孩子却拿起一个红色的球,穿过了二号门,把红色的球放入盒子B。那么你该如何纠正孩子呢?你不能只是不断重复初始指示,因为孩子不知道他到底错在哪一步。在现实生活中,你可以先举起红球和绿球,说“这是红球,这是绿球”。但是,机器学习的重点是避免这种明确的指导。Hinton和其他几个人研究了解决方案(或者,对旧的方案进行了改造)。对于这个分层错误问题,在20世纪70年代末和80年代初,计算机科学家重新开始对神经网络感兴趣。Hinton说道:“人们对此非常兴奋,但我们的研究超出了他们的兴趣。”很快,计算机科学家们又跟以前一样认为Hinton这样的人是怪人和神秘主义者。

这种想法在哲学家和心理学家中仍然很受欢迎,他们称之为“连接主义”或“并行分布式处理”。Hinton告诉我说,“有几个人对这个想法保持热情,这很好,因为这是真正的人工智能。但在心理学领域,很多人相信这种想法,但却没能力实现它。”尽管加拿大政府一直大力支持,但Hinton也没能实现这个想法。“因为没有足够的计算机资源或足够的数据,我们只能自我安慰道:‘是的,如果我们有这样的前提条件,这个想法肯定是行得通的。’但这却并不是一个非常有说服力的论据。”

3、深层解读深度学习

当Pichai提到“人工智能优先(A.I. First)”概念时,他不仅仅是在说谷歌的战略计划,更是把这个长期不可行的想法扔给了公司。Pichai在资源分配上,确保了像Dean和Hinton这样的人才有足够的计算资源和数据资源可用。每个大脑大约有1000亿个神经元,每个神经元与其他10000个神经元相连,这意味着大脑内突触的数量在100万亿和1000万亿之间。对于20世纪40年代提出的简单人工神经网络来说,根本不可能实现这样规模的网络。虽然目前我们也远没达到构建这种规模网络的能力,但谷歌Brain的投资让我们至少实现了可以媲美小鼠大脑的人工神经网络。

然而,理解网络规模的重要性之前,你必须了解一些技术细节,如机器智能究竟对数据做了什么。其实,我们对人工智能的恐惧,主要来自于我们认为它像一个*社会反**天才在图书馆挖掘知识,然后,或许某一天,曾经只会玩回形针的机器会像对待蚂蚁或莴苣一样轻松杀死人类。但这并不是人工智能的工作方式,它们所做的只是搜索并寻找共同点——首先是基本模式,然后逐渐变复杂。真正最大的危险在于,我们人类最初给它灌输的信息是否就包含个人偏见。

如果只是想了解一二,可以直接阅读下一节(内容是关于猫的),如果想理解相关技术,那请继续阅读。(当然,本节内容也是关于猫。)

如果你想在老式的符号化AI模型上生成一个“猫识别器”。那么首先,你必须花大量时间预先对机器详细明确地说明什么是“猫”。告诉机器,一只猫有四条腿、尖尖的的耳朵、晶须和尾巴等。机器将这些信息存储在内存中的“Cat”区域。接下来,提供一张图片,让机器判断是否是猫。判断过程中,首先,机器必须分离出图像中不同的元素;然后,利用内存中存储的规则处理这些元素。规则如下:如果(腿 = 4)且(耳朵 = 尖)且(胡须 = 有)且(尾巴 = 有)且(表情= 高傲),那么(猫 = 是)。但如果你提供一张苏格兰折耳猫的图片呢?我们符号化 AI模型就会根据“耳朵 != 尖”判断图片上不是猫。 这样的识别水平比蹒跚学步的小孩都差。

而现在,如果用神经网络做这个实验,就根本不需要通过一系列预先定义的规则进行判别,也根本不需要专门的空间来存储“猫”的信息,包含大量相互连接着的开关的大型blob会解决这一切。在blob的一端提供输入(待识别图像),另一端提供输出(标记信息)。然后,机器将自动化工作,通过不断调试相互连接的开关,最终将输入正确映射到对应的输出。训练过程就像是在迷宫中挖掘一系列隧道,隧道两端连接的是正确的输入和输出。可用的训练数据越多,挖掘的隧道数量和复杂性就越大。训练过程一旦完成,blob中有了足够多的隧道,神经网络就能稳定处理数据并作出可靠预测。这就是“监督学习(Supervised Learning)”。

神经网络之所以需要如此多的神经元和数据,因为它以一种类似民主的方式工作。例如,你想训练可识别五种类型物体的神经网络,它由数百万“选民”(神经元)组成,每位选民都有五张不同的卡片,分别是:猫、狗、蜘蛛猴、勺子、除颤器。拿出一张图片,问:“这是猫,狗,蜘蛛猴,勺子还是除颤器?”所有神经元分组进行投票,最终得票最多的作为最终结果:“一只狗?”

你告诉它:“不!是只猫。重新计算。”

然后,神经网络退回一步,确定哪些神经元投票“猫”,哪些不是。那些投票“猫”的神经元,下次如果还投“猫”,其权重加倍。除此之外,该神经网络也必须能准确判别其他物体类别,如狗和除颤器。而神经网络之所以如此灵活,是因为每个单独的个体针对不同的输出贡献的权重不一样。其实,最关键的不是个体投票,而是这种投票模式。如果Joe, Frank 和Mary一起投票,那就是一只狗;如果Joe, Kate和Jessica一起投票,那就是一只猫;而如果Kate, Jessica 和Frank一起投票,图片上就是一个除颤器。神经网络只需要注册大量可识别信号,这些信号表示:图片中该像素区域是“猫”。“选民”越多,投票次数就越多,微弱信号也越可能被注册。简单来说,就是如果只有Joe, Frank 和Mary三个选民,你可能仅限于区分猫、狗和除颤器;而如果有数百万选民,不同选民之间有数十亿连接,那么你就可以对数据精确分类。经过训练的“选民”组合甚至可以识别未标记图片(或许不那么精确)。

计算科学领域之所以不接受这些理念,部分原因在于机器的输出仅仅是基于模式的预测,它并不完美,而且机器永远无法确切地定义什么是“猫”。只有在看到猫的时候,机器才知道那是猫。神经元“选民”通过数百万张猫图像的训练,它们可以识别出在阳光下打盹的快乐小猫,和躲在垃圾箱阴影中的生气小猫。实际上,你需要大量的神经元“选民”和足够的已标记数据,前者用来确保神经网络可以捕捉到非常微弱的信号,如苏格兰折耳猫垂下的耳朵,后者用来尽可能确保神经网络已“见过”所有相似场景。

但是,需要注意的是,神经网络的输出结果具有概率性,这意味着它并不适用于所有任务。如果神经网路把猫误认为狗,或者偶尔推送了错误的电影,这都不是大事,但如果应用于无人驾驶,神经网络1%的失误率可能就酿成了悲剧。类似担忧还有很多。监督学习是基于已标记数据进行反复试验的过程。机器完成的只是学习过程,而人为因素仍然决定了最初对训练数据的分类。例如,训练数据中,图片上是一位男士和一位女士,某人将该图片标记为“一位女士和她的老板”,这种关系标记将影响所有后续的模式识别。因此,人类错误标记才会导致训练数据错误。机器可能通过重罪定罪数据,来确定信贷候选人*款贷**资格。但如果重罪定罪数据本身就是不公平的(如数据是基于歧视性禁毒法),那么机器输出的可*款贷**人名单也是不可靠的。

图像识别网络与我们的小猫识别器一样,也是深度学习的一种,但常常把它作为教学示例,因为人类可直观了解到图像识的具体过程:先找图像边缘,然后识别圆圈,接着识别脸。这意味着其中有错误保护措施。例如,早期,谷歌发现他们的图像识别软件无法单独识别出杠铃,哪怕用大规模运动器材图像集对其训练,结果也是一样。通过可视化工具观察发现,由于训练集中所有哑铃都是附在手臂上的,所以机器没有学习到“哑铃”的概念,而是“哑铃+手臂”的整体概念。改进一下,向训练集中加入单独的“杠铃”照片,问题就解决了。但并不是所有问题都这么容易。

4、猫识别论文

谷歌Brain部门在一到两年时间内,成功让机器具备了1岁小孩的智能。随后,该部门成功从谷歌X实验室“毕业”,并成为了更高级的研究机构。(谷歌X实验室负责人曾经指出,Brain取得的成就,让整个实验室的努力没有白费。)当时,谷歌Brain仍然只有10人不到,而对于未来,也只有一个模糊的概念。但即使在那时,他们都在积极思考接下来会发生什么。就像人一样,学会认识皮球后,我们会为之满足一段时间,但迟早,人类会产生关于皮球的问题。这就是语言产生的原因。

这一领域中,Brain迈出的第一步是发表了猫识别论文,正是这篇论文,Brain闻名世界。

这篇论文展示了一个具有超过十亿个“突触”连接的神经网络。虽然与人类大脑相比,它小了好几个数量级,但它比当时任何公开的神经网络都要大好几百倍。这个神经网络可以处理原始的、未标记数据,并识别高级的人类概念。谷歌Brain的研究人员向该神经网络展示了几百万的静态帧(来自YouTube视频),然后神经网络的感觉中枢开始运转,生成了一个稳定的模型。像小孩或花栗鼠一样聪明,该模型可以迅速识别出猫的脸。研究人员并没有预先向该神经网络输入关于“猫”概念,它直接与现实世界交互并获取“猫”这一定义。(研究人员发现,这一神经网络与核磁共振(M.R.I.)很相像,猫的脸部阴影会激发人工神经元“投票”的热情。)大多数机器学习都受限于已标记数据的数据量。但这篇论文却显示,该神经网络可以处理原始未标记数据,有时甚至是人类都还没建立起概念的数据。这不仅仅是猫识别研究的重大突破,更是整个人工智能的显著进步。

猫识别论文的第一作者是Quoc Le。Le个头不高,身形偏瘦,说话温和但语速很快,经常穿着闪亮的黑皮鞋,而且面带神秘的微笑。他在越南长大,父母都是农民,小时候家里甚至都没有电。他从小就表现出了过人的数学能力,后来,他就读于一所磁铁学校学习科学。上世纪90年代末,Le还在上学,那时候他就试图构建一个聊天机器人。他在想,这有多难呢?

“但实际上,”他告诉我,“非常不简单。”

毕业后,Le离开了越南,前往澳大利亚堪培拉的一所大学学习,主要研究机器视觉这类人工智能任务。当时人工智能的主要做法是,提前给机器灌输相关概念(如,边缘),这让他感觉像是在作弊。当时的Le不知道,全世界有很多计算机科学家和他的想法一样——机器可以从零开始学习。2006年,Le任职于德国的马克斯普朗克研究所生物控制部门。在当时的一个阅读小组中,他读到了Geoffrey Hinton写的两篇论文,他觉得自己豁然开朗。

“这两篇文章引起了争议,”他告诉我。“非常大的争议。”我们在一个小型内部会议室里,天花板又窄又高,屋子里有一张小桌子和两块白板。Le看了眼他画在背后白板上的曲线,又回过头来轻声地说,“我从没见到过这么大的争议”。

他记得,当时在阅读小组里站起来,然后说,“这就是未来。”但在当时,这是个不受欢迎的决定。Le在澳大利亚的导师不能完全理解他的想法,写邮件问到,“你为什么决定做这个?”

“那时,我想不到怎么回答这个问题,”Le说。“因为,我只是好奇。文章中提出了一个成功的范式,老实说,我只是对这个新范式感到好奇。那时还是2006年,这样的观点非常罕见。”然后,Le 加入了斯坦福的吴恩达团队,接着他开始沿着 Hinton 的道路探索。“到了2010年年底,我确信会有事情发生。”

不久之后,Le成为了Brain的首位实习生。在Brain,他继续着自己的论文工作,也就是后来发表的猫论文的前身。在一个简单层面上,Le只是想看看计算机能否被训练并自主识别给定图像中的绝对必要的信息。他向神经网络输入了一张YouTube上的静态图片。然后,指示神经网络丢弃一些信息,但并不说明哪些信息应该保留哪些应该丢弃。神经网络随机丢弃了一些信息。接着,Le又说:“刚刚是开玩笑的。现在基于你刚刚保留下来的信息,重新构建初始图像。”这种方式就像他先要求机器找到一种方式“总结”图像,然后,基于总结的信息回溯原始图像。如果总结的都是些不相关信息(如天空的颜色),而不是关键信息(如有没有胡须),计算机就无法有效重构原始图像。计算机的反应就像我们远古的祖先,他们在逃跑中建立起对剑齿虎的印象。而Le的神经网络与我们的祖先的方式不同,它需要不断地尝试。从数学角度来说,每次尝试后,它都选择不同的信息进行优化,而且表现地越来越好。然而,神经网络是个黑盒子,它确实生成了某种范式,但人类并不能直观地理解这些范式。

猫论文发表后,引起了极大凡响,而Le并未感觉到自己掌握了业界的话语权。但他强烈感觉到,应该继续自己早年聊天机器人的想法。发表了猫论文后,Le意识到,如果神经网络可以总结图片信息,那么它或许也可以总结语句信息。在接下来两年中,这一想法深深印在Le和Tomas Mikolov(Le在Brain的同事)的脑海中。

那段时间,Brain团队占据了好几个办公室,甚至一度占用了高管的地方。随后,他们收到了管理处的邮件,要求他们不要在Larry Page和Sergey Brin的 办公室门口的沙发上睡觉。后来,他们被安排到街对面的研究楼里工作,在那里,研究人员专心研究,而不必应付同事间礼貌而无效率的交谈。当然在这一过渡期,谷歌的竞争对手们也在奋力前行。(Le神情严肃地一遍一遍提及他与Tomas Mikolov的亲密合作。最后我忍不住问道,“他离开了?”Le点点头,回答道:“去了Facebook”。)

上图:2012年的谷歌 Brain团队。他们发表了著名的“猫论文”,演示论文中的神经网络处理未标记数据。研究人员向该神经网络提供几百万的静态帧(来自YouTube视频),神经网络生成了一个稳定的模型并且识别出猫。

那段时间,他们极力想构造出不仅能执行简单的静态图片分类任务,也能处理复杂的任务(如自然语言或音乐)的神经网络架构。他们的许多观点在上世纪九十年代就出现了,Le和他的同事们专门回顾了那些被忽略的概念,希望能从中得到启发。他们知道,一旦建立了一个具有基本语言预测功能的模型,也就可以基于此完成各种其他类型智能任务,如预测电子邮件的合适回复或者预测谈话过程。你可以侧重于那些从表面看起来很像思维过程的任务。

第二部分:语言机器

5、 语言的十字路口

Brain部门现在约有100位成员,他们感觉自己不像是在一个层次分明的大公司的部门里,而像是在俱乐部、学术社区或者小酒吧。这些年来,Brain被视为谷歌最自由的、员工最受推崇的部门。该部门地处公司园区西北边缘的一个两层的蛋壳结构的炭灰色建筑中。他们的小厨房中有从未使用过的桌上足球机和摇滚乐队设施,以及偶尔使用的Go工具箱。(但我曾经看到一位年轻的助理向他的同事介绍如何像瓜分火鸡一样瓜分菠萝蜜。)

6月份,我在Brain的办公室看到了一些空着的桌子,但大多数都贴上了便利贴,写着诸如“Jesse,6/27”等,但现在所有位置都满了。我第一次去Brain的时候,停车根本不是问题。虽然最近的停车位预留给了孕妇或者特斯拉汽车,但仍有足够的停车位剩下。但到10月份,如果我晚于9:30上班,就不得不去马路对面找停车位了。

Brain的快速发展让Dean有点担心公司是否可以满足这些需求。他想避免“成功灾难”,即公司的理论能力超过了实际执行任务的能力。有一天,他做了些简单计算,并用两页PPT向高管们展示了自己的想法。

“如果将来每个人每天对自己手机说三分钟话,那我们得需要多少机器啊!”他说,他们需要将其全球计算空间翻倍或三倍。Dean表情夸张地说:“那个,听起来很可怕,但我们不得不这么做。”然后思考了一会儿,补充道:“我们需要建立新的架构。”

但是,还有另一个选择:设计并批量生产一种新型芯片,将它们安装在分布式的数据中心,从而加快运算速度。这种新型芯片就是T.P.U.(Tensor Processing Units),而且,它们反而比普通的芯片精度低。他们给出的不是12.246乘54.392,而是近似12乘54。从数学角度上来说,神经网络就是成百上千上亿的结构化矩阵连续相乘,所以速度比精度更重要。Dean说:“一般情况下,专用硬件不是个好主意,因为它仅能用于单一任务的加速。但由于神经网络的通用性,你可以用专用硬件来加速很多任务。”

就在芯片设计阶段即将完成时,Le和他的两个同事终于证明了神经网络可以解决语言结构问题。Le提出了“词嵌入(word embeddings)”的想法,围绕这一想法,他研究了10年以上。当你“总结”图片时,你知道每个阶段总结的信息,如边缘、圆圈等。当以类似方式“总结”语言时,实际上,你是基于常用语法,在单词间建立多维距离映射图。我们“分析”数据时,会利用语言规则将词分为名词、动词等,但机器不是这样的。实际上,机器会将单词平移、旋转、变换后放入多维距离地图。

二维关系中,距离地图可能没什么用。比如,你既想“猫”放在“狗”附近,又想把“猫”放在“尾巴”、“高傲”和“喵喵”等附近,因为你想搜集“猫”和所有与它有关的单词之间的关系。而只有这些词在不同维度上与“猫”相关,我们才能同时将它们关联在一起。你可能无法轻易构建160000维距离地图,但1000维左右就可以很好地表示一种语言了。换句话说,语言中每个单词都可以由一千个数字排列表示。我实在很难想象出这么多维的距离地图。Le说,“我一般不太喜欢在三维空中,可视化出一千维向量。”

而且,空间中的特定维度信息可以表示人类的类别,比如性别或身材。如果你把代表“国王”的千位数字值减去代表“皇后”的千位数字值,其结果应该和表示“女性”的数值减去表示“男性”的数值一样。如果你掌握了整个英语空间和整个法语空间,理论上,你可以训练一个神经网络,其输入的是一个空间的语句,输出的是另一个空间中对应的语句。具体做法上,只需要给它提供数百万句的英语作为输入,把对应的的法语语句作为输出,这样随着一段时间的学习,神经网络将找到单词间特定的模式,就如同图像分类器找到像素间的模式一样。最后,你可以输入一句英语,要求该神经网络预测出最匹配的法语。

然而,像素和单词之间最大的区别在于,图像中所有像素是一起出现的,而单词是按说话的时间顺序出现的。这就需要网络以某种方式按时间顺序“记住”所有单词,从第一个到最后一个。2014年9月份,大约一个星期内,就出现了三篇论文(Le和两个来自加拿大和德国的学者发表的),都为这一问题提供了必要的理论工具。该研究为开放式项目(如Brain的Magenta)说明了机器如何打造艺术和音乐;它也为工具式应用(如机器翻译)指明了方向。Hinton告诉我,那时他认为这项研究的后续工作可能至少还需要持续五年的时间。

6、伏击

Le的论文表明,神经转换是合理的,但他只使用了一个相对较小的公共数据集。(对谷歌而言,这数据集是很小的,而谷歌是这个世界上最大的公共数据集。旧版的Translate在过去十年已经收集了生产100倍到1000倍的生产数据。)更重要的是,Le的模型不能很好地翻译超过约七字的句子。

当时Brain的研究科学家Mike Schuster当上了项目总负责人。他知道,就算谷歌没有找到一种方法把这些理论提高到生产力水平,总有一些人会找到。这个项目占用了他接下来的两年。“你想,”Schuster说:“为了翻译,你只得到了一堆数据,运行一些实验,当你 完成了,却发现它没有达到预期的效果。”

Schuster是一个紧张又注意力集中、充满活力的人,他的头部黝黑像活塞,窄肩,穿着长迷彩短裤和霓虹绿耐克鞋。他看起来就像从莲花座姿势中醒来一样,伸手去找他的椭圆无框小眼镜,就像保存完好的橡果温和的部分那样去吸收卡路里,去办公室的路上就像完成了一次沙漠十项全能。在现实中,他告诉我,这只是在另一条路上骑行18英里而已。Schuster在前西德的高炉区杜伊斯堡成长并学习电子工程,后来移居东京开展早期神经网络的研究工作。在上世纪 90年代,他用会议室一样大神经网络机器进行实验;这台机器花费了上百万美元,并且训练了数周去做一些你现在可以用笔记本电脑轻松完成的事情。他在1997年发表了一篇论文,几乎被引用了15年之久;今年这篇论文已经被引用了大约150次。他不缺乏幽默感,但他经常用一些粗鲁的词语,我把这看作是他对结合德国严谨和日本细致的特点。

Schuster不得不面对的问题是纠结的。一方面,Le的代码自己编写的,并不兼容谷歌当时新开发的机器学习开源平台TensorFlow。Dean在2015年的秋天给Schuster派遣了两个工程师,Yonghui Wu和Zhifeng Chen。他们花了两个月的时间才在新系统上复制Le的结果。Le当时就在旁边,但即使是他也无法总是明白他们所做的事情。

正如Schuster所说,“有些东西是不能完全被意识到的。他们也不知道真正的原理。”

今年二月,谷歌的研究机构—这是一个有一千名致力于前瞻性研究的松散组织的公司—在联合广场威斯汀圣弗朗西斯会场召集了他们的领导。那是一个略低档于谷歌自家酒店的往东一英里左右的豪华酒店。整个早上就是被他们的“闪电讲坛”预定了,主要是快速介绍一遍目前研究的前沿。而下午则为跨部门的“合作讨论”预留着。这个会议期望能为了保持公司的产出而提供的一次不可预知、透明、贝尔实验室似的交流。

在午餐时间,Corrado和Dean联合起来找到谷歌翻译的负责人Macduff Hughes。Hughes正独自一人吃饭,而两位Brain的成员则坐在了他的两边.。正如Corrado所说,“我们伏击了他。”

“好吧,”Corrado对警惕的Hughes说,“我们有话要告诉你。”

他们告诉休斯,2016是考虑谷歌翻译用神经网络改革的一个好时机.—数百名工程师累积超过了10年的代码。旧版系统的工作原理和其他机器翻译的原理一样,超过了30年历史:它首先将连续句子断开,在一个经过统计学整理的词典中查找词义,然后经过一系列的后处理规则,附加上正确的结尾词并重排词语使句子有意义。该方法被称为“基于短语的统计机器翻译,”因为当系统进入下一个词语后,它便忘记上一个词语的意思是什么了.。这就是为什么机器翻译的输出句子有时候读起来不通畅。如果能成功更换为神经网络的翻译,它将把阅读和造句放在一个整体的流程里。它将关注可能对翻译有帮助的上下文。

风险看起来似乎很低:谷歌翻译的盈利是最低的,而且它可能一直会是这样。对于大多数以英语为母语的用户,一次激进的服务升级不会被认为是超过预期的体验改进。但现实表明,达到人类质量的机器翻译不仅在短期内有必要性,从长远来看,还是一个转型的证明。在不久的将来,这对公司的经营战略至关重要.。谷歌估计50%网页是英文的,世界上20%的人口讲英语。如果谷歌要在中国竞争—其中大部分搜索引擎流量属于其竞争对手百度—或印度,优秀的机器翻译将是基础设施不可或缺的一部分。百度曾在2015年7月发表了开创性的研究论文,证明神经机器翻译的可能性。

而在更遥远的未来,机器翻译也许是带有人类语言功能的通用计算工具的第一步。这将是一个重大的转折点,也许是主要的转折点—正在发展的研究,感觉更像真正的人工智能。

硅谷的大多数人都知道机器学习是一个快速上升的潮流,所以Hughes已经看到了这一伏击的来临。他仍然持怀疑态度。他是一个温和而强壮的中年男人,顶着乱糟糟的褐色头发,他的两鬓斑白。Hughes是一个典型的线路工程师,而且是那种70年代波音里不愿离开绘图桌的工程师。他的牛仔裤口袋里常常装着大块奇怪的工具,就像是在安装热电偶。他不像许多为他工作的年轻人,他有一个无需依靠公司零件的工具箱。他知道,在谷歌和其他地方有各种各样的人一直尝试地使神经网络能为翻译工作—不是在实验室,而是在工业界—然而多年来,收效甚微。

Hughes听了他们的情况后,他谨慎地说,听起来在三年内也许他们可以做到。

Dean则另有想法。“我们能在今年年底前做到,如果我们全心全意投入。”人们最喜欢和崇拜Dean的一个原因是,他很长一段时间把他的心思放在机器学习上。另一个原因是,他会毫不尴尬地说“我们会全心投入”。

Hughes确信这种改变不会在近期发生,他个人并不在意.。“让我们为2016做准备吧,”他回去告诉他的团队。“我不会说Jeff Dean不能快速做到这一点。”

一个月后,他们终于能够运行一个对比实验,Schuster的新系统和Hughes的旧系统。Schuster想用英语转法语来测试,但是Hughes建议他用别的方案。“英语转法语已经足够好了,效果不会很明显,”他说。

这是一个Schuster无法抗拒的挑战。用来评价机器翻译的基准指标叫BLEU得分,它对比机器翻译了和许多可靠的人工翻译。当时,英语转法语最好的BLEU得分是20。只要有一点的改进就会被认为是非常好的;有两个点的改进则是非常出色了。

而神经系统在英语转法语上比旧系统改进了七个点。

Hughes告诉Schuster的团队,他们在过去四年内,也无法做到他们一半的改进。

可以肯定的是,这不是幸运的结果,他们还找到了客户做一次比较。用户体验得分包括了对样本句子进行从0到6的打分,而新系统平均得到了0.4分的改进——大致相当于旧系统在其整个生命周期中的总改进。

上图:谷歌的Quoc Le(右),他与Mike Schuster的工作证明了神经网络翻译的合理性。Schuster曾在谷歌翻译工作过。来源:来自《纽约时报》的Brian Finke

在三月中旬,Hughes给他的团队发了一封邮件。旧系统的所有项目将会被暂时中止。

7、理论发展为产品

神经网络翻译的团队一开始只有三名成员—Schuster, Wu和Chen,在Hughes的支持下团队规模开始逐渐增大。出于成员Schuster的提议,他们每周三下午两点钟都会在Quartz湖Brian建筑的角落房间里开会。这个会议一般有十几人参加,每当Hughes 或是Corrado出席会议时,他们通常会成为会议中唯一的以英语为母语的人。会议中的工程师说汉语,越南语,波兰语,俄语,阿拉伯语,德语和日语,但是他们大多会用自认为高效的蹩脚英文和数学公式来表达自身想法。在Google,人们很多时候并不清楚究竟是谁在主持会议,但有Schuster出席的情况下是个例外。

他们需要做的事情也并没有完全弄清楚。“这个故事充满了不确定性——可以说不确定性贯穿了整个过程”Schuster给我如此描述 “软件,数据,硬件,人。这就像……”他伸出他细长的手臂,从他狭窄的肩膀开始轻轻弯曲肘部。“就像在一个巨大的泥海中游泳,你只能看到这么远。”说着,他把手放在胸前八英寸。“存在一个目标,或许它就在那里。”

谷歌大多数的会议室都配有视频聊天显示器,当显示器闲置的时候,屏幕会显示出高清且颜色鲜艳的公开的Google+的照片,例如森林幻景、北极光或是国会大厦。Schuster用手指向的一个屏幕显示的是夜晚的华盛顿纪念碑。

“到目前为止,从外面看来,每个人都有双筒望远镜,可以看到前方”。

为了实现这一点所做的理论工作就已经让人精疲力竭了,而试图把它变成一个可以实际使用的产品在学术科学家看来这个“纯粹”的工程部分并不是那么容易。一方面,他们需要确保训练是在优质的数据集上进行的。谷歌拥有数十亿字的训练集,用这个训练集去训练机器“阅读”,该训练集主要是由中等复杂的句子组成的,有点类似于人们在Hemingway中看到的句子。而有些项目的训练集则会来源于公共领域,例如最初的Rosetta Stone,曾“阅读”上百万页的加拿大议会的记录。然而,它有很多数据都是从10年前收集的数据中挑选出来的,有一些数据通过受访者采集到的。该团队的数据库里大概有9700万个独特的“单词”,但是如果把表情符号、拼写错误都去掉后,只剩下160000个左右的有效词汇。

这个时候需要我们重新审视用户真正想翻译的内容,这通常和我们是否正确的使用语法无关。谷歌发现很多人并不会机器去翻译一个完整复杂的句子,他们常常输入一些奇怪的语言片段。如果你希望网络能够处理用户的输入流,就得确保它能定向到期望的方向上。需要注意的是,网络对训练它的数据十分敏感。Hughes给我这样解释过:“神经网络翻译系统正在学习一切它能学习到的东西,就像一个蹒跚学步的小孩。‘哦,爸爸在他生气的时候会这样说’”Hughes笑道:“因此你必须小心训练它。”

但最重要的是,他们需要确保整个翻译的过程是快速而高效的,在用户看来应该是同时的。二月份的时候,他们需要花费10秒钟的时间去翻译一个由10个单词组成的句子。他们不能采用任何造成缓慢的东西,翻译小组开始对一小部分用户开展了延迟实验,以伪造延迟的形式来识别容错。他们发现,网络花费了两倍倍甚至五倍时间去翻译那些没有被注册过的句子。整个试验中不需要考虑因为语言不同的问题,即使是法语和中文这样相同情况下词汇较多的语言,翻译起来速度也没有降低。针对于一些更加模糊不清的语义,谷歌团队很清楚,如果用户能够得到更高质量的译文,他们不会因为轻微的延迟的放弃使用。他们只是为了防止用户放弃谷歌的服务转而使用竞争对手的翻译服务。

Schuster承认他并不确定团队能否把翻译做的足够快。记得在微型车间谈话时他曾对Chen说:“一定存在某些可以使它更快的东西,但我现在还不知道那是什么。”

他也明白,他们需要更多的处理器—即GPUs。为了训练,他们需要用图形处理器去重新配置神经网络。

Hughes问Schuster:“我们是否应该多要1000台处理器?”

Schuster问:“为什么不是是2000台?“

十天后,他们就拥有了新增的2000台处理器。

到四月份,团队已经由原来的三人阵容增加到了三十多人,而他们中的一些人,在Brain方面如Le,和许多翻译领域的人。五月的时候,Hughes为每一对原文——译文安排了一个人负责,所有人的结果检查都做成一个电子表格用于共享和性能评估。在任何给定的时间内,至少有20个人正在进行为期一周的独立实验,实验期间人们将处理任何的突发性问题。曾经有一个模型把所有输入句子中的数字全部去除了,但没有人可以解释这种情况。反反复复,“人们几乎都被逼疯了。”舒斯特说。

等到春天快要结束的时候,各种成果摆在面前。团队在结构中引入“词块模型”、“覆盖率惩罚”、“长度正常化”等模块,每个模块对翻译结果进行了提高,尽管可能只是提高了几个百分点,但对总体而言它们的影响还是很显著的。而一旦模型被标准化后,它就不再是当前人们翻译所使用的150种不同的模型,而是一个的单一的多语言模型,它将随着时间的推移而改进。这里其实存在这样一个悖论:一个工具如果想要要进一步推广,需要一位没有迷失在这个工具中的人类去帮助模型构建学习机、完成自动化过程。而人们的很多做法其实都是出于直觉。例如:每层使用多少个神经元?1024个还是512个?一共有多少层?一次输入几条语句?需要耗费多少时间训练?

“我们做了数百次的实验,”Schuster告诉我,“直到自己意识到可以停止训练的一个星期后才停止了实验。总问:我什么时候停下来?我怎样可以知道自己已经完成?事实上,你永远不会知道什么时候你做完了。机器学习机制从来就不是完美的。在某些时候你需要训练,在某些时候你必须停止。这就是令人痛苦的根源。而对一些人而言这是极其困难的。有点类似于艺术,究竟在哪里添加一笔会让你的整个画作看起来更加漂亮,只有你真正画上去之后才会知道,而有些人的那一笔会让画作变得漂亮,有些人只会让画作变得更丑。”

五月份,Brain团队意识到能使系统可以快速实现成为产品的唯一办法:是在TPUs上运行Dean所要求的专用芯片。Chen说:“我们不知道代码能否正常工作,但是我们可以确定的一点是没有TPUs,代码是肯定不会工作的。”他回忆和Dean面对面恳求的场景“请让我们保留一些东西。”Dean把他们的成果保留了下来,但是TPUs并不能正常工作,Wu花了两个月的时间坐在硬件团队的旁边试图找出原因。他们不只是调试模型,还调试芯片。神经翻译项目将是整个基础设施投资得到POC。

六月的一个星期三,Quzatz湖会议开始讨论最近出现在学科首席在线论坛杂上百度的一篇论文。Schuster维持了下房间的秩序:“是,百度发表出的这篇论文。感觉就像有人在盯着我们后背一样—相似的架构,相似的结果。”公司的BLEU分数基本上是Google在二月和三月份的内部测试中的取得的成绩。Le的眉头并没有皱起,他似乎得到了这样的结论:这个迹象表明Google确实在正确的轨道上,“这和我们的系统非常相似。”他十分平静。

Google团队知道,他们完全可以更早地公布出他们的研究结果,或许能击退他们的竞争对手,但正如Schuster所说的那样:“实现比出版更重要。人们会说‘我是做这个事情的第一人’但是到最后,又有谁会在乎这个呢?”

然而,这要求他们需要把自己的服务弄得更好。Hughes有一个幻想,他们甚至不会通知他们的用户何时会启用这项服务。他们将静静等待并观察社会媒体是否能察觉到这些巨大的改进。

“我们还不想告诉群众这是一个新的系统,”他告诉我将会在劳动节之后的第二天的5点36分,在没有告诉任何人的情况下,向百分之十的用户发布了汉译英的服务。“我们希望它确实起到作用,理想状态是,它在Twitter上引发言论爆炸“你见识到谷歌翻译有多棒了吗?”

8、庆祝

在四季如春的硅谷,有两种最可靠的方式来辨别时令,一个是根据出现在微型厨房中的时令水果,从盛夏的普吕奥到亚洲梨,再到早秋的富裕柿子,无不于是着四季的更替。还有一种方法,就是根据技术进步的曲折过程,来判断硅谷时令。在9月末的一个不是很舒适的星期一,团队的论文终于被发表了。搞笑的是,论文*共中**提名了31位作者。在接下来的一天中,Brain和谷歌翻译的成员聚集在一起,在谷歌翻译的微型厨房中开了庆祝酒会。Brain的建筑,也许是为了纪念团队共同度过的漫长冬天,均以阿拉斯加当地的地名命名。而谷歌翻译建筑主题则是夏威夷。

夏威夷风格的微型厨房中有一侧墙贴满了金灿灿的沙滩照片,在厨房的中部,有一个服务柜台,柜台上挂着一个由茅草编制而成的小型花环,花环中站着一只毛绒鹦鹉,天花板的灯具装修得像纸灯笼一样活泼。在厨房两侧放置着一排竹竿,它们就像防守不严的热带城堡士兵那样稀稀拉拉地站着。在竹竿后边,从玻璃墙和打开的门看去,可以看到两侧整齐放置着一排排灰色书桌,这是人们日常办公的地方。这个早晨,谷歌翻译的10年纪念帽衫到了,很多团队成员都穿着他们崭新的队服来参加酒会。他们也是在庆祝他们十年的协同工作,也在这一天,画上了终止符。从另一个方面来说,这些人关系的结束,如同丧亲一般,而新的帽衫,也就变成了与亲人最后告别时的丧服,但是双方团队的工程师们和计算机科学家们似乎并没有那么悲伤。

最终,谷歌基于神经网络的翻译软件正式上线了。到酒会开始为止,公司的中译英软件测试已经成功处理了1800万个查询请求了。谷歌翻译团队的一个工程师企图使用百度翻译来进行中译英的句子翻译,他拿着手机到处跑,向经过的所有人欢呼。“如果你一次输入两个以上的字符,百度翻译就崩溃啦!”(百度声称用户从没有反映过这个问题。)

在接下来的几周内,谷歌将神经网络嵌入到中译英翻译的事情被广为传播,一些人怀疑,谷歌翻译只能在中译英上取得良好效果。酒会上的每个人都知道他们真实的成果将会在11月份公之于众。然而,到那时,他们中的很多人已经参与到其他项目的研发中了。

Hughes清了清嗓子,登上tiki吧台。他穿着一件褪色的绿色网球衫,衣领已经皱皱巴巴的了,腹部位置也有汗渍留下的轻微的黑色条带痕迹。我们经历过最后关头的错误,甚至是最后最后关头的错误,包括发表的文章中一个很大的测量误差错误,以及系统中一个奇怪的标点符号相关错误。但是现在所有问题都解决了-至少是暂时解决了。宾客们安静下来。Hughes主持的会议都是很高产高效的,他不允许任何的重复讲话或切切私语,但他在这个沉重的时刻也停顿了。他承认,也许,他是在夸张这个隐喻,但是对于他来说,强调这个事实更加重要的。他说,神经网络翻译项目的成功预示着“不同语种之间的合作”。

他们的神经网络翻译项目的成功,他继续说,代表了“一个阶跃函数”— 也就是说,一个不连续的发展,一个垂直的飞跃还不是缓慢逐步的发展。翻译不仅是这两个团队的成果,也是从理论到现实的结晶。他举起了一个看起来很高端的塑料气泡香槟。

“敬交流,”他说,“也敬合作!”

工程师们看着彼此,绅士地为彼此欢呼,为彼此鼓掌。

Jeff Dean站在微型厨房的中间,双手插在兜中,肩稍稍向内收。他的两侧站着Corrado和Schuster。Dean以低调的方式观察着这个酒会的气氛,并轻快简洁地补充道:

你们所表现出的,是你们可以在同一时间做两件大事:“做研究,并把研究成果带到,我不太确定,带到5亿人面前。”

每个人都笑了,并不是因为他说得夸张,而是因为这就是事实。

后记:机器不是鬼魂

也许人工智能受到的最有名得评判,或者说是针对人工智能做出的评论,暗示着翻译的问题。Berkeley哲学家John Searle于1980年提出了《中国式房间》的论点。在Searle的思想实验中,一位英语单语者独自一人呆在一个监狱隔间中。一个狱卒通过门上的小槽扔给他一张标有中文字符的纸条。同时,实验还给囚犯用英文提供了一系列用于回复的表格和规则。他对于这些规则十分熟悉,很快得出了“与说汉语的人毫无区别”的回答。我们可以说这个不幸的囚犯“看懂”中文了吗? Searle认为答案肯定是“不可以”。这个对计算机的隐喻,Searle后来写道,打破了“经适当编程后的数字计算机必须拥有一颗与人类思考方式相同的头脑,才可以得到正确的输入输出”的言论。

对于谷歌Brain团队来说,即使对于那些在硅谷做机器学习的人来说,这也是一个完全不切实际的观点。这并不是说他们会完全忽视这个哲学问题。而是说他们对人类思想有着完全不同的理解。与Searle不同,他们不认为“意识”是某种特殊的,与灵魂有关的心理属性-哲学家Gilbert Ryle称之为“机器中的幽灵”。他们只是认为,我们称之为“意识”的这种复杂的技能混合,是从许多不同简单机制的协调活动中随机产生的。其含义是,拥有较高级寄存器的设备与拥有较低级寄存器的设备是没有什么差别的。从这个解释来看,逻辑推理可以看成是一种幸运的适应。投球和接球的能力也是这样。人工智能并不是关于建立思想的科学;它是关于解决问题的工具改进的科学。正如我第一天到谷歌时,Corrado对我说的那样,“人工智能研究的不是关于机器“知道”或“理解”什么,更重要的是,要研究机器做了什么,更重要的是,研究它还没有做到什么。”

当你意识到“做”比“知道”的重要性更高时,机器才会带来更多的社会和文化效益。在酒会上,Schuster走到我面前,向我表达了他对报纸媒体的失望。“你看到第一篇新闻报道了吗?”他问我。那天早上,他改述了整个新闻标题,逐词进行背诵:谷歌声称,人工智能翻译可以完全与人类翻译媲美。在撰写论文的最后几周,团队曾对此进行过讨论;Schuster一直强调论文中要传达的信息应该是“人工智能翻译确实比之前的翻译软件要好,但还是比不过人类翻译。”他希望明确一点,他们的努力是为了帮助人类,还不是替代人类。

尽管人工智能的兴起确实占据了人类工作岗位的一部分,我们很难再找到一个人工智能无法参与的工作领域。如果你和Searle一样相信,人类的确有独特之处—“思想”,那么你就可以在人类和智能机器之间画一条明确的分界线。如果你反对Searle的观点,那么你就会将人类和人工智能混淆。这也就可以理解为什么这么多人都同意Searle的观点。在2015年麻省理工学院召开的探讨人工智能本质的大会中,Noam Chomsky被问到他对人工智能的看法。他嘲笑地说整个人工智能领域仅可以做统计预测,就像一个高级的天气预报员。即使人工智能翻译已经达到了完美的水平,它也不会反映出任何深层次的语言本质内容。它永远不会给你解释语法,如代词做与格或做宾格。这种预测工具可以作为辅助我们实现目标,但是对于进一步了解事情发生的原因,它并不算成功。一个机器能够比放射科医生更精准地用医学扫描仪找到肿瘤,但是它不能告诉你导致肿瘤的原因。

那么,放射科医生可以吗?

医疗诊断领域也许是最直接,而且是始料未及地被机器学习所威胁。放射科医生经过了广泛地培训,并被高薪聘请,我们认为他们的技能需要很专业的知识支撑-可以比喻成较高级的思想寄存器。仅在过去的一年中,研究员们不仅证明了神经网络可以先放射科医生一步,通过医学图像发现肿瘤,而且证明了机器可以从病理报告的文字叙述中做出诊断。而相比于逻辑分析来说,放射科医生做的更接近于模式匹配预测。他们不会告诉你什么导致了癌症;他们只会告诉你患了癌症。

一旦你建立好了一个强大的模式匹配装置,通过调整,它也可以被用于其他服务。一位谷歌翻译的工程师用同一格神经网络既做了艺术品鉴定,又做了自动无线电控制汽车。一个用来做小猫识别的网络可以被训练成CT扫描网络-当然还可以应用到更多地医疗领域,,即使是最好的医生也不可能做到这么多。用来做翻译的神经网络可以用来做数百万页的法律鉴定,使用时间只占最昂贵的资深律师所用时间的一小部分。这些用人工智能所做的工作不再仅限于重复的任务,这些任务曾经被不公平地强调为是与未受过教育阶层相关的低智能的任务。我们不仅是指3.5百万的卡车司机将很可能失去工作。更重要地,我们在说仓储经理,经济学家,金融顾问,房地产经纪人等都有可能丢掉饭碗。Brain在这过去地9个月中,仅仅用一个例子证明了在大公司中的一个小团队可以很快地完成一个没有人会将其与机器联系起来的任务。

此时,硅谷中发生一件很重要的事不是关于破坏。而是机构的建设,以及权利的巩固,其规模和速度都是史无前例,闻所未闻的。Brain团队中有实习生;有正式员工;有为其他部门训练员工的“忍者”。 办公室到处都摆放着免费的自行车头盔,并为一年仅有的两场雨准备了免费雨伞,还有小的水果沙拉盘,午休,共享的跑步机,按摩椅,随机口味的高端糕点食盒,婴儿衣物捐赠处,同时还有两层的攀岩墙,并配有专业导师,公司还有专门的阅读组织,公司政策交流团,以及各色的支持网络。这些对员工培养有益的重金投资,远不止是对那些手持4大州,13个数据中心(聚集足够的电力支持大城市发电)的服务器的协调能力的数字盐矿员工的津贴。

但是即使是像谷歌这样的大型企业也会受到自动化浪潮的冲击;机器一旦学会了人类语言,即使是看似安全度最高的编程工作也会受到冲击。在tiki酒吧举办的酒会结束之后,一个谷歌翻译的工程师带来了他的笔记本电脑,想给Hughes看点东西。屏幕上显示着一个由旋转和脉冲组合而成的生动又变化万千的动画,动画中,一个球在循环轨道中运动,它会在星云再次扩散之前撞击星云。

Hughes立刻就意识到了它是什么,而我还要进一步观察,才看到了很多名字,有人名,还有文件名。这是一个记录谷歌翻译代码库10年发展历程的动画,星云的每一次扩散和绽放都来源于团队中每个成员的努力。Hughes缓慢地浏览,从2006年到2008年,再到2015年,每隔一段时间就停下来一次,回忆一些遥远的“战役”,无论是胜利或失败,他们都挺了过来,走到了今天。Hughes说Jeff Dean的名字出现的次数最多。

Hughes叫来Corrado,然后他们就站在那里发呆。为了打破这种抑郁怀旧气氛,Corrado,看上去有些受伤,抬起头来说,“那么我们何时将这个删除呢?”

“不要担心,”Hughes说。“新的代码库将会再次扩大。一些都在改变。而动画也会永远扩充下去。”