本文重点

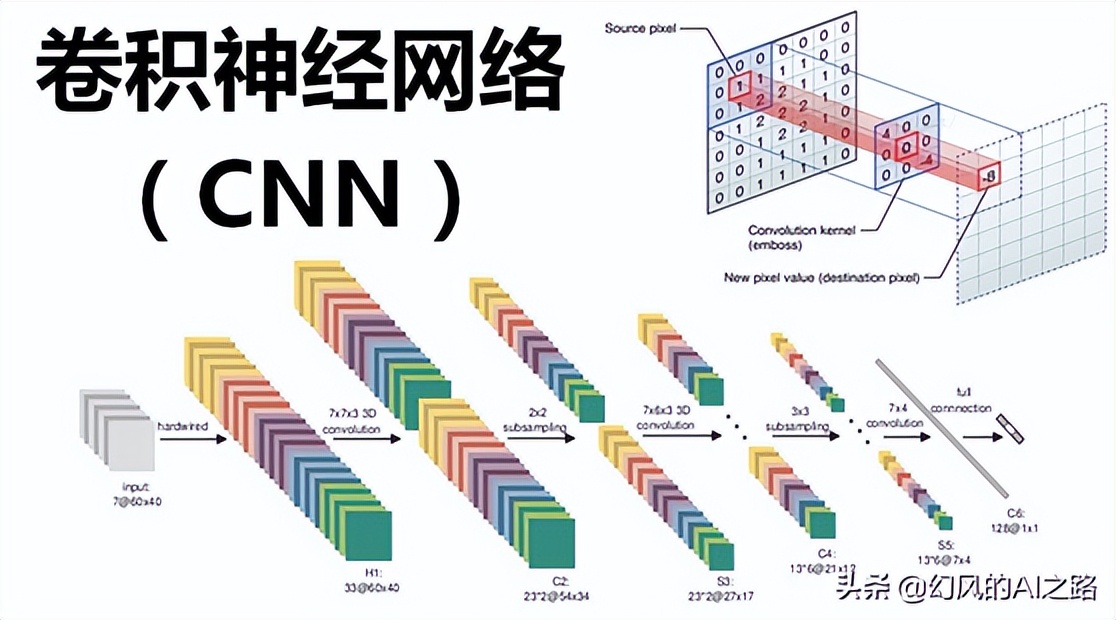

卷积神经网络(Convolutional Neural Network, CNN)是一种深度学习模型,广泛应用于图像、语音、自然语言处理等领域。其中,对于图像处理任务,CNN是目前最为常用的模型之一。本文将介绍如何使用CNN对彩*图色**片进行卷积。

彩*图色**片的表示方法

在介绍卷积神经网络对彩*图色**片进行卷积之前,我们先来了解一下彩*图色**片的表示方法。彩*图色**片通常使用RGB(Red、Green、Blue)三个颜色通道来表示。每个通道都是一个二维矩阵,表示红、绿、蓝三种颜色在图像中的分布情况。在Python中,我们可以使用PIL库来加载和处理彩*图色**片。下面是一个简单的代码示例:

```python

from PIL import Image

# 加载图片

img = Image.open('example.jpg')

# 将图片转为RGB模式

img = img.convert('RGB')

# 获取图片的宽度和高度

width, height = img.size

# 获取红、绿、蓝三个通道的像素值

r, g, b = img.split()

# 将像素值转为二维矩阵

r_data = list(r.getdata())

r_matrix = [r_data[i:i+width] for i in range(0, len(r_data), width)]

g_data = list(g.getdata())

g_matrix = [g_data[i:i+width] for i in range(0, len(g_data), width)]

b_data = list(b.getdata())

b_matrix = [b_data[i:i+width] for i in range(0, len(b_data), width)]

```

卷积神经网络的基本结构

卷积神经网络由多个卷积层、池化层、全连接层等组成。其中,卷积层是CNN的核心部分,用于提取图像的特征。卷积层通过卷积操作将输入图像与卷积核进行卷积运算,得到特征图。池化层用于缩小特征图的尺寸,减少计算量。全连接层用于将特征图转化为分类结果。下面是一个简单的CNN模型结构:

最为重要的操作之一。卷积操作可以将输入图像与卷积核进行卷积运算,得到特征图。

彩*图色**片的卷积操作

对于彩*图色**片,每个像素点有三个通道的像素值,因此我们需要对每个通道分别进行卷积操作。具体来说,我们可以将彩*图色**片表示为三个二维矩阵$X_{r}$、$X_{g}$、$X_{b}$,分别表示红、绿、蓝三个通道的像素值。卷积核也是一个三维矩阵$W_{r}$、$W_{g}$、$W_{b}$,分别表示红、绿、蓝三个通道的卷积核。

对于输入图像$X$和卷积核$W$,我们可以分别对三个通道进行卷积操作,得到三个特征图$Y_{r}$、$Y_{g}$、$Y_{b}$。最终的输出特征图$Y$可以通过将三个特征图在深度维度上进行拼接得到。具体来说,我们可以将三个二维矩阵$Y_{r}$、$Y_{g}$、$Y_{b}$分别表示为三维矩阵$Y_{r}$、$Y_{g}$、$Y_{b}$,然后将它们在深度维度上进行拼接得到输出特征图$Y$。

下面是一个简单的代码示例:

```python

import numpy as np

from scipy import signal

# 输入图像(RGB三个通道)

X_r = np.array([[1, 2, 3], [4, 5, 6], [7, 8, 9]])

X_g = np.array([[9, 8, 7], [6, 5, 4], [3, 2, 1]])

X_b = np.array([[2, 4, 6], [8, 10, 12], [14, 16, 18]])

# 卷积核(RGB三个通道)

W_r = np.array([[1, 0, -1], [2, 0, -2], [1, 0, -1]])

W_g = np.array([[0, 1, 0], [1, -4, 1], [0, 1, 0]])

W_b = np.array([[-1, -1, -1], [-1, 8, -1], [-1, -1, -1]])

# 对每个通道进行卷积操作

Y_r = signal.convolve2d(X_r, W_r, mode='same')

Y_g = signal.convolve2d(X_g, W_g, mode='same')

Y_b = signal.convolve2d(X_b, W_b, mode='same')

# 将三个特征图在深度维度上进行拼接

Y = np.stack([Y_r, Y_g, Y_b], axis=-1)

```

池化操作

池化操作用于缩小特征图的尺寸,减少计算量。常用的池化操作有最大池化和平均池化。最大池化将特征图中每个子区域的最大值作为输出,平均池化将特征图中每个子区域的平均值作为输出。

对于彩*图色**片,我们可以分别对三个通道进行池化操作,然后将三个池化结果在深度维度上进行拼接得到输出特征图。具体来说,我们可以将三个二维矩阵$Y_{r}$、$Y_{g}$、$Y_{b}$分别表示为三维矩阵$Y_{r}$、$Y_{g}$、$Y_{b}$,然后对它们分别进行池化操作,得到三个池化结果$Z_{r}$、$Z_{g}$、$Z_{b}$。最终的输出特征图$Z$可以通过将三个池化结果在深度维度上进行拼接得到。

下面是一个简单的代码示例:

```python

# 对每个通道进行最大池化操作

Z_r = signal.pool2d(Y_r, (2, 2), mode='max')

Z_g = signal.pool2d(Y_g, (2, 2), mode='max')

Z_b = signal.pool2d(Y_b, (2, 2), mode='max')

# 将三个池化结果在深度维度上进行拼接

Z = np.stack([Z_r, Z_g, Z_b], axis=-1)

```

全连接层

全连接层用于将特征图转化为分类结果。具体来说,全连接层将特征图展开成一维向量,然后通过一个全连接层进行线性变换和激活函数处理,最终得到分类结果。

对于彩*图色**片,我们可以将输出特征图$Z$展开成一维向量,然后通过一个全连接层进行线性变换和激活函数处理,得到分类结果。具体来说,我们可以将三维矩阵$Z$转化为二维矩阵$Z'$,然后将其展开成一维向量$z$。然后通过一个全连接层进行线性变换和激活函数处理,得到分类结果。

下面是一个简单的代码示例:

```python

import torch

import torch.nn as nn

# 将三维矩阵Z转化为二维矩阵Z'

Z_ = Z.reshape(-1, 3 * Z.shape[1] * Z.shape[2])

# 定义全连接层

fc = nn.Linear(3 * Z.shape[1] * Z.shape[2], 10)

activation = nn.ReLU()

# 线性变换和激活函数处理

y = activation(fc(Z_))

```

总结

本文介绍了如何使用卷积神经网络对彩*图色**片进行卷积。具体来说,我们可以将彩*图色**片表示为三个二维矩阵,分别表示红、绿、蓝三个通道的像素值。然后对每个通道分别进行卷积操作,得到三个特征图。接着,对三个特征图分别进行池化操作,得到三个池化结果。最后,将三个池化结果展开成一维向量,通过一个全连接层进行线性变换和激活函数处理,得到分类结果。