我是老徐。

最近广州地铁出了个大新闻。

不少网友在疯传一张裸照,说三号线有个美女搞露出,把衣服脱了。

至于为什么这么疯狂,是因为背后有金主想看。

这些聊天记录描述得绘声绘色,加上还有图为证,很多人都信以为真了,散播范围极其之广。

有人对照片中的火辣身材点评了起来,还有的非常惋惜自己没能亲眼看到。

事情越闹越大,还火上了热搜,但事实真相也很快浮出水面。

什么裸女、金主,全是假的,实际是AI一键脱衣生成的裸照图。

当事人是正经的穿搭博主,经常以地铁为场景分享自己的穿搭。

那张所谓的裸照,原图是这样的。

果然造谣一张嘴,谣言跑断腿,哪怕是看到也不见得就是真相。

目前当事人已经进行了维权处理,只能说幸好及时止损了,没有造成更大的伤害。

不过,这次事件也再度引发了大众对于AI的恐慌,有人就在网上呼吁*制抵**人工智能之类。

但显然这些人搞错了方向,因为这件事错的不是AI,而是滥用AI的人。

AI发明出来是用来造福人类,提高我们的效率,说到底就是个工具,可恨的是那些心术不正的人把它用在了旁门左道上。

然而事实是这种人存在不少,AI技术被滥用早有先例。

之前刘明昊被传出一段淫秽视频截图,因为非常逼真,许多人都信了,纷纷大喊明星塌房。

结果发现其实是AI技术换脸。

这种困扰在不少明星那都出现过,最近的就有迪丽热巴遭到“强吻”。

事情是这样的,一位特效师找到迪丽热巴的一段吻戏,他将男主的脸换成了自己,强行和女明星亲吻。

不仅是迪丽热巴,其他剧也是,他就用这种方式占尽便宜。

这位特效师据说被迪丽热巴的粉丝揍了。

但依我看这个惩罚还是太轻了,因为这已经不单单是侵犯肖像权的问题,由此引发的谣言会对受害者造成名誉和身心怎样的伤害,没有人能预料到。

AI技术本该用在正确的方向,却被像他这样别有用心的人这般滥用,想想就觉得可怕。

这些人才是真正该被谴责的对象,因为即便没有AI,他们也会从其他方向去造黄谣。

最近很多学校传出的造黄谣的事情就是鲜活的例证。

像南华大学的何某某通过给女生P不雅照,散发她们的黄谣来谋取利益。

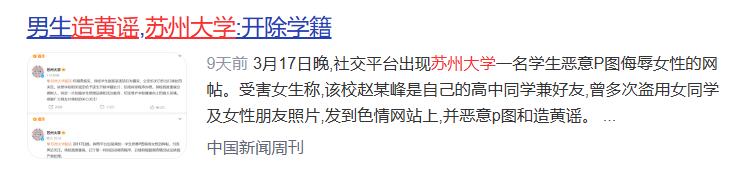

还有前不久苏州大学的赵某峰,把微信里的女性同学好友的照片P上生殖器发到色情网站上,编造自己和她们多次上床的谣言,导致受害者深受困扰。

关键是这人平日里看着很正派,成绩优秀,人缘也好,受害女生追查到他时都不敢相信是他干的。

所以说学习成绩和品格并不对等,有些人看着道貌岸然,实际上思想肮脏龌龊,下流至极。

不管是这些滥用AI给人扒衣换脸的特效师,还是给女同学P不雅照的大学生,他们在品格上就是一个水准。

而造黄谣会带来多么严重的后果,我们不是没看到,粉发女孩的死亡悲剧就是活生生的案例。

说得严重点,这就是杀人于无形,针对这种行为就应该是严惩不贷,让他们意识到这就是犯罪。

要知道,在美国这种事是真的会坐牢的,而且不管是否成年。

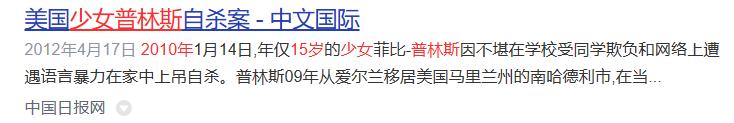

2010年美国就发生过一起造黄谣的案子,15岁女孩普林斯因同学在Facebook上散播污言秽语而自杀,凶手最后被判除了缓刑或社区劳动。

所以我强烈呼吁我们在法律上也要跟上,必须要让这些喜欢拿别人去意淫,造黄瑶的都受到严厉的惩罚。

如果只是简单地拘留几天或者*帖删**就能平安无事,那么以他们这种变态的心理,很有可能还会再犯,甚至会想方设法做得更隐蔽点。

同时也会助长更多的人肆无忌惮地造黄谣。

而这绝不是我们想看到的局面。