欢迎回到我们的神经网络系列!今天,我们要谈一谈如何优化你的神经网络模型,特别是解决过拟合和欠拟合的问题,以及使用正则化的方法。拿出你的神经网络调参工具,我们开始吧!

神经网络调参

神经网络调参

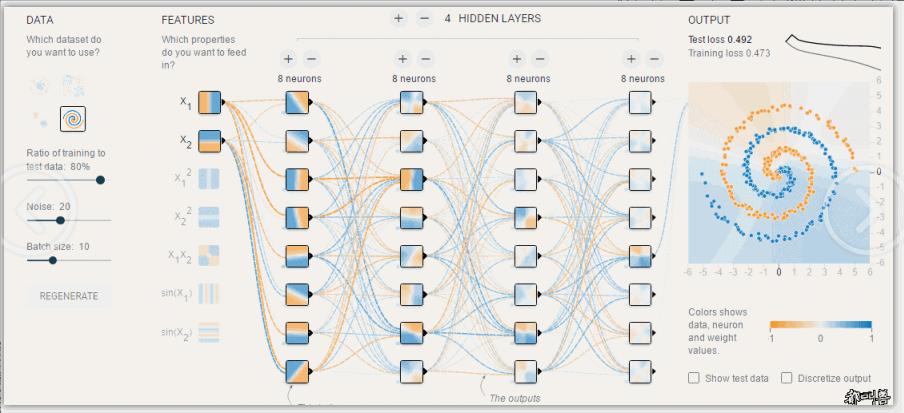

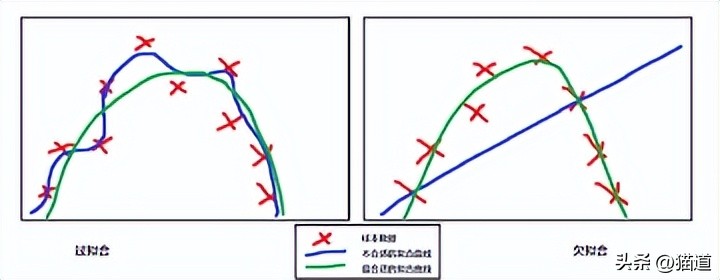

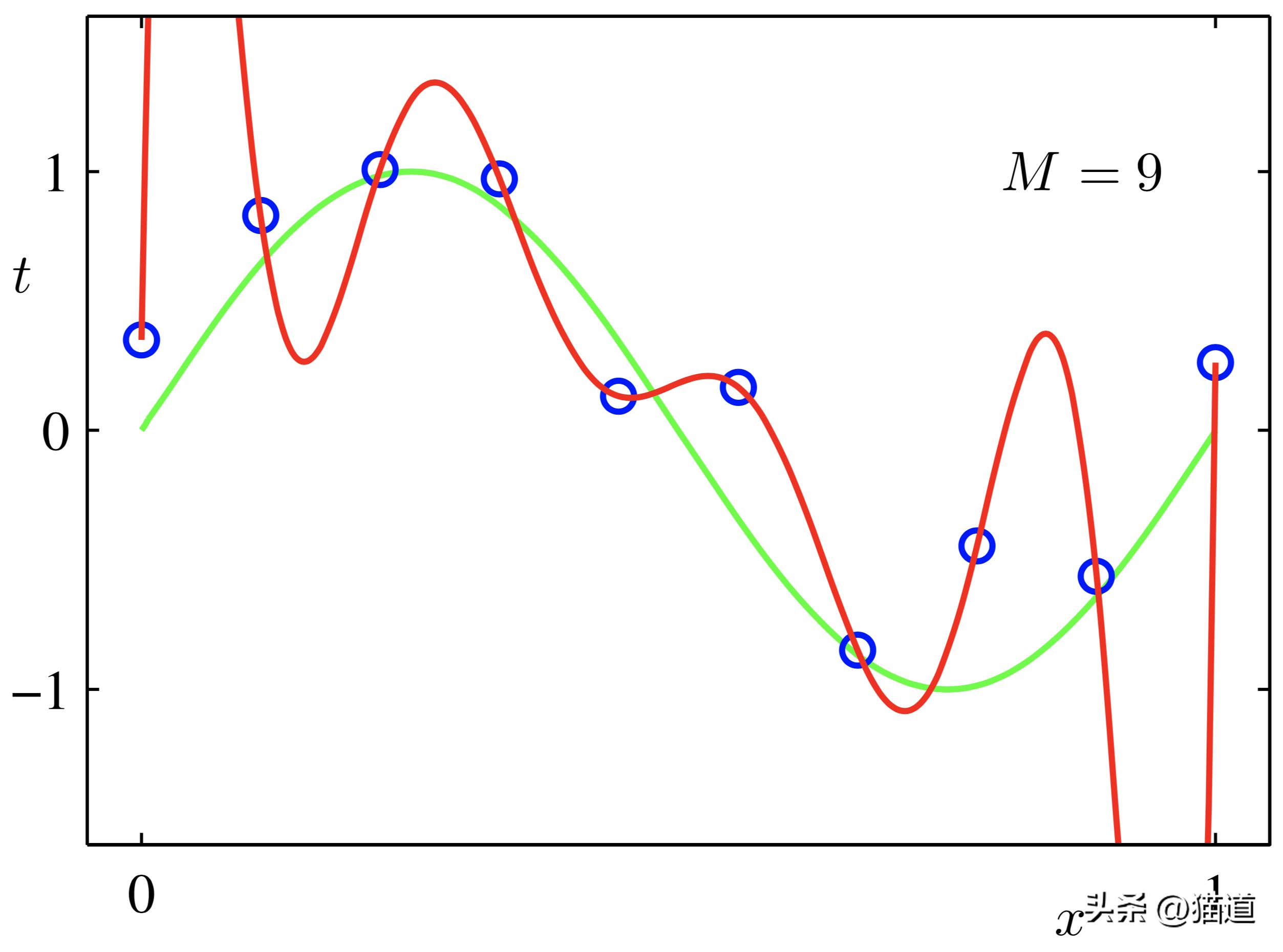

在训练神经网络模型的过程中,我们经常会遇到过拟合和欠拟合的问题。过拟合就像是一个过于勤奋的学生,他把老师讲的每一个例子都记下来,但是在遇到新的问题时,他可能会束手无策。相反,欠拟合就像是一个不够用功的学生,他对老师讲的东西只是一知半解,即使遇到老师讲过的问题,他也可能无法回答。

过拟合和欠拟合

为了解决过拟合和欠拟合的问题,我们可以使用正则化的方法。正则化就像是一个明智的教师,他知道如何调整教学方法,使学生既不会过度学习,也不会学习不足。具体来说,正则化是通过增加一个惩罚项来限制模型复杂度,从而防止过拟合。同时,正则化也可以通过调整模型参数来提高模型的泛化能力,从而防止欠拟合。

正则化

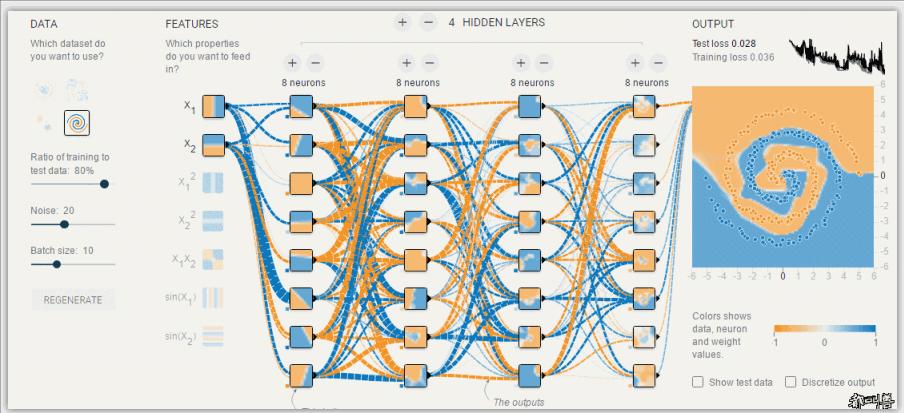

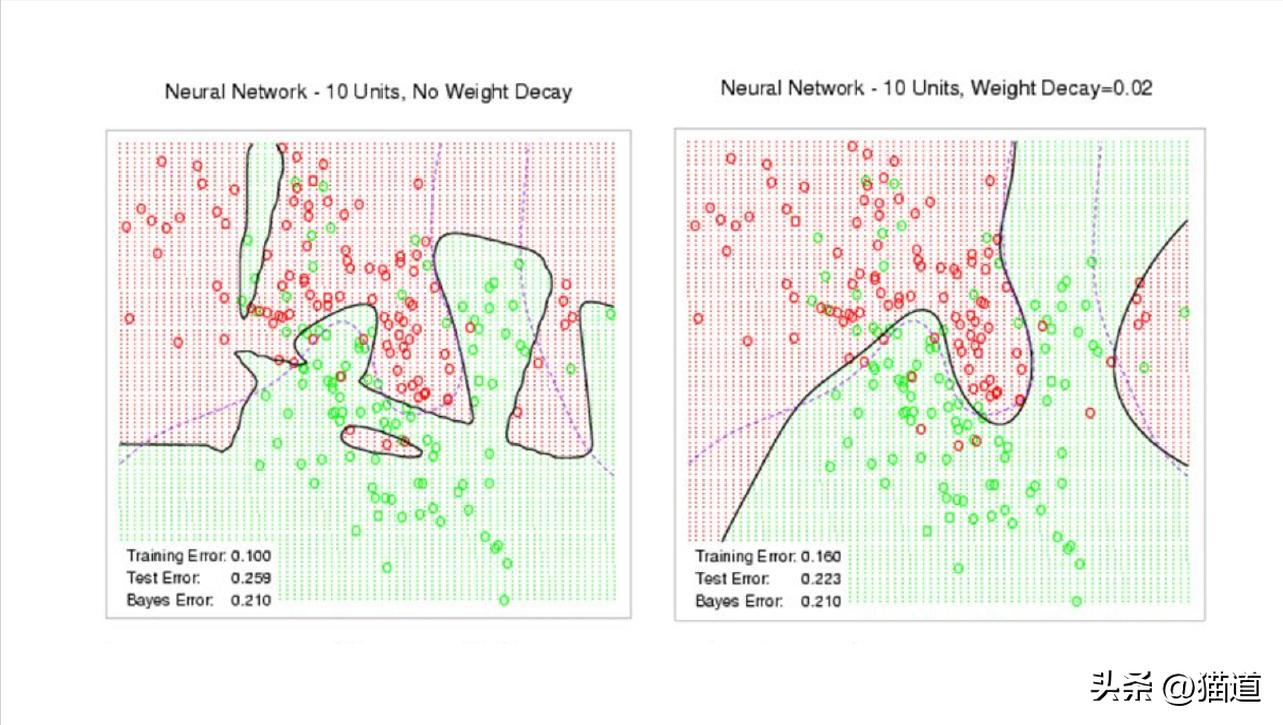

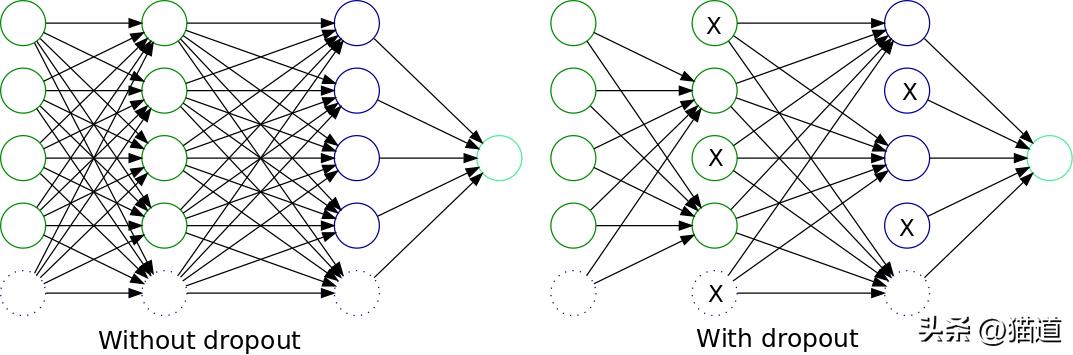

神经网络的正则化可以通过多种方法实现。一种常用的方法是权重衰减,它通过增加一个与权重大小相关的惩罚项来防止过拟合。另一种方法是dropout,它通过随机关闭一部分神经元来防止过拟合。这些方法都可以有效地优化神经网络模型,使其在新的数据上表现得更好。

权重衰减

dropout

优化神经网络模型需要一些技巧和经验。就像是一个优秀的教师,我们需要知道如何调整教学方法,使学生能够既掌握知识,又能应对新的挑战。在神经网络的世界里,没有什么是不可能的。只要我们有耐心和决心,我们一定能够成功。

在下一篇文章中,我们将讨论如何使用训练好的神经网络模型进行股市预测。我们将介绍如何使用模型进行实时预测,以及如何解释预测结果。敬请期待!

优化神经网络并不是一件容易的事情,但是通过理解过拟合和欠拟合,以及使用正则化,我们可以一步一步地接近目标。就像是一位优秀的教师,我们需要知道如何调整教学方法,以使学生能够更好地学习。同样地,我们也需要知道如何调整神经网络的参数,以使模型能够更好地预测股票价格。

所以,让我们一起踏上这次优化之旅,一起深入理解过拟合、欠拟合和正则化,一起优化我们的神经网络模型。在这个过程中,我们一定能够学到很多有用的知识,也一定能够收获很多乐趣。期待我们在下一篇文章中的见面!