本文将分享北京大学计算语言所硕士郭一诺等人发表于AAAI 2021的工作:利用迭代回译技术提高seq2seq模型的组合泛化能力。在本文中,他们重访一种简单而有效的半监督迭代回译技术,研究它是否能够以及如何改进来提高模型的组合泛化能力。

论文链接:

https://arxiv.org/abs/2012.04276

一、研究背景

组合泛化能力是人类智能最基本的一种能力(即对已有的复杂对象进行解构,从而用见过的小部件来组合出新东西的能力),但是当前的神经seq2seq模型缺乏这种能力。在本文中,我们重访一种 简单而有效的 半监督迭代回译技术(iterative back-translation) ,研究它是否能够以及如何改进来提高模型的组合泛化能力。

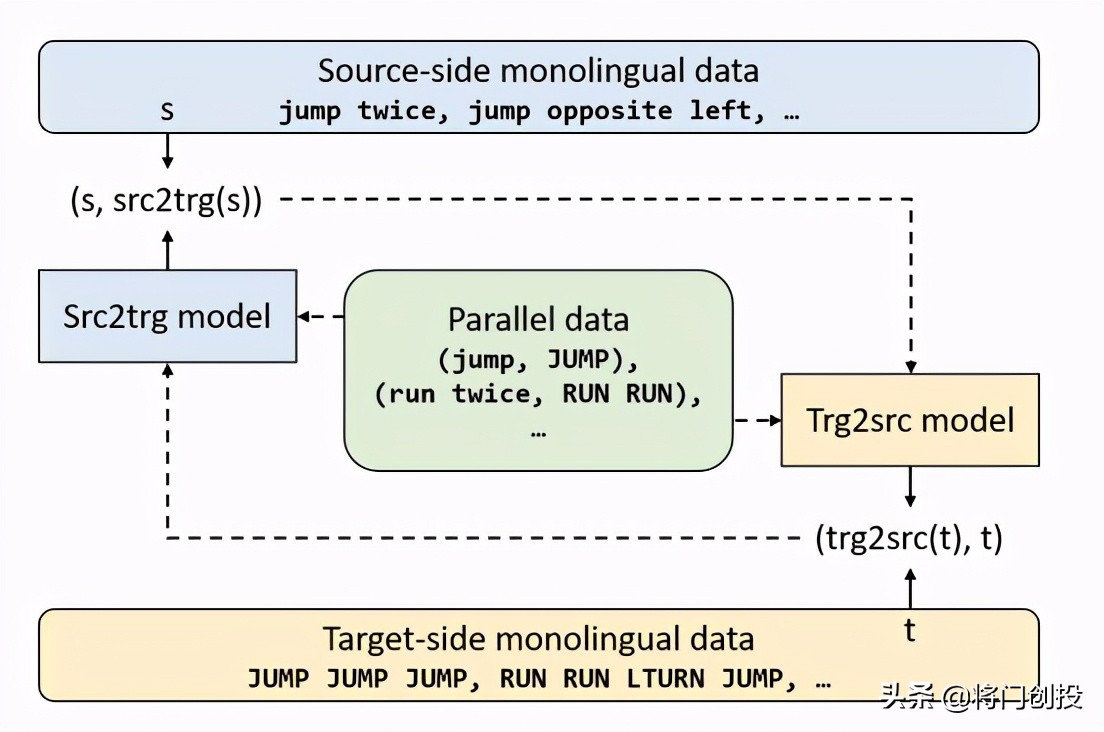

迭代回译技术是一种简单高效的半监督学习技术,它利用有标注数据和无标注数据共同训练模型。我们知道,有标注的数据往往非常有限并且昂贵,无标注的数据成本低且总量大,因此其中包含大量没见过的组合。据此我们做出合理的猜想:迭代回译能够让seq2seq模型在训练过程中见过更多组合,从而提高模型的组合泛化能力。

图1:迭代回译技术(iterative back-translation)图示

在这篇工作中,我们主要探究三个问题:

- 迭代回译技术是否能够提高seq2seq模型的组合泛化能力;

- 如果可以,背后的关键因素是什么;

- 如何改进迭代回译技术,进一步提高模型的组合泛化能力。

二、实验探究

1. 探究迭代回译技术是否能够提高seq2seq模型的组合泛化能力

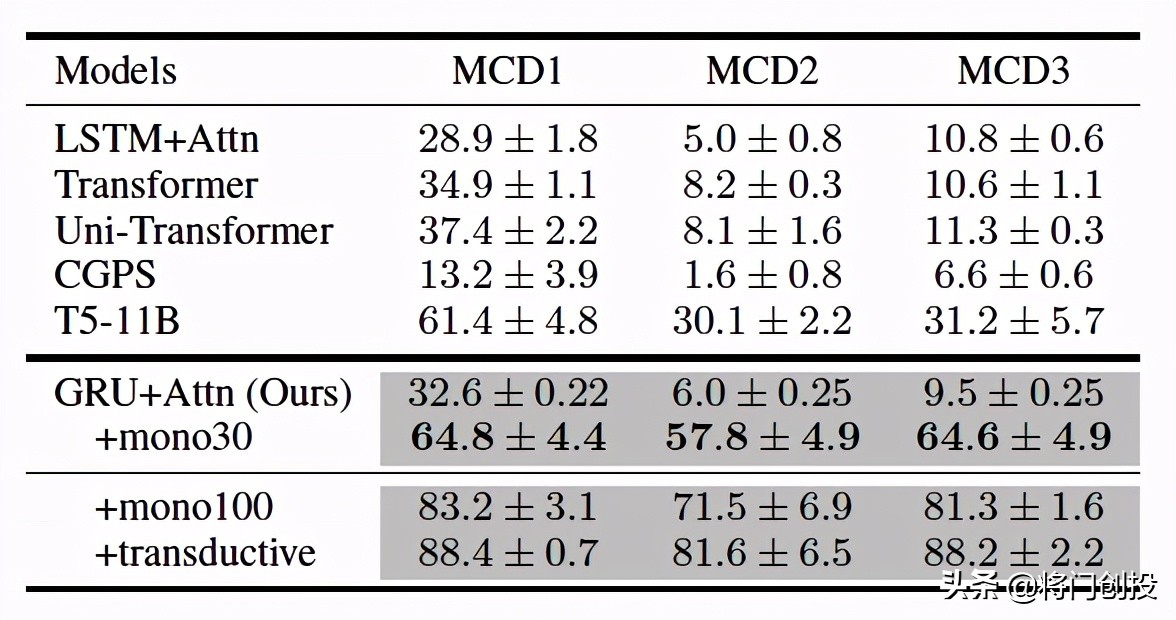

首先,我们在CFQ和SCAN数据集上进行验证,结果如下图所示。可以看到, 迭代回译技术能够显著提高模型的组合泛化能力,且数据质量越高,带来的提升越显著。

表1:在 CFQ 和 SCAN 数据集上进行验证的结果

2. 探究迭代回译技术提高seq2seq模型组合泛化能力的关键因素

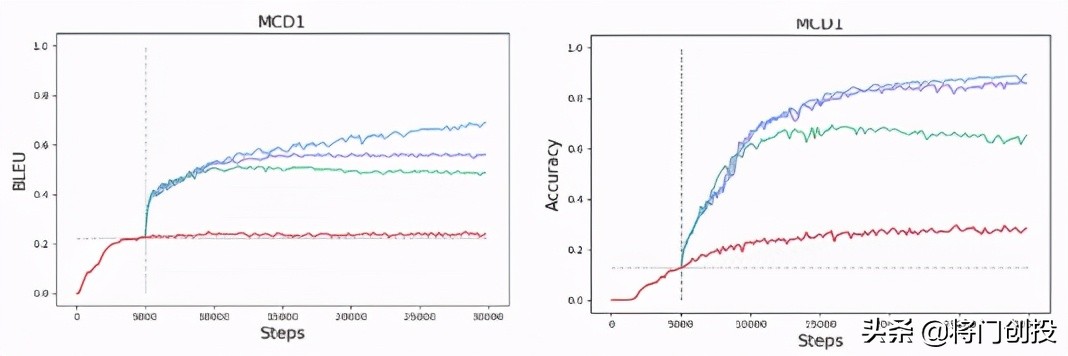

为了探究其背后的关键因素,我们首先 对迭代过程中生成的伪平行数据的质量进行分析 。我们可以看到,伪平行数据的质量随着训练过程的进行不断提升,虽然一开始质量较差,但模型能够不断 的 改正其中的错误,最终达到不错的效果。

图2:对迭代过程中生成的伪平行数据的质量分析结果

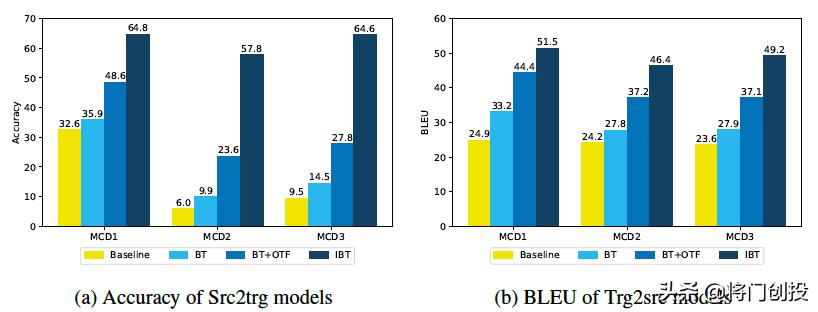

进一步,我们 针对数据质量和随机性两个因素设计了消融实验 :

1. BT :标准的回译技术(back-translation),利用第一次生成的伪平行数据(包含较多错误,低bleu/accuracy)和平行数据训练模型;

2. BT-OTF :迭代过程中每次动态生成数据从而引入随机性,因此这个设定下我们利用反向模型动态生成新的伪平行数据,但反向模型不加入单语数据进行训练(每次生成的伪平行数据质量相当,但数据不相同)。

下图展示了我们的实验结果,我们发现对于(1),即使数据中包含较多错误,但仍能够提高模型的表现,我们认为即使错误的数据,其中仍然包含了很多没见过的组合,因此依然能够带来正向的效果;(2)实验结果看到随机性带来提升非常明显,我们认为由于动态生成新的数据能够有效避免模型去拟合一些固定的错误偏置,更多关注共有的数据特征。

图3:消融实验结果

3. 探究如何改进迭代回译技术,进一步提高模型的组合泛化能力

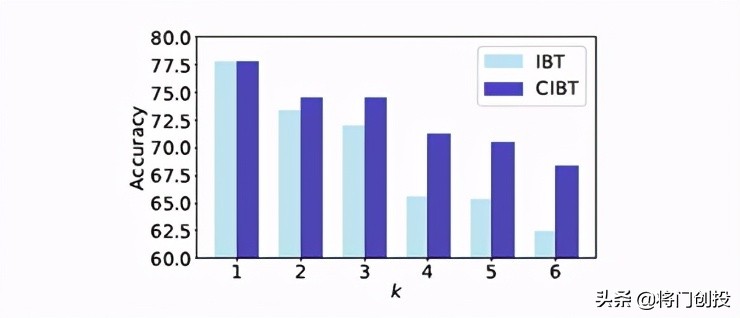

为了能够进一步高效的帮助模型提高修正错误的效率,这里我们 提出了基于课程学习的 迭代回译技术 (curriculum iterative back-translation) ,具体来说就是我们把数据集由易到难划分为K份,在最开始加入最简单的数据,随着训练的不断进行,依次增加加入数据的难度。实验结果如下,课程学习对迭代回译技术有非常大的帮助,且更有利于困难的数据。

表2:半监督迭代回译技术在准确度上的表现

图4:半监督迭代回译技术在不同数据集的表现

三、总结

该研究主要的启发点:

- 迭代回译技术(iterative back-translation)能够显著提高seq2seq模型的组合泛化能力。

- 迭代回译技术(iterative back-translation)之所以能够带来明显提升,其背后的原因可以归结为三点:

- 单语语料中包含许多没见过的组合

- 它能够帮助明显提升生成的伪平行数据的质量

- 随机性的引入减少模型去过拟合一些错误偏置,从而更关注共性的特征

- 提出了基于课程学习的迭代回译技术来从而进一步提升效果。

Illustration by Natasha Remarchuk from Icons8