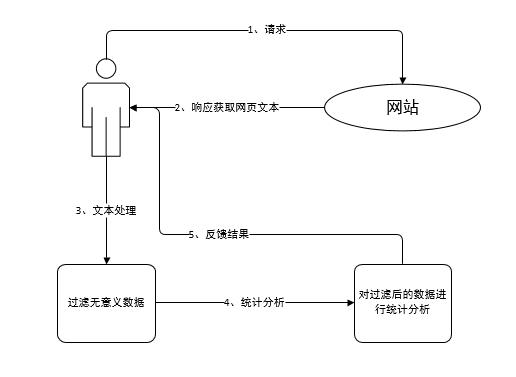

现在越来越多人利用Python从网络上爬取对自己有用的数据,然后进行分析,最终得到自己想要的结论,那么从爬取数据到分析的过程是怎么样的呢?

上图是一个简单的从爬取数据到统计分析的过程。

关于robot.txt

Robots协议是网站国际互联网界通行的道德规范,其目的是保护网站数据和敏感信息、确保用户个人信息和 隐私不被侵犯。(摘自网络)

Robots.txt是一个小文本文件,位于网站的根目录中。它告诉抓取工具是否要抓取网站的某些部分。该文件使用简单的语法,以便爬虫可以放置到位。(摘自网络)

因此,在学习如何抓取数据前,应熟知利用爬虫爬取数据的一些规范。

哪些是网页文本?

这是我们平常看到的页面

平常的页面

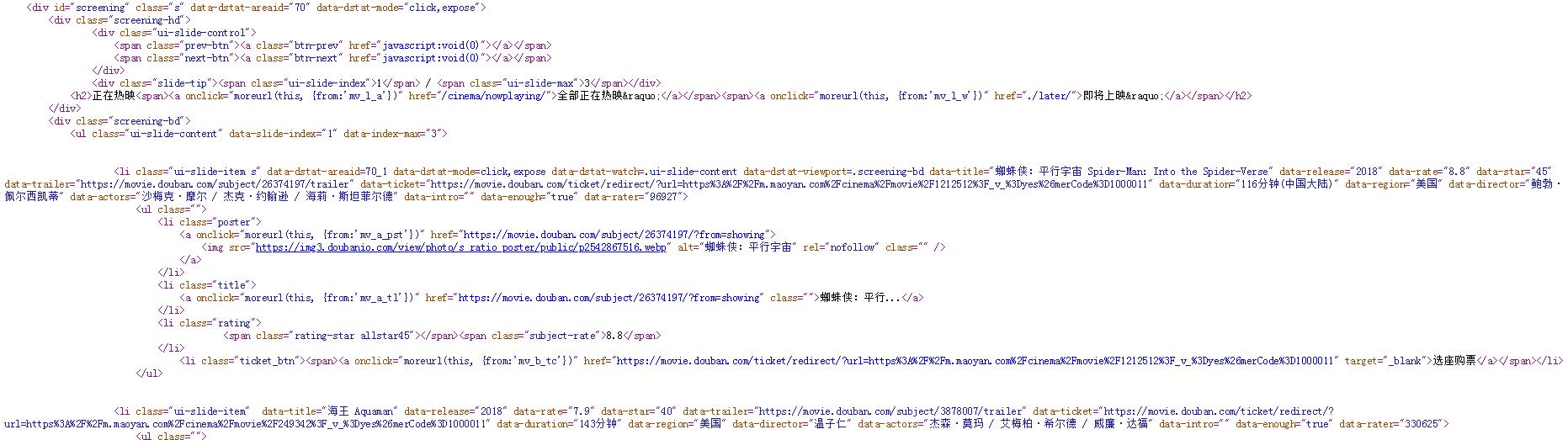

对该页面点击鼠标“右键”,然后查看“源代码”,就可以看到我们想要的网页文本,如:

我们平常所看到的网页时该网页文本在本地加载后生成的,也是我们要抓取的数据。

如何抓取数据?

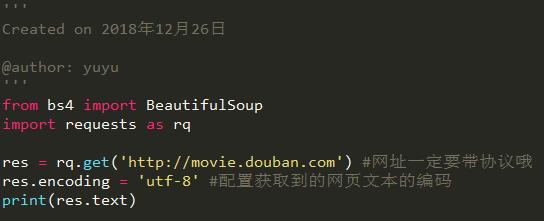

Python有很多种可以抓取网页文本的工具,今天就先讲利用“BeautifulSoup”和“requests”包抓取数据:

第一步:要先确定网页位置,如:http://movie.douban.com

第二步:向该网页位置发送获取文本请求

第三步:配置网页编码,如:utf-8

第四步:输出网页文本

获取网页文本示例

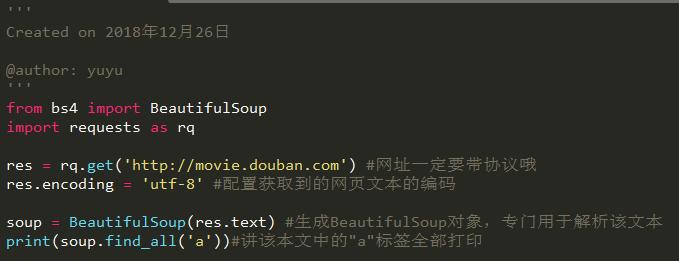

然后我们开始对该文本进行分析,获取该文本下的“<a>”标签的数据:

获取“<a>”标签内容的示例

到这里,我们就可以进行对“<a>”标签内容进行统计分析了。

这只是一个简单的案例,在我们的日常网页浏览中,还会碰到很对使用js生成的网页,还有带“登录”才能查看的网页,我们陆续会讲解如何解决。