欢迎回到神经网络的世界。让我们开始今天的旅程,探索神秘的循环神经网络(RNN)世界吧!

一、什么是循环神经网络(RNN)?

循环神经网络(RNN)是一种神经网络,它的特点是能够处理时间序列数据。时间序列数据是指那些随时间变化的数据,比如股票价格、气温、语音信号等。RNN的一个重要特性是它们能够记住过去的信息,这使得它们非常适合处理序列数据。

想象一下,你正在读一本书。当你读到一个句子时,你不仅理解了这个句子的内容,还记住了之前的句子。这使得你能够理解整个故事的情节。这就是RNN的工作方式:它们不仅处理当前的输入,还记住了过去的输入。这就是为什么它们被称为“循环”神经网络。

二、RNN的工作原理

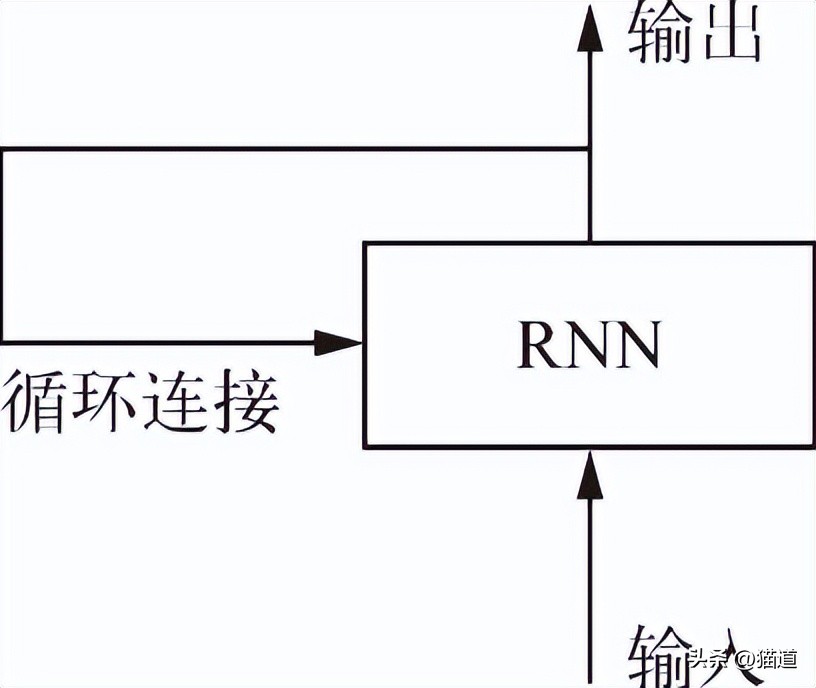

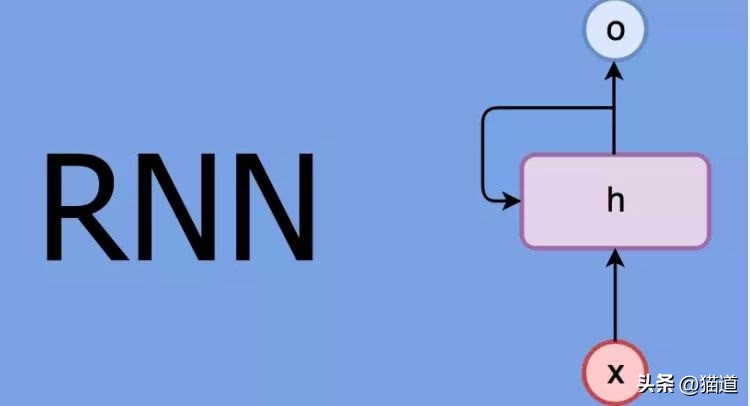

让我们更深入地了解一下RNN的工作原理。RNN的核心思想是利用“隐藏状态”来记住过去的信息。隐藏状态是网络的内部状态,可以理解为网络的“记忆”。

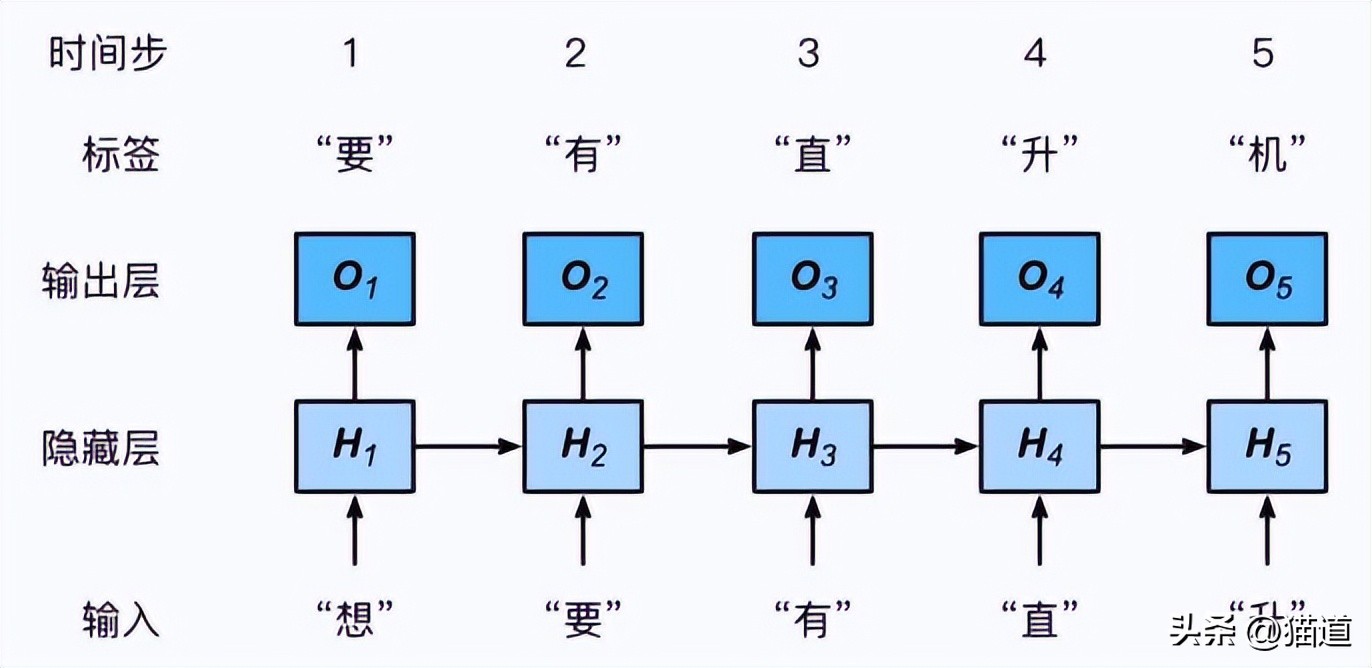

在处理序列数据时,RNN会在每个时间步长(timestep)更新其隐藏状态。时间步长可以理解为序列中的一个元素。例如,如果我们正在处理一个句子,那么每个单词就是一个时间步长。

RNN的隐藏状态是通过当前的输入和前一个时间步长的隐藏状态来计算的。这就是RNN如何记住过去的信息的。具体来说,RNN会将当前的输入和前一个时间步长的隐藏状态传递给一个函数(通常是非线性函数,如tanh或ReLU),这个函数会返回新的隐藏状态。

这就是RNN的基本工作原理。但是,实际上,RNN还有许多变体,如长短期记忆网络(LSTM)和门控循环单元(GRU),它们在处理长序列时表现更好。

三、如何用PyTorch实现一个简单的RNN?

现在,让我们看看如何用PyTorch这个流行的深度学习库来实现一个简单的RNN。首先,我们需要导入PyTorch库:

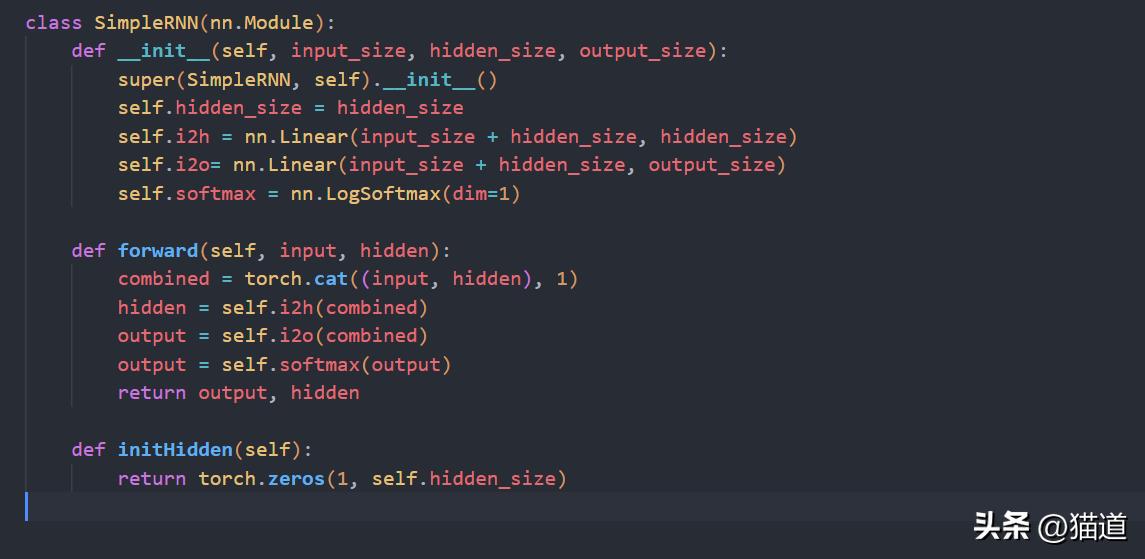

然后,我们可以定义一个RNN类,继承自PyTorch的nn.Module类:

在这个类中,我们定义了两个线性层(i2h和i2o),它们分别用于计算新的隐藏状态和输出。我们还定义了一个softmax层,用于将输出转换为概率分布。

在前向传播函数(forward)(啥是前向传播?回顾一下:(5) 深入神经网络:前向传播与反向传播)中,我们首先将输入和隐藏状态拼接在一起,然后通过i2h和i2o层计算新的隐藏状态和输出。最后,我们通过softmax层将输出转换为概率分布。

initHidden函数用于初始化隐藏状态。在开始处理序列时,我们需要调用这个函数来获取初始的隐藏状态。

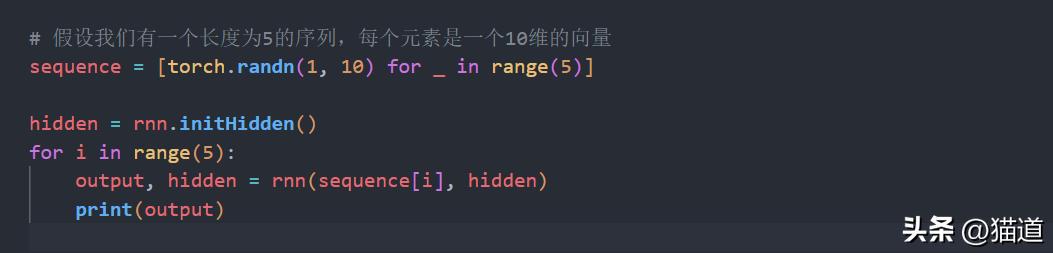

现在,我们可以创建一个RNN实例,并用它来处理一个序列:

在这个例子中,我们首先创建了一个RNN实例,然后用它来处理一个长度为5的序列。在每个时间步长,我们将当前的输入和前一个时间步长的隐藏状态传递给RNN,得到输出和新的隐藏状态。

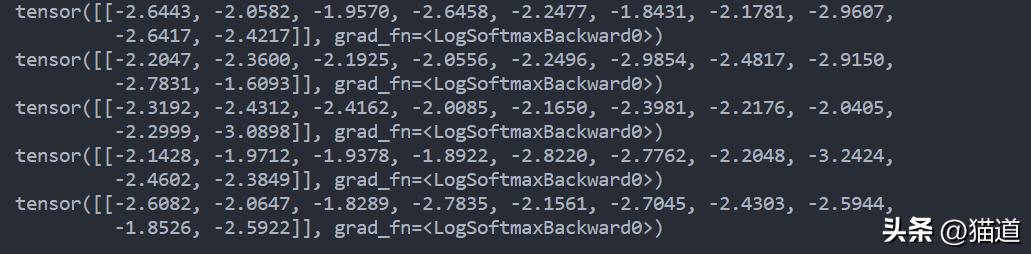

运行结果

这就是如何用PyTorch实现一个简单的RNN。当然,实际上,我们可能需要处理更复杂的任务,比如语言建模、文本分类等。在这些任务中,我们可能需要使用更复杂的RNN结构,如LSTM或GRU,或者使用更高级的技术,如注意力机制(attention)。

现在最火的人工智能项目ChatGPT就是基于注意力机制的循环神经网络。

我们在之后的文章里,将会以简化版的ChatGPT为目标,一步一步完成我们自己的GPT模型,大家敬请期待。

希望这篇文章能帮助你理解RNN的基本概念和工作原理,以及如何用PyTorch实现一个简单的RNN。在下一篇文章中,我们将探讨RNN的一些变体,以及如何用它们来处理更复杂的任务。敬请期待!