数据显示,2022年全国网络电信诈骗金额高达2万亿元人民币,而军费预算也不过1.45万亿元。此外,2022年澳大利亚网络诈骗金额高达31亿美元,同比2021年暴增80%,达到了创纪录的惊人金额。

在科技如此发达的今天,为何诈骗分子还能够如此的猖獗?为何现有的科技还是不能杜绝诈骗?问题究竟出在哪里?

需要知道,科技在进步的同时,诈骗分子所掌握的科技手段其实也在进步,甚至有些手段人们连听都没听过。就比方说,AI语音克隆技术。

AI语音克隆技术是一种基于人工智能技术进行语音复制的技术,也称作语音合成或语音生成。通过使用深度学习和其他机器学习技术,将一个人的语音样本提取出其语音特征,并结合语言模型进行生成新的语音。

简而言之,如果这项技术被运用到电信诈骗上,那么诈骗分子就可以利用这项技术,从你的朋友圈视频、聊天语音记录等途径截取部分片段,然后利用AI技术进行合成声音。需要注意的是,AI模型可以在一分钟之内就可以完成合成声音的过程,而且产出的声音与本人的声音十分相似,普通人很难区分克隆的声音和真实的声音。

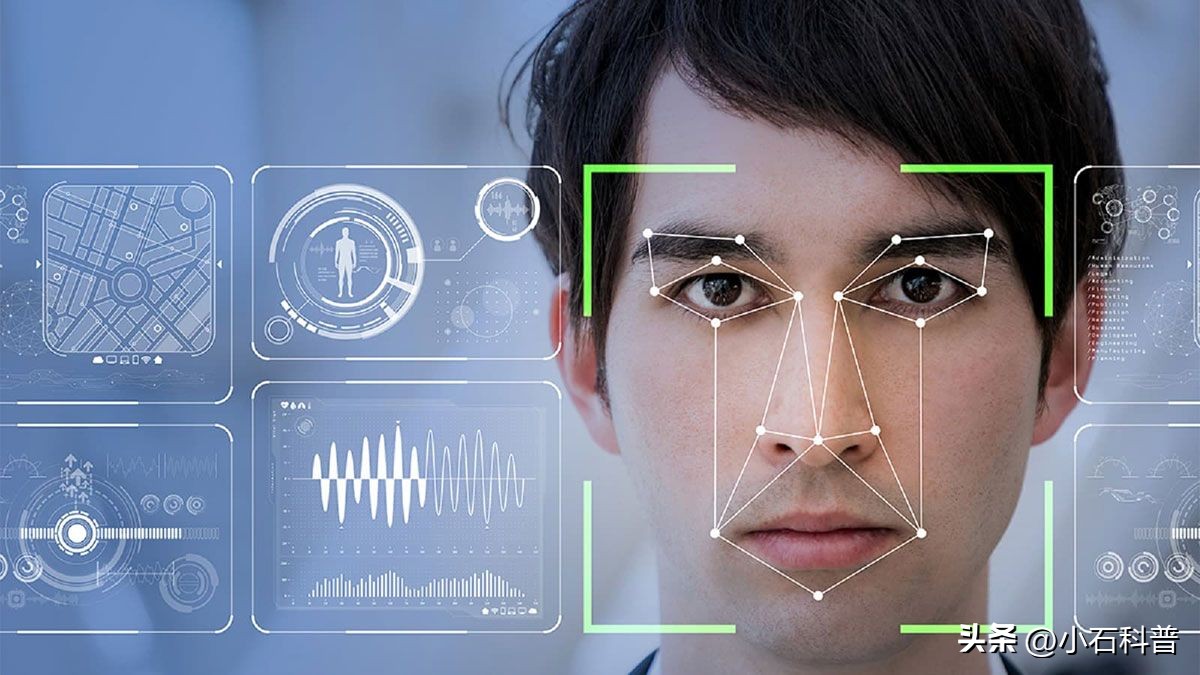

除了“偷声音”,其实诈骗分子还能够“偷脸”。近期,“10分钟被骗430万”的事情在网上就曾闹得沸沸扬扬。

事情的起因是诈骗分子利用AI技术进行换脸,随后打通了受害者的视频电话,告知他现在亟需430万的保证金竞标项目。受害者出于对“朋友”的信任,二话不说就分两笔把430万转到了这位“朋友”的卡上。整个过程,先后不过10分钟而已。

好在,这位受害者反应十分快,最终通过警方的努力追回了336.84万,但仍旧有93.16万已经被转移走了,想要在追回恐怕是希望渺茫了。

除了AI克隆语音、换脸外,诈骗分子还可以利用AI怎么进行诈骗呢?比方说,金融诈骗。

正所谓“你不理财,财不理你”。现在有很多人都在关注资本市场,对资本市场的高风险高回报充满了激情。然而,一不小心就会着了诈骗分子的道。

以下是金融诈骗的一些常见的手段:

1. 欺诈推销:诈骗分子利用AI技术,向投资者推销作为投资机会的虚假产品,使其相信可以获取高于市场水平的收益。这种手段通常出现在股票、期货、外汇等市场中。

2. 仿冒服务:诈骗分子可以创建外观与金融机构相似的虚假网站、应用程序等,通过提供与金融机构类似的服务,引诱用户输入个人敏感信息以达到骗财骗物的目的。

3. 虚假数据分析:诈骗分子可以利用AI技术拟合虚假数据,通过这些数据来误导投资者做出错误的决策。

此外,情感诈骗也是一种新起来的诈骗方式。

1. 利用自然语言生成技术,以假乱真地生成虚假的情感内容,通过写作或文字沟通诱骗受害人。

2. 利用机器学习技术,分析受害人的个人信息,结合大数据,设计和执行有针对性的诈骗策略,使受害人产生强烈的情感反应,进而上当受骗。

3. 利用情感分析技术,对受害人的各种情感变化进行实时监测和跟踪,从而更好地了解他们的需求,精准制定诈骗方案。

总之,不管是哪一种诈骗手段,最为简单、快速的处理方式就是约线下见面。如果说想图省事,或者是利益熏心,那就正中诈骗分子下怀。