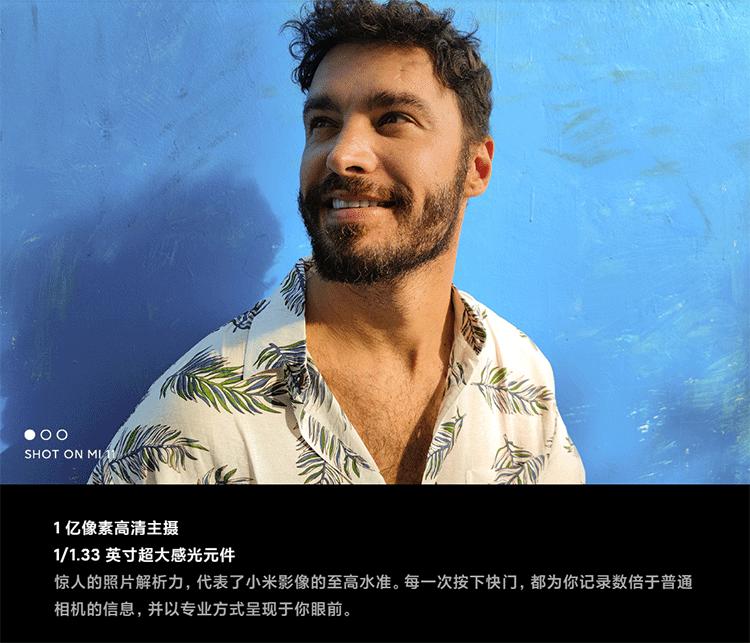

随着影像技术的不断发展,尤其在手机拍照方面,CMOS的底面积越来越大,例如IMX700的1/1.28英寸,IMX698的1/1.43英寸,ISOCELL HMX的1/1.33英寸,IMX598的1/2英寸,GN1的1/1.3英寸等等。

可以说,随着技术的不断发展,手机里面的CMOS其底是越来越大,好处是拥有更大的进光量,带来的问题就是,安卓阵营的机器很难再做小了,基本没有低于6.1英寸的屏幕手机了。

但是,不可否认的是,CMOS的大底,给消费者的摄影带来很多良好的体验。但是,随着CMOS的大小发展速度来越慢的时候,有一个技术却在不断的优化和提高手机影像。这就是AI!

智能手机成像的特殊性在于,其他领域的成像,如医疗成像、工业领域的机器视觉等,在图像传感器层面是以“拍得到”为主要目标,并且更注重图像数据的后处理与计算。而手机拍照向来以“拍得好”为主要目标,它对图像传感器的重视由来已久。

智能手机制造商在宣传其拍照的卖点时,仍然更倾向于CIS本身的高像素和大尺寸。但成像质量的决定因素已经从CMOS,向图像数据的处理与计算环节倾斜,它体现的也正是数字芯片本身的技术发展以及AI技术的快速推进对传统光学技术发展的挑战。

联发科在2018年提出了“真AI相机”的概念。该概念包含了三个主要的因素:1.高像素、大尺寸CMOS;2.多核ISP;3.高性能的AI专核。其中,第一点是成像领域的共识,而后两点都与图像数据的后处理(Post Processing)相关。

如果说ISP是处理(Processing)数据,那么AI及其他视觉处理器就是对数据做更深度的计算(Computing)。ISP的重要性在过去总被反复提及,但其在成像领域,尤其是手机拍照上的地位远不及CIS。此外,AI专核也是成像领域这两年的香饽饽。在此基础上,“真AI相机”这一营销概念的提出,本质上是为了吸引终端设备制造商来采用联发科的SoC产品,不过它却真正将ISP与AI专核提到了与CMOS相同的高度。

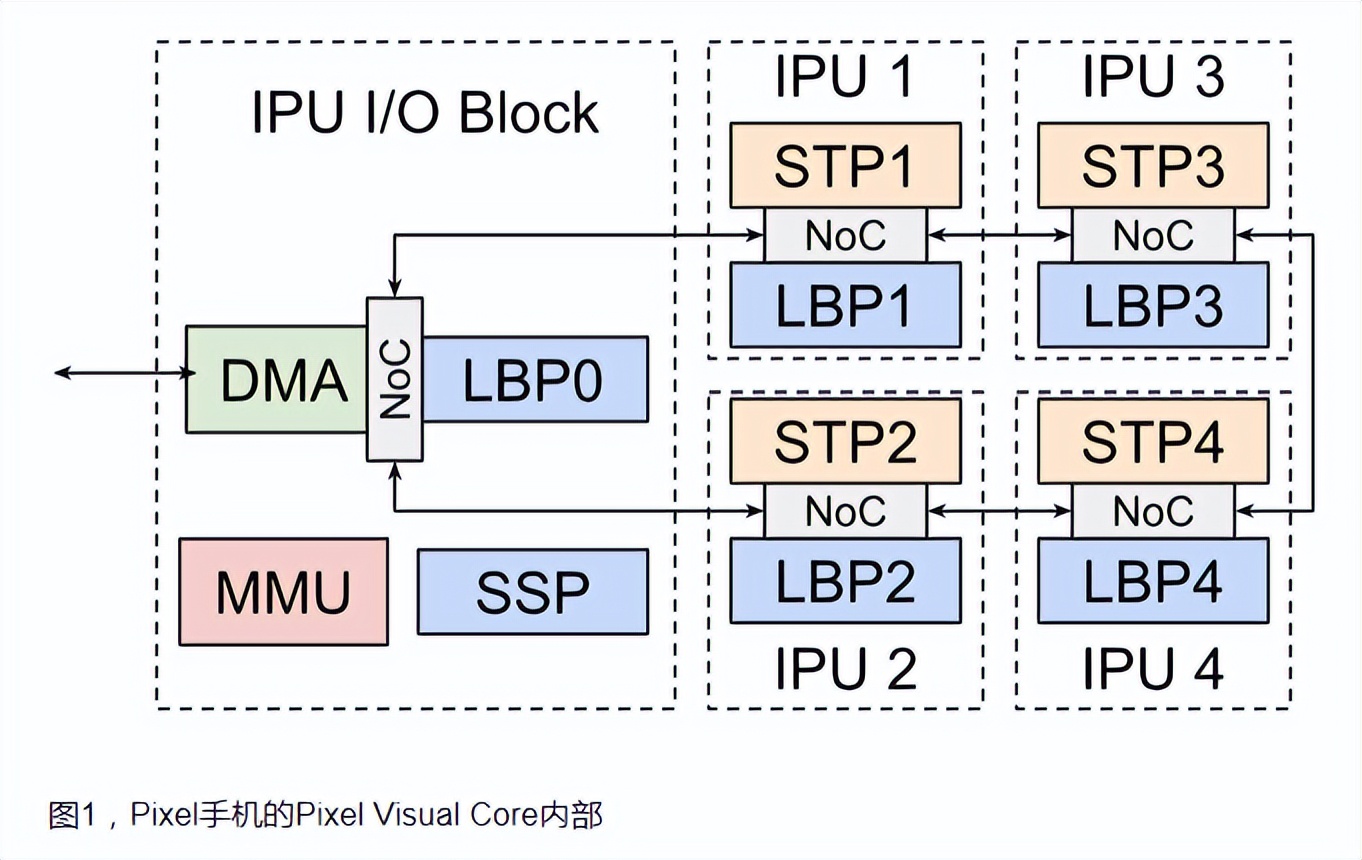

除了联发科这样的芯片厂商之外,谷歌的表现也值得关注。据《国际电子商情》了解,谷歌在2017年为其Pixel 2手机配备了专门的Pixel Visual Core(Pixel视觉核心,图1),这是由该公司自主设计的基于Arm系统的SiP封装图像/视觉处理器。这枚处理器可以看作是一个完全可编程的图像、视觉与AI多核专用架构(domain-specific architecture)芯片,其应用在Pixel 4之上迭代为Pixel Neural Core(Pixel神经核心)。

当然,谷歌Pixel系列手机在移动领域普遍更具有前瞻性和试水性质。谷歌在Computational Photography领域有着多年的沉淀,他们认为与高通在SoC内部提供ISP与AI Engine能力相比,针对拍照来自研专用的图像处理硬件更加高效。

在前智能手机时代,外置ISP/DSP是个常见的概念,但随着芯片集成大趋势的到来,当代图像处理硬件已很少以独立的形态存在于SoC之外。谷歌的这种做法进一步提升了图像/视觉处理器的地位:虽然外置一颗独立图像/视觉芯片的方案未必会成为趋势,但是在拍照的各环节中,后处理已经成为更重要的组成部分。

谷歌Pixel手机有个更有趣的传统:相同型号的CIS可以连续用在两代Pixel手机上,比如Pixel 3和Pixel 4的主摄都采用疑似索尼IMX363的COMS。即便如此,手机的拍照表现仍然会有飞跃,这个特点一直为人们所津津乐道。这也表明,谷歌在成像上非常重视图像处理,而不仅只关注图像传感。

再看看苹果那边,从A14着手分析,其CPU、GPU性能提升的幅度并不算大,但AI专核部分的Neural Engine(神经引擎)增加到16个核心,这让其算力提升到了11TOPS;A14 CPU内部还特别包含了升级过的机器学习AMX模块(矩阵乘法加速器)。如今,手机上的AI处理器总被人诟病没有太多应用场景,但它们在Computational Photography上正默默发挥作用。

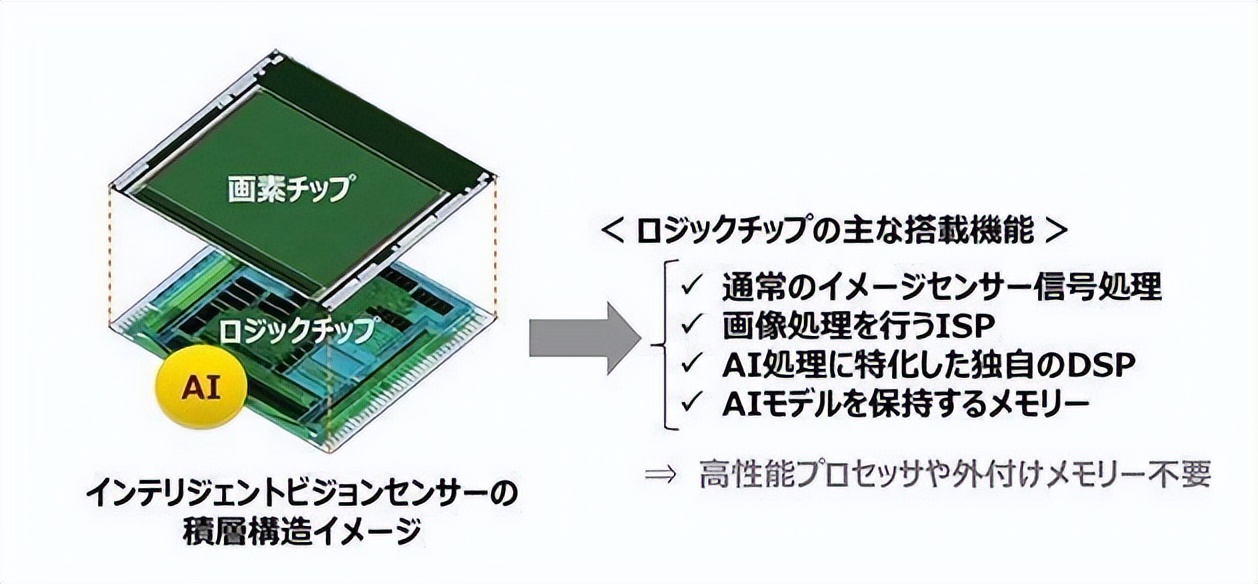

索尼在2020年5月推出了两款“智能视觉传感器”——IMX500与IMX501。该公司宣称,这是全球最早加入了AI处理能力的图像传感器。这两颗芯片的传感器部分,是比较典型的背照式CMOS;而集成的边缘AI处理部分,包含了DSP的逻辑芯片,也包括了AI模型所需的临时存储空间,属于比较典型的边缘AI系统。更严谨地说,IMX500/501恐怕不应仅定义为“传感器”。

这两颗芯片在配合云服务的情况下,在数据处理阶段仅获取元数据作为输出,这样能够降低数据传输延迟,减少功耗与通讯的成本。这类设计的本质是:将部分“后处理”的能力集成到图像传感器上。这样一来,录制视频时就能进行更高精度、实时的对象追踪。目前,这两款传感器主要应用于零售、工业设备。

2020年中,Yole Developpement发布了一份题为《2019图像信号处理器与视觉处理器市场与技术趋势》的报告。该报告明确提到:“AI彻底改变了视觉系统中的硬件,对整个行业都造成了影响。”

“图像分析增加了很多价值。图像传感器供应商们开始对将软件层集成到系统中感兴趣。如今图像传感器必须跳出单纯的捕获图像这一能力之外,再对图像做分析。”

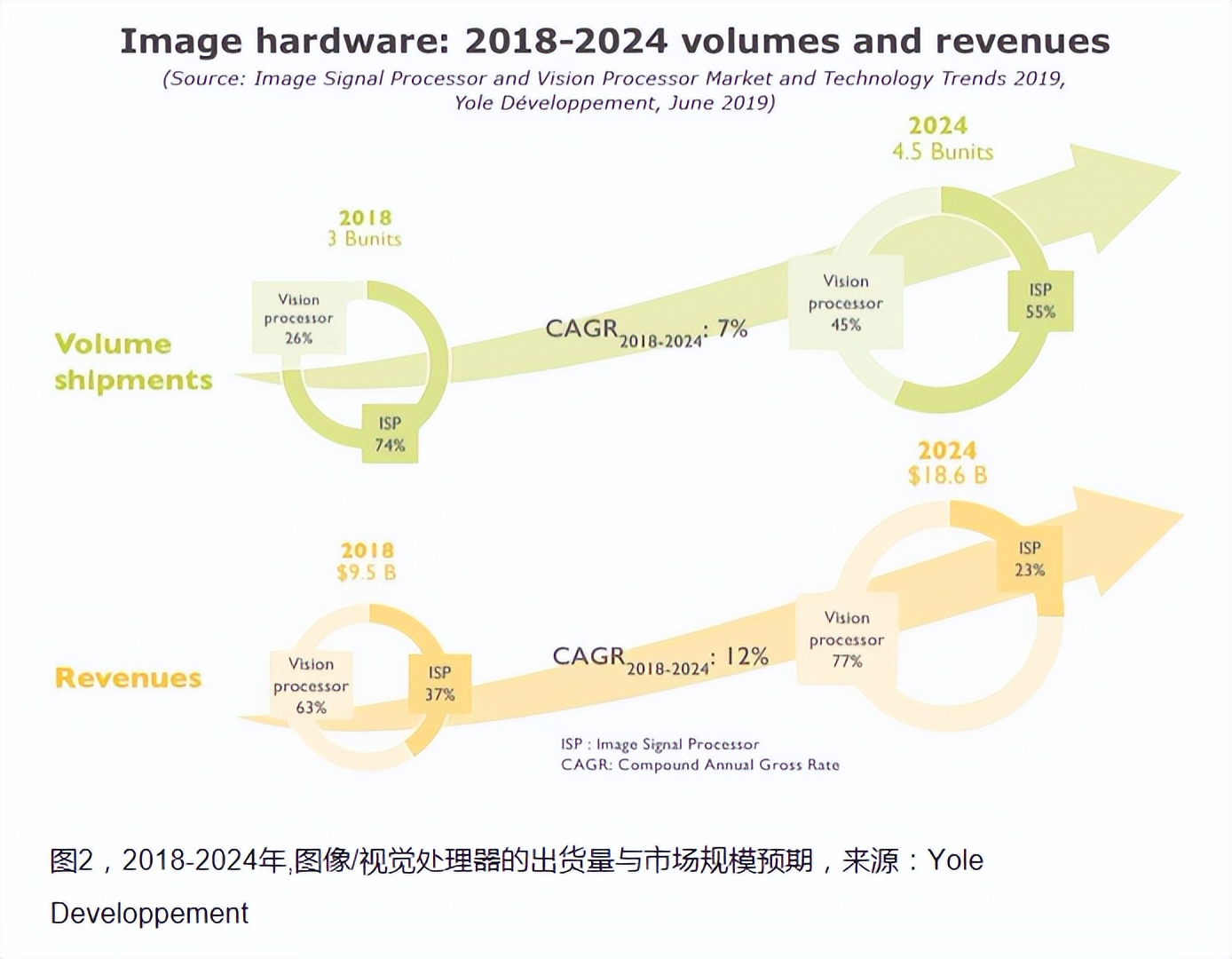

“但要跑这样的软件,就意味着高算力和存储需求,也就有了视觉处理器的出现。ISP市场2018-2024年的年复合增长率稳定在3%,即ISP的市场价值到2024年会达到42亿美元。与此同时,视觉处理器市场也会迎来爆发增长,2018-2024年的年复合增长率为18%,到2024年,其市场价值会达到145亿美元。”

这个值当然仍未达到COMS年度总价值,上述两个市场相加才大约超过今年的COMS市场规模(今年COMS行业产值预计为172亿美元)。这还需要注意,COMS市场的增速正在放缓以及此处并未考虑视觉处理芯片配套的软件市场。起码索尼认定,其长期的市场发展潜力大于COMS市场本身。Yole Developpement的预测数据显示,ISP在市场中所占比重将逐步降低,而更注重计算的视觉处理器显然更为紧俏(图2)。

“值得注意的是,很多传统的行业参与者,在应对AI趋势时显得比较局促。这也让其他更多参与者加入到业务竞争中,比如苹果、华为,Mobileye这样的初创公司,甚至其他领域的企业,像是英伟达。”这是成像市场扩展了纵深的表现。

2020年3月,法国知名影像实验室DxOMark曾刊文提到,近10余年来,智能手机拍照的画质提升超过4EV,其中1.3EV来自图像传感器/光学技术的提升,还有3EV是来自图像/视觉处理器(图像数据后处理)带来的提升。这已经基本颠覆了大众对于提升拍照画质,就是要提升COMS技术的基本认知。

这些的确是AI为成像带来的价值,但AI参与手机拍照的画质提升,渗透到了上述常规项目中。谷歌在Computational Photography方面的很多的研究也涉及到了这些组成部分,比如针对低光照场景下的自动白平衡,传统算法在白平衡修正上显得无能为力。谷歌几年前就应用了机器学习:通过向模型输入大量白平衡修正到位的照片,来训练自动白平衡的智能模型。

谷歌在Pixel手机成像的诸多环节和特性上应用了机器学习。比如拍照取景时的实时HDR,再比如视频拍摄的防抖。在数据后处理时,首先在第一阶段进行动作分析、获取陀螺仪信号、结合光学防抖动作;其次在motion filtering环节结合机器学习与信号处理,来预测相机本身的运动轨迹;最后在最终的帧合成环节,对快门与微动造成的画面失真做补偿。

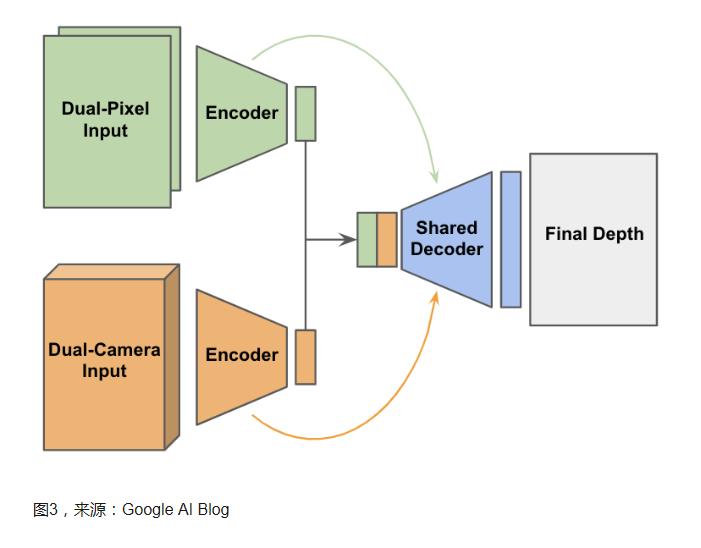

更为典型的例子是模拟背景虚化效果。传统方案模拟背景虚化主要是靠立体视觉,而谷歌提出的方案,不仅依靠两种立体视觉方案(Pixel 4手机的双摄与双像素技术),而且为加强虚化可靠性,对画面拍摄对象做语义分割:谷歌打造了一台五颗摄像头的设备,拍摄大量场景,收集足够的训练数据。利用Tensorflow训练一个卷积神经网络:首先分别单独处理双像素与双摄的输入数据,中间有编码器将输入信息编码为IR(中间层),随后两部分信息经过另一个编码器,完成最终的对象深度计算(图3)。这里的编码器本身就是一种神经网络。

今年4月,联发科的研究人员发表了一篇题为Learning Camera-Aware Noise Models的论文,提出对图像传感器噪声进行建模的方法,通过“一种数据驱动的方法,从真实环境噪声中去学习噪声模型。这种噪声模型与相机相关,不同的传感器有不同的噪声特点,它们都能被学习。”

这些例子都表明,越来越多不同层级的市场参与者都在投入图像的后处理。所以采用老型号COMS的谷歌Pixel手机,在很多成像项目对决中,与其他采用上亿像素COMS的手机相比,依然保持优势。外置一颗AI视觉芯片的方案,显然让谷歌更有发挥空间。

如今的手机已经开始广泛应用AI来做成像质量的加强,而且包括了取景、抑噪、自动白平衡这些传统环节的参与。就用户层面来看,AI芯片参与计算并不会有很强的感知。

当这些技术在成像领域变得越来越普遍时,过去的移动成像唯CMOS中心论愈发失效。如今的终端厂商在火拼手机拍照时,比拼的重点已经向图像/视觉处理与计算偏移。毕竟传统光学技术发展的速度无法与与数字芯片相比。

下面,以华为AI算力为主,详细的谈谈华为麒麟990的AI。

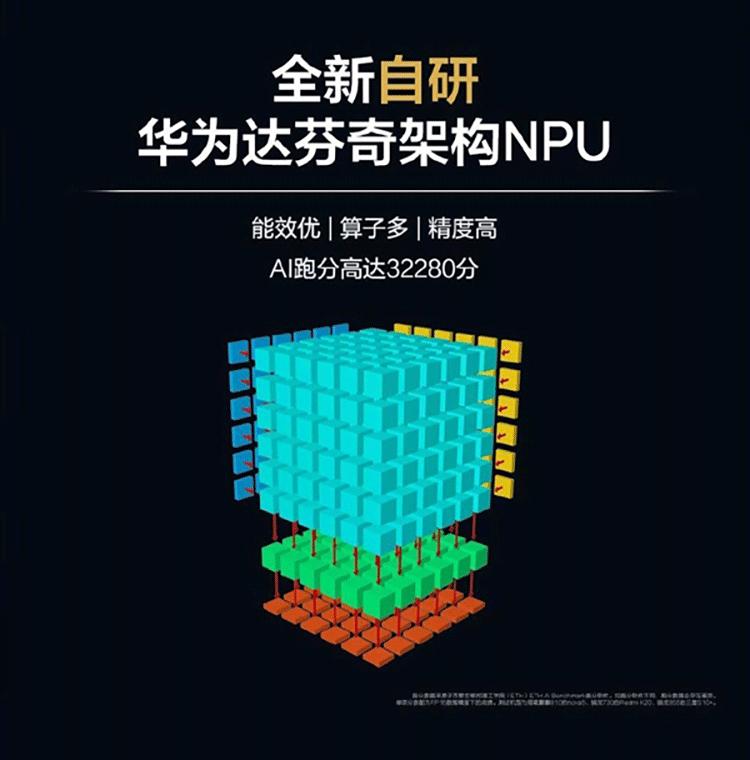

麒麟990在2019年下半年正式发布和上市,使用的是达芬奇架构。

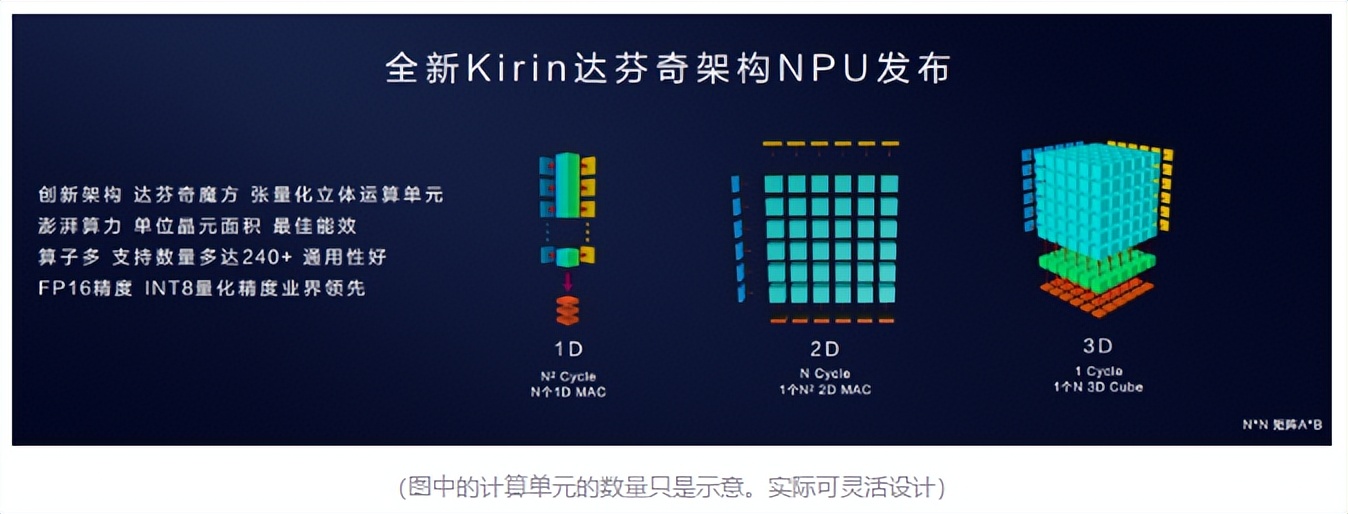

达芬奇架构的核心优势是什么?

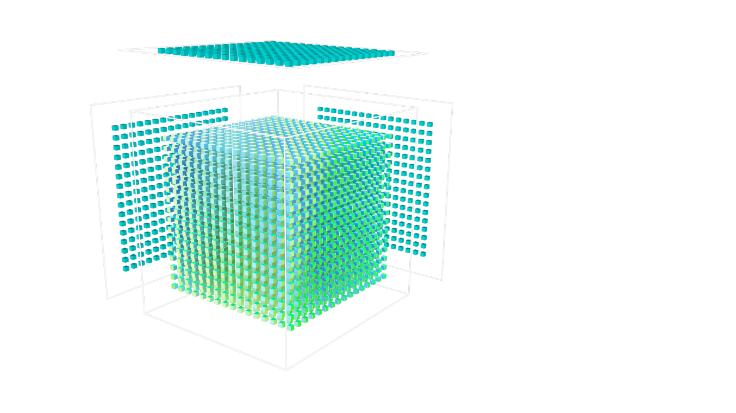

达芬奇架构,是华为自研的面向AI计算特征的全新计算架构,具备高算力、高能效、灵活可裁剪的特性,是实现万物智能的重要基础。具体来说,达芬奇架构采用3D Cube针对矩阵运算做加速,大幅提升单位功耗下的AI算力,每个AI Core可以在一个时钟周期内实现4096个MAC操作,相比传统的CPU和GPU实现数量级的提升。

3D Cube

同时,为了提升AI计算的完备性和不同场景的计算效率,达芬奇架构还集成了向量、标量、硬件加速器等多种计算单元。支持多种精度计算,支撑训练和推理两种场景的数据精度要求,实现AI的全场景需求覆盖。

在如智能手机等实际端侧AI应场景中,AI算力与功耗的协调是至关重要的,一般来讲更高的AI算力意味着更大的功耗,因此智能手机的续航常常使AI算力受限。而有了达芬奇架构NPU,这一状况将得到改善,如果麒麟990能够搭载达芬奇架构NPU,麒麟芯片或将再次迎来震动行业的算力升级。

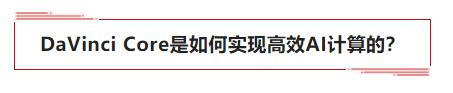

在2018年全联接大会上,华为推出AI芯片昇腾310,这是达芬奇架构的首次亮相,昇腾310相当于AI芯片中的NPU。其中,DaVinci Core只是NPU的一个部分,DaVinci Core内部还细分成很多单元,包括核心的3D Cube、Vector向量计算单元、Scalar标量计算单元等,它们各自负责不同的运算任务实现并行化计算模型,共同保障AI计算的高效处理。

- 3D Cube矩阵乘法单元:算力担当

刚才已经提到,矩阵乘是AI计算的核心,这部分运算由3D Cube完成,Buffer L0A,L0B,L0C则用于存储输入矩阵和输出矩阵数据,负责向Cube计算单元输送数据和存放计算结果

- Vector向量计算单元:灵活的多面手

虽然Cube的算力很强大,但只能完成矩阵乘运算,还有很多计算类型要依靠Vector向量计算单元来完成。Vector的指令相对来说非常丰富,可以覆盖各种基本的计算类型和许多定制的计算类型

- Vector向量计算单元:灵活的多面手

虽然Cube的算力很强大,但只能完成矩阵乘运算,还有很多计算类型要依靠Vector向量计算单元来完成。Vector的指令相对来说非常丰富,可以覆盖各种基本的计算类型和许多定制的计算类型

不同于以往的标量、矢量运算模式,华为达芬奇架构以高性能3D Cube计算引擎为基础,针对矩阵运算进行加速,大幅提高单位面积下的AI算力,充分激发端侧AI的运算潜能。以两个N*N的矩阵A*B 乘法为例:如果是N个1D 的MAC,需要N^2(即N的2次方)的cycle数;如果是1个N^2的2D MAC阵列,需要N个Cycle;如果是1个N维3D的Cube,只需要1个Cycle。

华为创新设计的达芬奇架构将大幅提升算力,16*16*16的3D Cube能够显著提升数据利用率,缩短运算周期,实现更快更强的AI运算。这是什么意思呢?举例来说,同样是完成4096次运算,2D结构需要64行*64列才能计算,3D Cube只需要16*16*16的结构就能算出。其中,64*64结构带来的问题是:运算周期长、时延高、利用率低。

达芬奇架构的这一特性也完美体现在麒麟810上。作为首款采用达芬奇架构NPU的手机SoC芯片,麒麟810实现强劲的AI算力,在单位面积上实现最佳能效,FP16精度和INT8量化精度业界领先,搭载这款SoC芯片的华为Nova 5、Nova 5i Pro及荣耀9X手机已上市,为广大消费者提供多种精彩的AI应用体验。

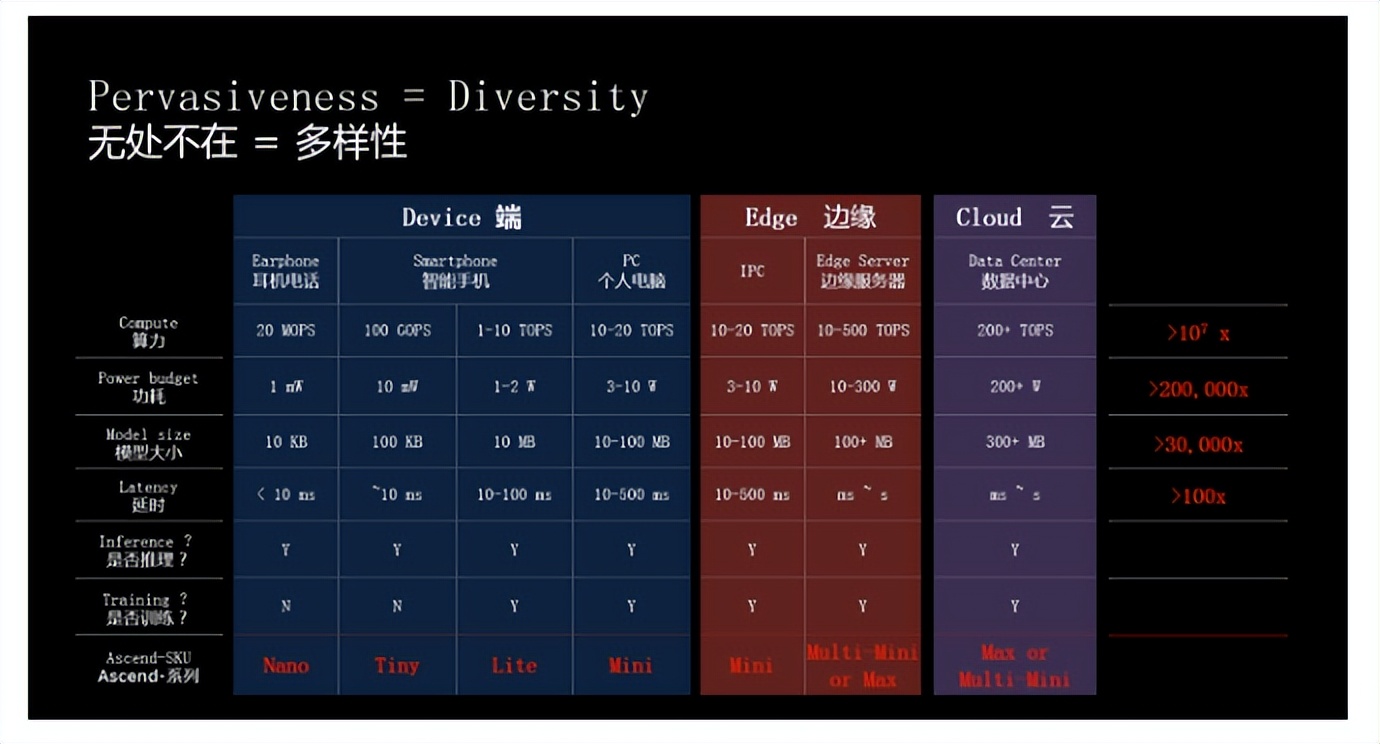

一直以来,麒麟芯片的AI实力之所以受到人们的认可,除了强劲的AI计算力领先行业,结合华为手机实现的众多应用场景也受到了高度赞扬。达芬奇架构作为华为自研架构,在应用适应性方面与华为的理念一脉相承,基于灵活可扩展的特性,达芬奇架构能够满足端侧、边缘侧及云端的应用场景,可用于小到几十毫瓦,大到几百瓦的训练场景,横跨全场景提供最优算力,麒麟990所使用到的只是端侧AI最基本的一部分。

并且,想要真正实现万物互联的AI生态,离不开广大的AI开发者,那么选择开发统一架构就是一个非常关键的决策了。对于广大开发者来说,基于达芬奇架构的统一性,在面对云端、边缘侧、端侧等全场景应用开发时,只需要进行一次算子开发和调试,就可以应用于包括麒麟芯片在内的不同平台,大幅降低了迁移成本。

如今,我们体验最多的AI应用大多来源于智能手机,但对于整个AI生态来说,智能手机只是一个开端,未来更多的AI应用涌现、跨平台迁移才能真正实现无处不在的智慧生活。因此,如果麒麟990真的搭载了达芬奇架构NPU,不止是手机算力提升那么简单,同时还以AI之力加速万物互联的智慧时代的到来。

这篇推文就谈到这里,我是六六科技人,我们说车谈科技。让我们一起迈向更好的未来!